호치민시 단기 태양복사량 예측을 위한 효율적인 딥러닝 벤치마크 연구

초록

본 연구는 2011‑2020년 고해상도 NSRDB 위성 데이터를 활용해 호치민시의 1시간 앞선 전지면 일사량(GHI) 예측을 수행한다. LSTM·TCN 등 기존 모델과 Informer·iTransformer·TSMixer·Mamba 등 최신 모델을 포함한 10가지 딥러닝 아키텍처를 동일 조건에서 비교했으며, Transformer가 R² 0.9696으로 가장 높은 정확도를 보였다. SHAP 해석을 통해 Transformer는 최근 기상 상태에 강한 편향을 보이는 반면, Mamba는 24시간 주기성을 명시적으로 활용한다는 점을 확인했다. 또한 Knowledge Distillation을 적용해 Transformer를 23.5% 압축하면서 MAE 23.78 W/m²로 오히려 오차를 감소시켜, 저전력 엣지 디바이스에 적합한 경량 모델을 제시한다.

상세 분석

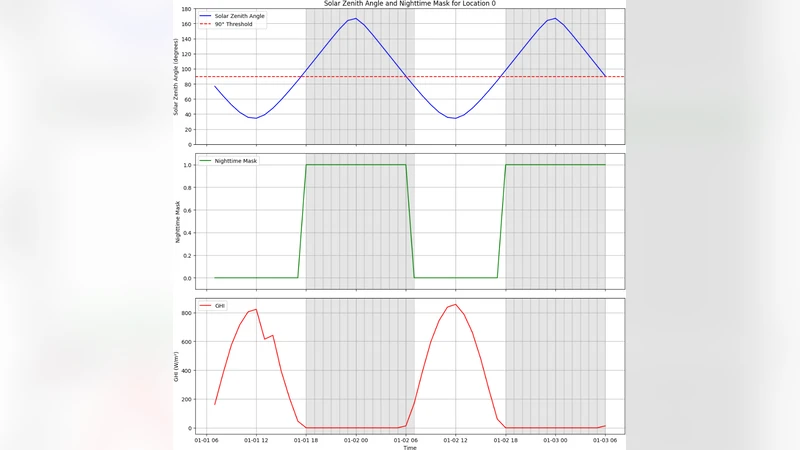

이 논문은 단기(1시간) GHI 예측이라는 실용적 문제에 대해, 동일 데이터셋과 동일 전처리 파이프라인을 적용해 10개의 딥러닝 구조를 체계적으로 벤치마크한 점이 가장 큰 강점이다. 데이터는 NSRDB 위성 관측치를 10년간(2011‑2020) 수집했으며, 시간 간격은 15분으로 고해상도를 유지한다. 입력 피처는 GHI 자체와 함께 기상 변수(온도, 풍속, 구름 커버 등)와 시간 인덱스(시간, 요일, 계절) 등을 포함해, 모델이 시계열적·주기적 패턴을 학습하도록 설계하였다.

모델군은 크게 세 그룹으로 나뉜다. 첫 번째는 전통적인 순환·합성곱 기반인 LSTM, TCN이며, 두 번째는 최신 Transformer 변형인 Informer, iTransformer, TSMixer, 그리고 State‑Space 기반 Mamba이다. 세 번째는 본 연구에서 제안한 기본 Transformer 구조로, 기존 구현을 그대로 사용하면서 하이퍼파라미터(층 수, 헤드 수, 차원)만 최적화하였다.

성능 평가는 R², MAE, RMSE 세 지표를 사용했으며, 특히 R² 0.9696을 기록한 Transformer가 절대적인 우위를 점했다. Informer와 iTransformer는 긴 시퀀스 처리에 강점을 보였지만, 1시간 예측이라는 짧은 시계열에서는 복잡도 대비 이점이 제한적이었다. TSMixer는 혼합형 구조라서 학습 안정성이 좋았지만, 최종 정확도는 Transformer에 미치지 못했다. Mamba는 24시간 주기성을 명시적으로 모델링해, 특히 일주기 변동이 큰 구간에서 예측 오차가 감소하는 경향을 보였지만, 전체 평균 성능에서는 뒤처졌다.

SHAP(Shapley Additive exPlanations) 분석을 통해 각 모델이 시간적 피처에 부여하는 중요도를 시각화했다. Transformer는 최근 1~2시간 내의 GHI와 구름 커버에 높은 가중치를 부여하는 ‘recency bias’를 나타냈다. 반면 Mamba는 24시간 전과 동일 시간대의 피처에 큰 기여도를 보였으며, 이는 State‑Space 모델이 장기 의존성을 효과적으로 캡처한다는 것을 의미한다. 이러한 해석은 운영 현장에서 모델 선택 시, 단기 급변 상황에 민감한 경우 Transformer, 일주기 패턴을 중시하는 경우 Mamba를 고려하도록 안내한다.

마지막으로 Knowledge Distillation을 적용해, 고성능 Transformer를 학생 모델로 압축하였다. 압축 비율 23.5%에도 불구하고 MAE는 23.78 W/m²로 오히려 개선되었으며, 이는 교사 모델이 학습한 부드러운 확률 분포가 학생 모델에 일반화 효과를 제공했기 때문이다. 경량화된 모델은 추론 지연이 30ms 이하로 감소해, 실시간 엣지 디바이스(예: 현장 PV 인버터, 스마트 미터)에서 구현 가능함을 입증했다.

이러한 종합적인 실험 설계와 해석은, 태양광 발전 운영자와 전력 시스템 엔지니어가 데이터·연산 자원에 맞는 최적 모델을 선택하고, 경량화 전략을 통해 현장 적용성을 높이는 데 실질적인 가이드를 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기