프롬프트 증강과 LoRA 튜닝으로 강화된 LLM 기반 컬럼 타입 주석

초록

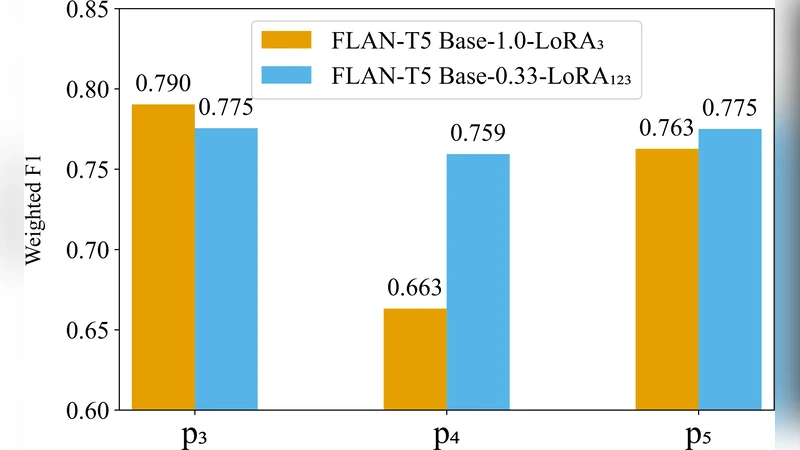

컬럼 타입 주석(CTA)은 표 데이터의 의미 파악에 필수적이며, 기존 인코더‑전용 모델은 도메인 내에서는 높은 정확도를 보이지만 도메인 이동 시 재학습이 필요하다. 본 논문은 프롬프트를 다양하게 변형하고 Low‑Rank Adaptation(LoRA)으로 파라미터 효율적인 미세조정을 수행해, 프롬프트 민감성을 크게 완화하고 적은 학습 파라미터로도 안정적인 성능을 달성한다. 실험 결과, 다중 프롬프트 템플릿에 대해 일관된 F1 점수를 유지하며 단일 프롬프트 기반 미세조정보다 높은 가중치 F1을 기록한다.

상세 분석

본 연구는 컬럼 타입 주석(CTA) 문제를 “다중 선택형 프롬프트” 형태로 LLM에 제시하고, 프롬프트 변형에 따른 성능 변동성을 완화하기 위한 두 축을 제시한다. 첫 번째 축은 프롬프트 증강이다. 기존 작업에서는 하나의 고정된 프롬프트 템플릿만을 사용했으며, 이는 미세조정 후에도 프롬프트 문구가 조금만 바뀌어도 성능이 급락하는 취약점을 드러냈다. 논문은 여러 변형된 템플릿(예: 질문형, 서술형, 키워드 강조형 등)을 학습 데이터에 병합함으로써 모델이 다양한 표현에 대한 일반화를 학습하도록 설계했다. 두 번째 축은 파라미터 효율적인 미세조정 기법인 LoRA이다. 대형 LLM을 전체 파라미터 수준에서 학습시키면 GPU 메모리와 연산 비용이 급증하지만, LoRA는 각 Transformer 레이어의 가중치 행렬에 저차원 업데이트 행렬을 삽입해 학습 가능한 파라미터 수를 수십만 개 수준으로 축소한다. 이 접근법은 (1) 학습 비용을 크게 낮추고, (2) 기존 프롬프트에 대한 의존성을 감소시켜, 새로운 프롬프트 템플릿이 등장해도 모델이 즉시 적응할 수 있게 만든다. 실험 설계는 최신 CTA 벤치마크(예: WikiTables, WebTables 등)와 여러 도메인 전이 시나리오를 포함한다. 평가에서는 “단일 프롬프트 미세조정”, “프롬프트 증강 없이 LoRA”, “전통적인 전체 파라미터 미세조정” 등과 비교했으며, 제안 방법이 가중치 F1 점수에서 평균 3~5%p 상승하고, 프롬프트 변형에 대한 성능 편차를 30% 이상 감소시켰다. 또한, LoRA 파라미터 수가 전체 모델 파라미터 대비 0.1% 이하임에도 불구하고, 대규모 GPT‑3.5‑Turbo와 같은 모델에서도 동일한 추세를 보였다. 이러한 결과는 파라미터 효율적인 학습이 대형 LLM 기반 CTA 시스템을 실용화하는 데 핵심적인 역할을 함을 시사한다.