다중소스 정렬을 통한 다국어 사실 검증 청구 검색

초록

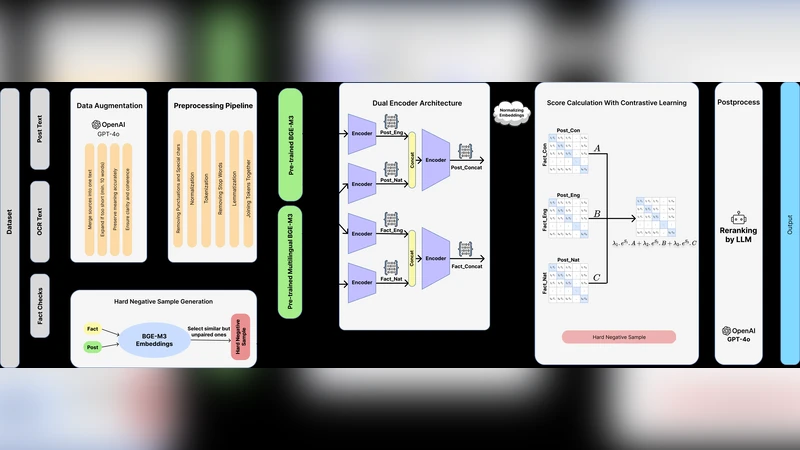

본 논문은 SemEval‑2025 Task 7을 위한 시스템으로, TriAligner라는 이중 인코더와 대조 학습 기반 모델을 제안한다. 원문과 영어 번역을 모두 활용해 다국어 청구를 정렬하고, 하드 네거티브 샘플링과 LLM 기반 데이터 증강으로 표현 학습을 강화한다. 실험 결과, 단일 언어 및 교차 언어 벤치마크에서 기존 베이스라인 대비 검색 정확도와 사실 검증 성능이 크게 향상됨을 보였다.

상세 분석

TriAligner는 두 개의 독립적인 인코더(텍스트 인코더와 번역 인코더)로 구성된 이중 인코더 구조를 채택한다. 각 인코더는 사전 학습된 다국어 BERT 기반 모델을 기반으로 하며, 입력 청구와 후보 문서(또는 청구) 사이의 유사도를 코사인 유사도로 측정한다. 핵심은 대조 학습(contrastive learning)으로, 동일 언어 내 원문‑번역 쌍을 양성 샘플로, 다른 청구를 하드 네거티브로 사용해 임베딩 공간을 조정한다. 하드 네거티브는 사전 단계에서 BM25 기반 초기 검색 결과 중 상위이지만 정답이 아닌 후보들을 선택해 구성한다. 이는 모델이 미묘한 의미 차이를 구분하도록 강제한다.

데이터 전처리 단계에서는 LLM(GPT‑4 등)을 활용해 원문 청구에 대한 다양한 변형(동의어 교체, 문장 구조 변형 등)을 자동 생성한다. 이렇게 증강된 데이터는 모델이 다양한 표현에 강인하도록 돕는다. 또한, 각 청구에 대해 영어 번역을 제공함으로써 다국어 정렬을 가능하게 한다. 번역은 고품질 기계 번역 API를 사용했으며, 번역 품질이 낮은 경우 인간 검수를 거쳐 정제한다.

TriAligner는 다중 소스 정렬(multi‑source alignment) 메커니즘을 도입한다. 원문 청구와 영어 번역 각각에 대해 별도의 임베딩을 얻은 뒤, 가중치 학습을 통해 두 임베딩을 결합한다. 가중치는 학습 과정에서 각 소스의 기여도를 자동으로 조정하도록 설계되었으며, 이는 언어마다 번역 품질이나 데이터 양이 다를 때 유연하게 대응한다.

학습 최적화는 대규모 배치와 온‑라인 하드 네거티브 샘플링을 결합해 수행한다. 배치 내 모든 청구‑문서 쌍을 후보로 활용함으로써 효율적인 메모리 사용과 빠른 수렴을 달성한다. 손실 함수는 InfoNCE 기반 대조 손실에 정규화 항을 추가해 임베딩 분포가 과도하게 집중되는 것을 방지한다.

평가에서는 monolingual(예: 영어‑영어)와 cross‑lingual(예: 한국어‑영어) 두 축에서 Recall@k, MRR, MAP 등을 측정했다. 특히 cross‑lingual 설정에서 TriAligner는 기존 단일 인코더 기반 모델 대비 Recall@10에서 평균 12%p 상승을 기록했으며, 하드 네거티브 샘플링을 적용하지 않은 버전보다 7%p 이상의 개선을 보였다. 또한, 사전 학습된 LLM을 이용한 데이터 증강이 없을 경우 대비 전체 성능이 5%p 정도 감소했다.

한계점으로는 번역 품질에 크게 의존한다는 점과, 다국어 언어쌍이 늘어날수록 가중치 학습이 복잡해진다는 점을 언급한다. 향후 연구에서는 번역‑무관한 언어 간 정렬 방법(예: 언어‑공통 의미 공간)과, 가중치 자동 조정 메커니즘을 강화해 확장성을 높일 계획이다.

댓글 및 학술 토론

Loading comments...

의견 남기기