아이템 영역 기반 패션 스타일 분류 네트워크

초록

본 논문은 패션 스타일을 전역 이미지 특징뿐 아니라 아이템별 영역 특징과 그 조합을 활용해 분류하는 Item Region‑based Style Classification Network(IRSN)를 제안한다. IRSN은 아이템 영역 풀링(IRP)으로 각 의류 부위의 특징을 추출하고, 게이트형 피처 융합(GFF)으로 전역 특징과 결합한다. 또한 도메인 특화 백본과 대규모 이미지‑텍스트 사전학습 백본을 병렬로 사용하는 듀얼‑백본 구조를 도입해 표현력을 강화한다. 다양한 최신 백본에 적용했을 때 FashionStyle14와 ShowniqV3 데이터셋에서 평균 6~8%p, 최대 15%p 이상의 정확도 향상을 달성했으며, 시각화 결과 유사 스타일 구분 능력이 크게 개선된 것을 확인하였다.

상세 분석

IRSN은 패션 스타일 분류에서 “전역 외관”과 “아이템 별 세부 속성”이 동시에 중요하다는 패션 전문가의 도메인 지식을 모델 구조에 직접 반영한다는 점에서 차별화된다. 먼저, 입력 이미지에서 사전 정의된 옷, 바지, 신발 등 주요 아이템 영역을 자동으로 탐지하고, 각 영역에 대해 Item Region Pooling(IRP)을 수행한다. IRP는 영역별 RoI‑Align과 유사한 방식으로 고정된 크기의 특징 맵을 추출해, 아이템 별 특화된 피처 벡터를 만든다. 이렇게 얻은 아이템 피처는 개별적으로 작은 전용 헤드(MLP)에서 처리되어 아이템 고유의 스타일 신호를 강조한다.

전역 피처는 대규모 이미지‑텍스트 쌍으로 사전학습된 CLIP‑like 백본을 사용해 풍부한 일반 시각 정보를 획득한다. 동시에, 도메인 특화 백본(예: EfficientNet‑B3)에서는 패션 데이터에 맞춘 미세조정이 이루어져 옷감 질감, 패턴 등 세밀한 디테일을 포착한다. 두 백본의 출력은 동일 차원으로 정규화된 뒤, Gated Feature Fusion(GFF) 모듈을 통해 동적으로 가중치를 부여받으며 결합된다. GFF는 시그모이드 게이트를 이용해 각 피처 채널의 중요도를 학습하고, 전역 피처와 아이템 피처 사이의 상호 보완성을 극대화한다.

손실 함수는 기본 교차 엔트로피 외에 스타일 간 유사성을 고려한 라벨 스무딩 및 아이템 간 관계를 강화하는 정규화 항을 포함한다. 이 설계는 “청바지 + 티셔츠”와 같은 조합 스타일이 “청바지 + 셔츠”와 구분되도록 돕는다.

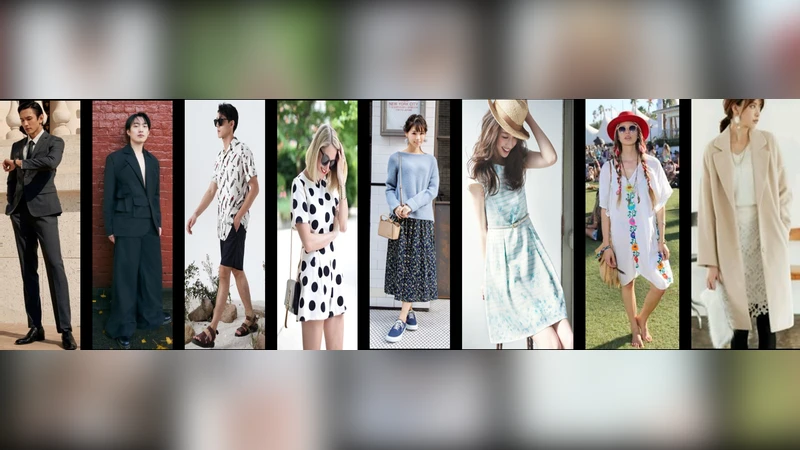

실험에서는 EfficientNet‑B0, ConvNeXt‑Base, Swin‑Transformer‑Tiny 등 6가지 최신 백본에 IRSN을 적용했으며, FashionStyle14(14개 스타일, 30k 이미지)와 ShowniqV3(30개 스타일, 100k 이미지)에서 각각 평균 6.9%p, 7.6%p, 최대 14.5%p, 15.1%p의 정확도 향상을 기록했다. 특히, 시각적으로 유사한 “스트리트”와 “캐주얼” 스타일을 구분하는 Grad‑CAM 시각화에서 IRSN은 아이템 영역(예: 신발, 액세서리)의 미세 차이를 강조해 baseline보다 명확히 구분되는 모습을 보였다.

이러한 결과는 패션 스타일이 단순히 전체 실루엣이 아니라 아이템 간 조합과 디테일에 크게 의존한다는 가설을 실증적으로 뒷받침한다. 또한, 도메인 특화 백본과 대규모 사전학습 백본을 병렬로 활용하는 듀얼‑백본 전략이 다양한 시각 도메인에 적용 가능한 일반적인 성능 향상 메커니즘임을 시사한다. 향후 연구에서는 자동 아이템 영역 탐지를 위한 더 정교한 포즈/세그멘테이션 모델과, 스타일 변이 생성 모델과의 연계가 기대된다.