스마트사이트: 시간적 주의 붕괴를 이용한 비디오‑LLM 환각 억제와 이해력 동시 향상

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

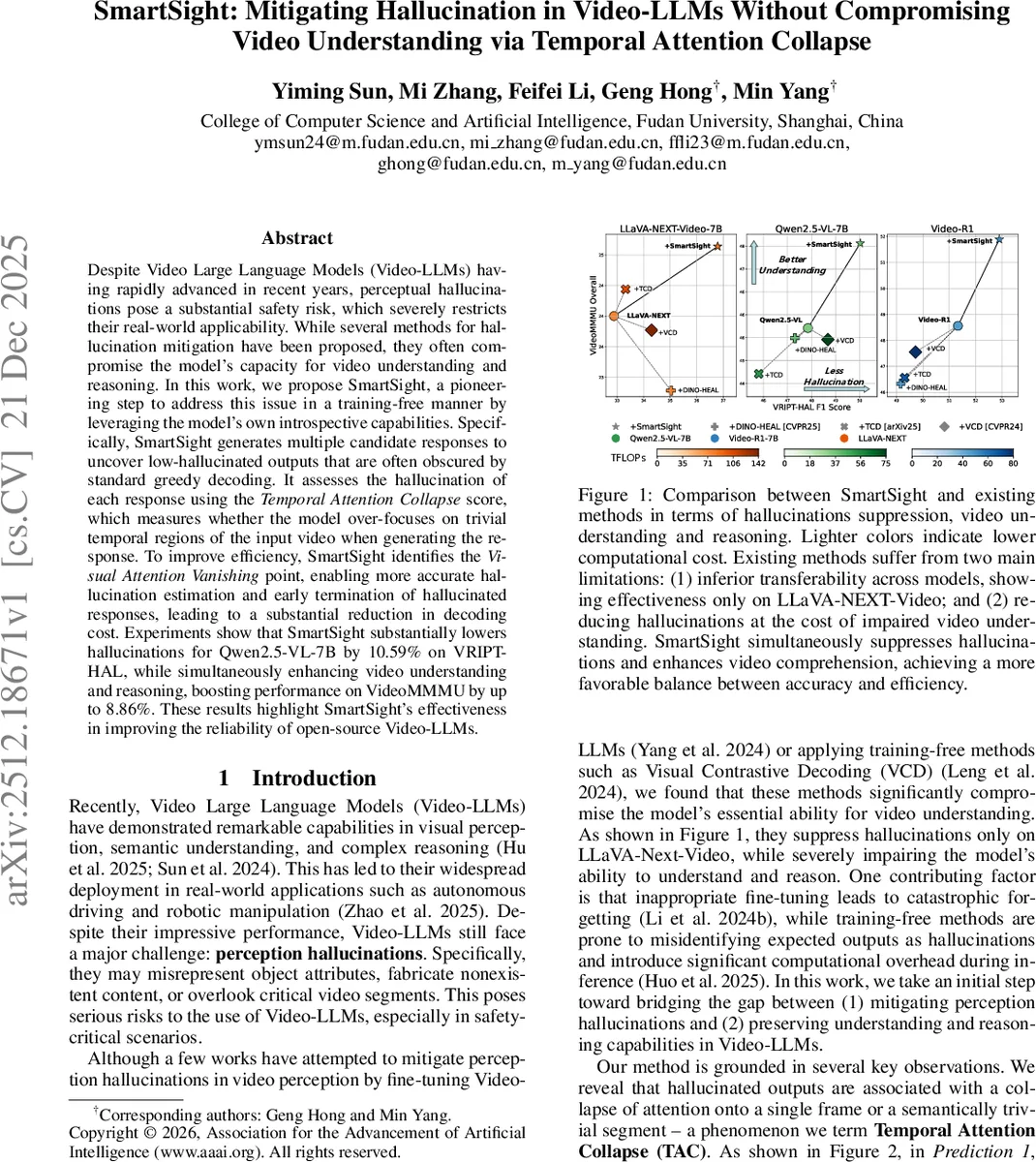

스마트사이트는 훈련 없이 비디오‑LLM의 자체 주의 정보를 활용해 다중 응답을 생성하고, ‘시간적 주의 붕괴(TAC)’ 점수를 통해 각 응답의 환각 정도를 정량화한다. 시각 주의 소멸(VAV) 시점을 찾아 조기에 저품질 응답을 중단함으로써 디코딩 비용을 최대 79.6% 절감하면서도 Qwen2.5‑VL‑7B의 VRIPT‑HAL 환각률을 10.59% 감소시키고 VideoMMMU에서 최대 8.86% 성능 향상을 달성한다.

상세 분석

스마트사이트는 기존 환각 억제 기법이 비디오 이해와 추론 능력을 저해한다는 문제점을 인식하고, 모델 자체의 ‘내적 인식(introspective)’ 메커니즘을 활용한다는 점에서 독창적이다. 핵심 아이디어는 환각이 발생할 때 모델이 특정 프레임이나 의미가 거의 없는 구간에 과도하게 주의를 집중한다는 ‘시간적 주의 붕괴(Temporal Attention Collapse, TAC)’ 현상을 정량화하는 것이다.

-

TAC 점수 설계

- 프레임‑레벨 붕괴(S_f): 각 프레임에 할당된 평균 주의량을 정규화한 뒤 엔트로피를 계산한다. 엔트로피가 낮을수록 주의가 소수 프레임에 집중돼 환각 위험이 높다.

- 세그먼트‑레벨 붕괴(S_c): 단순 코사인 유사도 대신 ‘Motion‑Aware Cost Matrix’를 도입해 프레임 간 움직임과 외관 변화를 고려한다. 이 행렬을 기반으로 의미가 거의 변하지 않는 구간을 탐지하고, 해당 구간에 주의가 몰리는 정도를 측정한다. 두 점수를 결합해 최종 TAC 점수를 산출한다.

-

시각 주의 소멸(VAV) 포인트

- 회전형 위치 인코딩(rotary positional encoding)의 특성상 토큰 간 거리 증가에 따라 주의 점수가 자연스럽게 감소한다. 스마트사이트는 생성 과정 중 시각 토큰에 대한 평균 주의가 급격히 감소하는 시점을 VAV 포인트로 정의한다.

- VAV 포인트 이전에 TAC 점수를 계산하면 전체 디코딩을 마칠 필요 없이 응답의 품질을 예측할 수 있다. 이를 활용해 높은 환각 점수를 보이는 후보는 조기에 중단하고, 남은 후보만 완전하게 생성한다.

-

다중 샘플링 전략

- Greedy decoding은 최빈 토큰을 선택해 다양성을 억제하고, 종종 환각이 심한 답변만을 산출한다. 스마트사이트는 N개의 샘플을 병렬로 생성하고, 각 샘플에 TAC 점수를 부여한다. 실험에서는 N=10일 때 최소 환각 샘플이 Greedy 결과보다 현저히 낮은 것을 확인했다.

-

효율성

- VAV 포인트 기반 조기 종료는 디코딩 단계에서 평균 79.6%의 연산 절감을 가져온다. 이는 기존 훈련‑프리 방법(예: Visual Contrastive Decoding)이 초래하는 높은 비용과 대비된다.

-

실험 결과

- VRIPT‑HAL: Qwen2.5‑VL‑7B의 환각 F1 점수가 10.59% 개선.

- VideoMMMU: 동일 모델이 8.86%까지 정확도 상승, 32B 모델 수준에 근접.

- 다양한 비디오‑LLM(10종)에서 일관된 성능 향상을 보였으며, 모델 규모가 커질수록 스케일링 효과가 더 뚜렷했다.

-

한계 및 향후 과제

- 현재는 시각 토큰만을 대상으로 하며, 자막·오디오와 같은 멀티모달 정보는 고려되지 않는다.

- TAC 점수는 주의 분포에 의존하므로, 주의 메커니즘이 크게 변형된 새로운 아키텍처에서는 재조정이 필요할 수 있다.

- VAV 포인트 탐지는 경험적 임계값에 기반하므로, 자동화된 최적화가 추가 연구 과제로 남는다.

스마트사이트는 훈련 없이도 비디오‑LLM의 신뢰성을 크게 향상시키는 실용적인 솔루션이며, 특히 실시간 혹은 비용 제한이 있는 응용 분야에서 큰 잠재력을 가진다.

댓글 및 학술 토론

Loading comments...

의견 남기기