라벨 없는 환경을 위한 경량 이미지 복원 에이전트 SimpleCall

초록

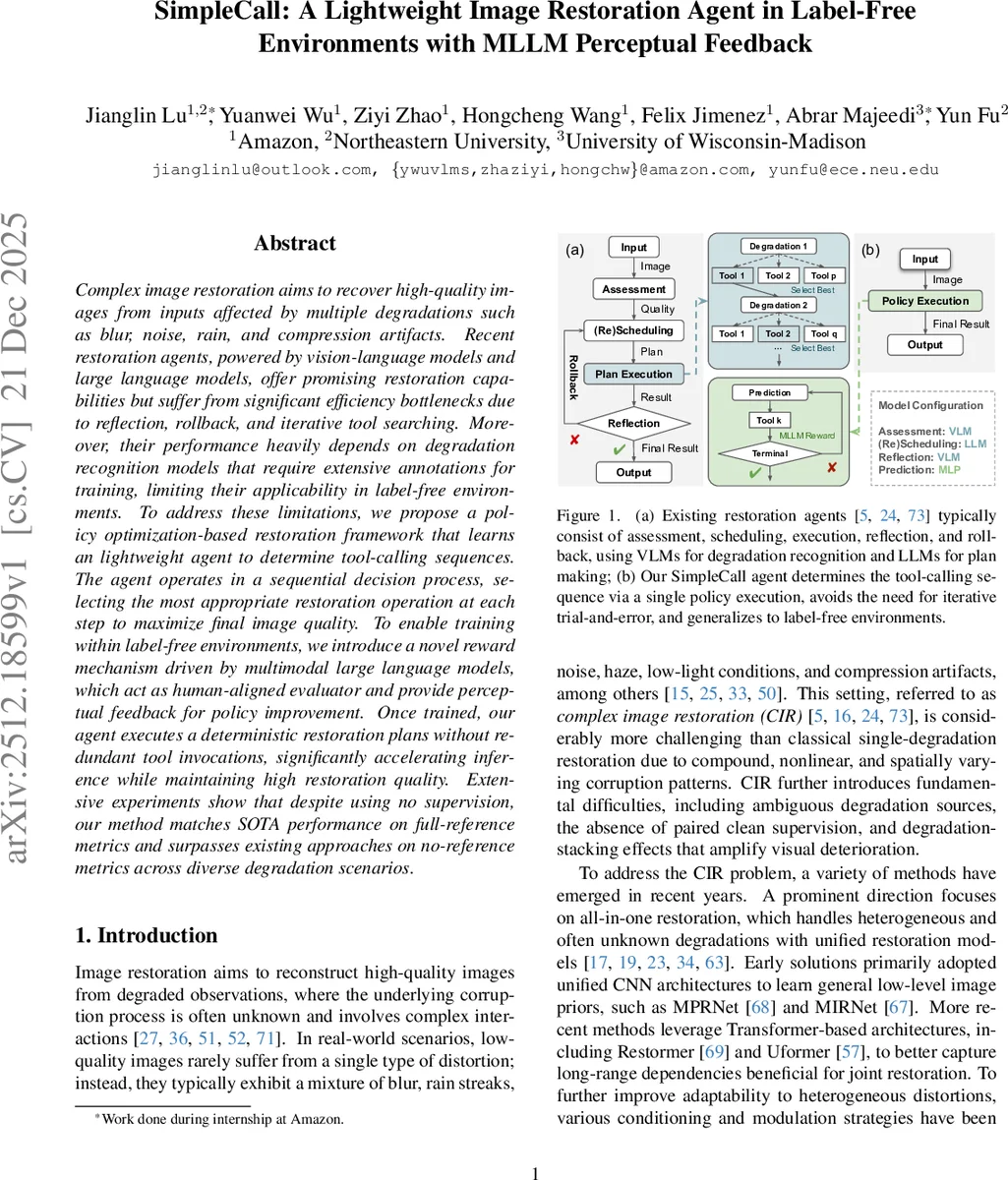

SimpleCall은 복합 손상 이미지 복원을 위해 정책 최적화 기반 경량 에이전트를 학습한다. 라벨이 없는 환경에서도 멀티모달 대형 언어 모델(MLLM)을 이용해 인간과 유사한 지각 보상을 제공함으로써 툴 호출 순서를 스스로 결정한다. 학습 후에는 단일 순전파로 결정적인 복원 플랜을 실행해 기존 에이전트들의 반복 탐색과 롤백을 크게 줄이며, 전체 참조 지표에서는 SOTA 수준, 비참조 지표에서는 기존 방법을 능가한다.

상세 분석

본 논문은 복합 이미지 복원(Complex Image Restoration, CIR) 문제를 “툴 시퀀스 선택”이라는 순차 의사결정 문제로 재정의하고, 이를 강화학습(RL) 프레임워크에 매핑한다. 기존 에이전트 기반 접근법은 VLM으로 손상을 인식하고 LLM으로 플랜을 생성한 뒤, 반사·롤백·툴 재검색 과정을 반복한다. 이러한 파이프라인은 두 가지 근본적인 한계를 가진다. 첫째, 툴 탐색 과정에서 발생하는 다중 호출·반복 연산으로 인한 추론 지연이 크다. 둘째, 손상 라벨이나 최적 시퀀스와 같은 지도 정보가 필요해 라벨이 없는 실환경 적용이 어렵다. SimpleCall은 이러한 문제를 해결하기 위해 (1) 경량 이미지 인코더와 MLP 기반 액터‑크리틱 구조를 도입해 파라미터 수를 0.28 B로 크게 축소하고, (2) 멀티모달 대형 언어 모델(예: LLaVA‑Llama3, Qwen2‑VL 등)을 “인간 정렬 평가자”로 활용해 이미지 품질에 대한 지각 보상을 자동 생성한다. 보상은 PSNR·SSIM·LPIPS와 같은 전통적 전후 참조 지표가 아니라, MLLM이 제공하는 자연어 기반 품질 서술을 정량화한 형태이며, 이는 라벨이 전혀 없는 환경에서도 정책을 학습할 수 있게 한다. 정책 최적화는 PPO와 유사한 클리핑 서러게이트 손실을 사용해 급격한 파라미터 변동을 방지하고, GAE를 통해 편향‑분산 균형을 맞춘 어드밴티지를 계산한다. 또한 엔트로피 보너스를 포함해 탐색성을 유지한다. 학습 단계에서는 스토케스틱 샘플링으로 다양한 툴 시퀀스를 경험하고, 평가 단계에서는 MLLM이 반환한 보상값을 즉시 크리틱에 전달해 가치 함수와 정책을 동시에 업데이트한다. 추론 시에는 가장 확률이 높은 툴을 순차적으로 선택해 단일 전방 패스로 복원을 수행한다. 이 설계는 기존 에이전트가 필요로 하던 “반사‑롤백‑재검색” 루프를 완전히 제거하고, 툴 호출 횟수를 최적화함으로써 실시간 응용 가능성을 크게 높인다. 실험에서는 DIV2K, RealSR 등 다양한 복합 손상 데이터셋에서 라벨 없이 학습했음에도 불구하고, PSNR/SSIM/LIPIPS 기준 SOTA와 동등하거나 근접한 성능을 보였으며, MANIQA·CLIP‑IQA·MUSIQ·DeQA와 같은 비참조 지표에서는 현존 최고 수준을 기록했다. 특히 파라미터 규모와 추론 시간에서 기존 7~8 B 모델 대비 20배 이상 효율성을 달성했다. 전체적으로 본 연구는 (1) 라벨 프리 강화학습 기반 복원 정책, (2) MLLM을 활용한 인간‑정렬 보상 설계, (3) 경량 액터‑크리틱 구조라는 세 축을 통해 복합 손상 복원 분야에 새로운 패러다임을 제시한다는 점에서 의의가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기