Loom 텍스트 이미지 연속 생성

초록

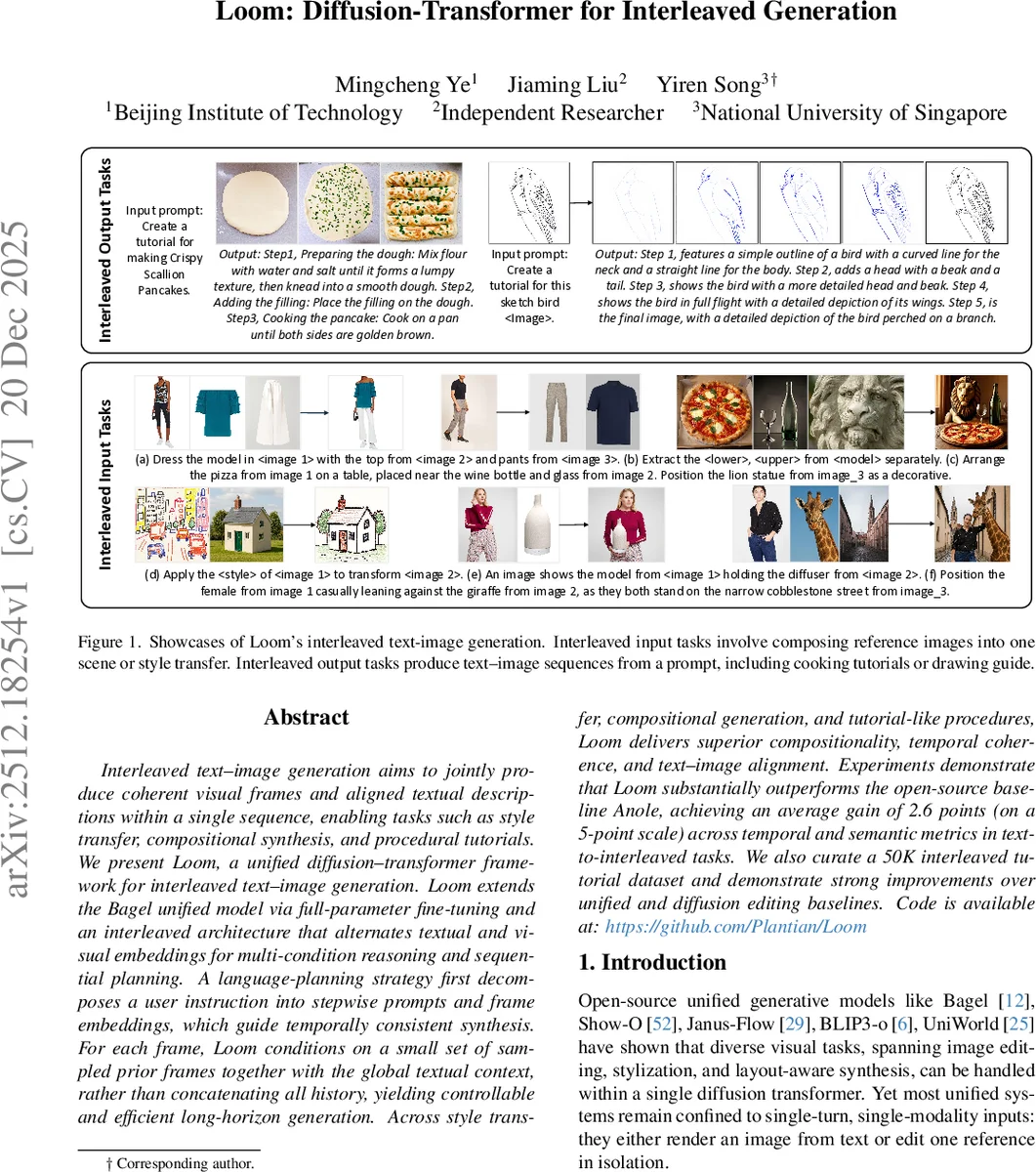

Loom은 텍스트와 이미지를 교차시켜 하나의 시퀀스로 생성하는 통합 확산‑트랜스포머 모델이다. 기존 단일턴·단일모달 통합 모델의 한계를 넘어, 텍스트‑이미지 교차 입력·출력을 지원하고, 단계별 계획 생성·희소 프레임 샘플링을 통해 장기적인 시간 일관성과 텍스트‑이미지 정렬을 확보한다. 50K 튜토리얼 데이터셋을 기반으로 스타일 전이, 합성 생성, 절차적 튜토리얼 등 3가지 작업에서 오픈소스 베이스라인 Anole보다 평균 2.6점(5점 만점) 높은 성능을 보인다.

상세 분석

Loom은 Bagel이라는 기존 확산‑트랜스포머 백본을 전파 파라미터 미세조정(full‑parameter fine‑tuning)으로 확장한다. 핵심 설계는 (1) 텍스트와 이미지 토큰을 교차 배치하는 ‘interleaved’ 토큰 시퀀스, (2) 다중 모달 어텐션(MMA)으로 텍스트, 노이즈 라티트, 이미지 조건 토큰을 동시에 처리하는 구조, (3) ‘Planning‑First’ 전략이다. 사용자가 제시한 복합 명령을 먼저 전체 텍스트 플랜(P)으로 자동 생성하고, 각 단계 Sₜ에 대해 해당 텍스트와 선택된 과거 프레임(Kmax)만을 조건으로 이미지 Iₜ를 디노이즈한다. 이때 시간 임베딩 eₜ를 시각 토큰에 더해 단계 정보를 명시적으로 전달한다. 희소 역사 프레임 샘플링은 균등 인덱스 선택을 통해 O(Kmax) 복잡도로 전역 컨텍스트를 유지하면서 연산량을 크게 절감한다. 손실 함수는 텍스트에 대한 교차 엔트로피와 이미지에 대한 MSE를 가중합한 단일 목표로, 텍스트‑이미지 정렬을 자연스럽게 학습한다. 실험에서는 50K 튜토리얼 데이터셋(요리, 드로잉, 조립 등)과 스타일·합성 전용 베이스라인을 비교해, 시간 일관성(TIM), 의미 일관성(SEM), 텍스트‑이미지 정렬(ALIGN) 등 5점 척도에서 평균 2.6점 상승을 기록한다. 특히 장기 시퀀스(>10 단계)에서 오류 전파가 크게 감소하고, 다중 이미지 조건을 활용한 복합 장면 합성에서도 높은 구조적 일관성을 보인다.

댓글 및 학술 토론

Loading comments...

의견 남기기