실시간 비디오 프레임 보간을 위한 의미 가이드 흐름 강화 SG RIFE

초록

SG‑RIFE는 사전 학습된 RIFE 흐름 백본에 고정된 DINOv3 비전 트랜스포머의 의미 정보를 효율적으로 주입하여, 실시간 속도(0.05 s/프레임)와 확산 기반 모델에 버금가는 FID·LPIPS 성능을 동시에 달성한다. Split‑FAPM과 Deformable Semantic Fusion 모듈을 통해 고차원 의미 특징을 압축·정제하고, 흐름 오류가 있는 영역에 정교히 정렬한다. SNU‑FILM 벤치마크에서 기존 실시간 모델을 크게 앞서며, 확산 모델 대비 2배 이상 빠른 추론 속도를 보인다.

상세 분석

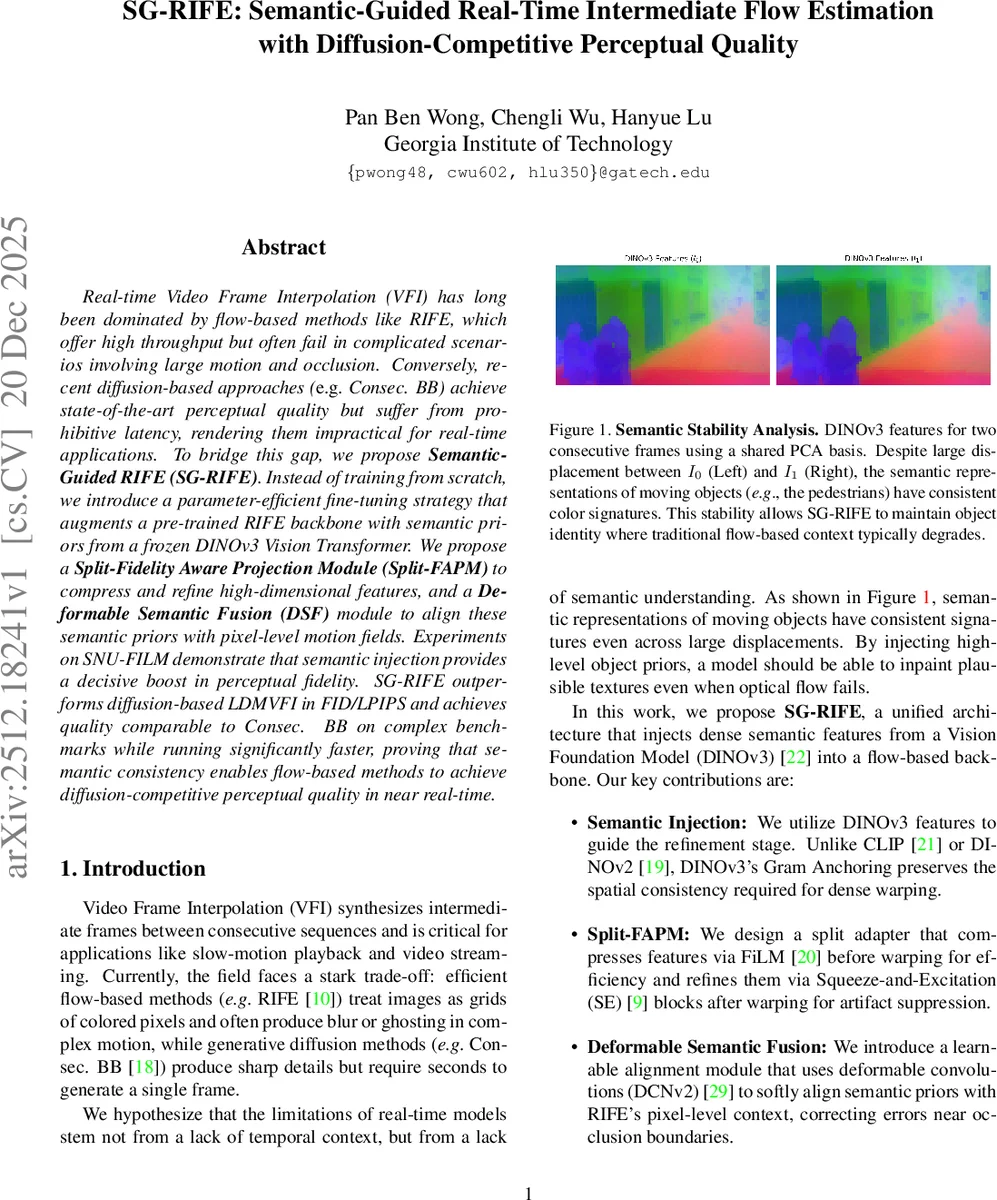

SG‑RIFE는 두 가지 핵심 가정을 바탕으로 설계되었다. 첫째, 흐름 기반 VFI가 실패하는 주요 원인은 픽셀‑레벨 상관관계만을 이용해 복잡한 움직임과 폐색을 처리하지 못한다는 점이며, 둘째, 대규모 비전 파운데이션 모델이 제공하는 의미적 일관성은 시간에 걸쳐 객체 정체성을 유지하는 데 충분히 강력하다는 점이다. 이를 구현하기 위해 저자들은 기존 RIFE 백본을 그대로 유지하고, IFNet과 ContextNet을 고정한 채 FusionNet과 경량 어댑터만 미세조정한다. 의미 특징은 DINOv3‑Small의 중간 레이어(8, 11)에서 추출되며, Gram Anchoring 덕분에 큰 변위가 있어도 색상·형태 시그니처가 안정적이다.

Split‑Fidelity‑Aware Projection Module(Split‑FAPM)은 의미 특징을 두 단계로 처리한다. 사전 워핑 단계에서는 1×1 컨볼루션 두 갈래(FEAT와 MOD)로 FiLM 파라미터(γ, β)를 학습해 차원을 384→256으로 압축하고, 작업‑특화 공간으로 매핑한다. 워핑 후에는 Depthwise Separable Conv와 SE 블록을 결합한 정제 블록을 적용해 워핑으로 발생한 공간 불연속성을 복구하고, FusionNet 각 스케일에 맞는 채널 수로 재조정한다.

Deformable Semantic Fusion(DSF) 모듈은 흐름 오류가 심한 폐색 경계에서 의미 특징과 픽셀 특징을 부드럽게 정렬한다. 먼저 압축된 의미 특징을 RIFE 흐름으로 역워핑하고, Split‑FAPM 정제기를 통과시킨 뒤, Query‑Key‑Value 변환을 통해 오프셋과 스케일 보정값을 예측한다. DCNv2 기반의 그룹형 변형 컨볼루션을 사용해 파라미터를 C²/G·9로 감소시켜 실시간 요구를 만족한다. 두 개의 DSF가 FusionNet의 중간 인코더(S2)와 병목(S3)에서 각각 4·8개의 그룹으로 배치되어, 얕은 의미 특징은 로컬 텍스처, 깊은 의미 특징은 전역 객체 경계를 보강한다.

학습 손실은 기존 RIFE 손실에 의미 일관성 L_sem(L1)과 오프셋 정규화 L_reg을 추가한 형태이며, λ_sem을 크게 잡아 의미 기반 샤프닝을 강조한다. 결과적으로 PSNR·SSIM은 약간 감소하지만, FID·LPIPS·FloLPIPS에서는 확산 기반 최신 모델(Consec. BB, TLB‑VFI)과 동등하거나 더 좋은 수치를 기록한다. 특히 SNU‑FILM Easy에서 FID 4.557을 달성해 확산 모델을 앞섰으며, Hard·Extreme에서도 실시간 모델 대비 8~10배 높은 퍼셉션 품질을 유지한다.

전체적으로 SG‑RIFE는 의미 주입을 통한 흐름 보강이라는 새로운 패러다임을 제시한다. 고정된 대규모 비전 트랜스포머를 경량 어댑터와 변형 정렬 모듈로 효율적으로 활용함으로써, 실시간 요구와 고품질 퍼셉션 사이의 트레이드오프를 크게 완화한다. 향후 다양한 저해상도·고프레임 레이트 시나리오와 멀티‑모달 VFI에 확장 가능성이 높다.

댓글 및 학술 토론

Loading comments...

의견 남기기