AtlasSegFM: 한 장의 아틀라스로 맞춤형 의료 영상 분할을 구현하는 새로운 프레임워크

초록

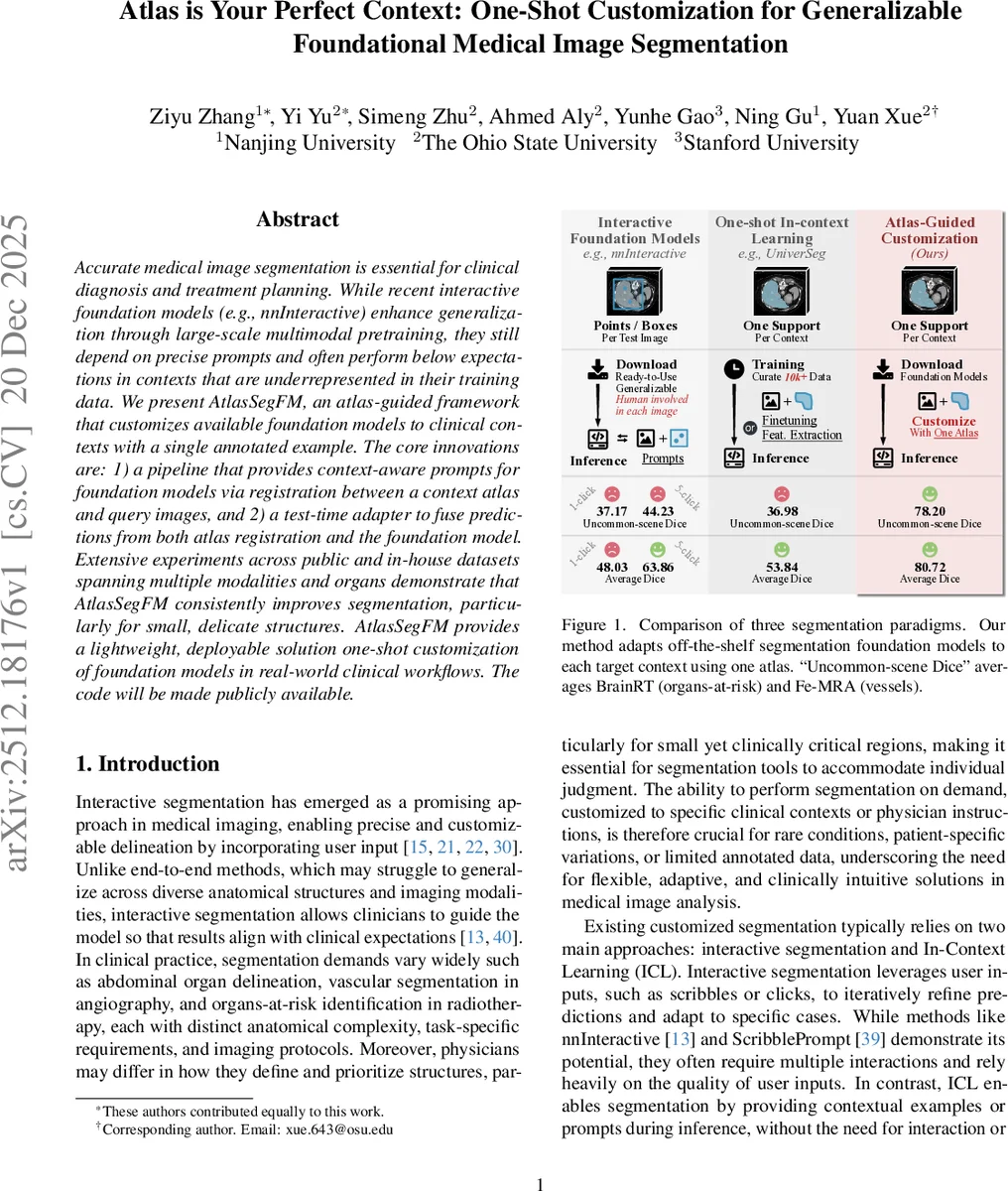

본 논문은 단일 라벨링된 아틀라스를 이용해 기존 의료 영상 분할 파운데이션 모델을 한 번의 커스터마이징만으로 다양한 임상 상황에 적용할 수 있는 AtlasSegFM을 제안한다. 아틀라스‑이미지 정합을 통해 구조적 프롬프트(클릭·박스·마스크)를 생성하고, 이를 파운데이션 모델에 제공한 뒤 테스트‑타임 어댑티브 퓨전 모듈로 두 예측을 결합한다. 다중 모달리티·다기관 데이터셋에서 특히 작은 구조에 대한 성능 향상이 입증되었다.

상세 분석

AtlasSegFM은 “one‑shot customization”이라는 실용적 과제를 정의하고, 기존 인터랙티브 세그멘테이션과 In‑Context Learning(ICL)의 한계를 극복한다는 점에서 의미가 크다. 핵심 아이디어는 (1) 아틀라스 기반 정합을 테스트‑타임에 수행해 정밀한 구조적 사전 정보를 얻고, (2) 이 정보를 파운데이션 모델에 프롬프트 형태로 제공함으로써 모델이 모호한 사용자 입력 없이도 정확한 영역을 인식하도록 하는 것이다. 정합 단계에서는 VoxelMorph를 변형해 매 이미지마다 파라미터를 최적화하는 테스트‑타임 최적화 방식을 채택했으며, 강체·세밀 정합을 순차적으로 적용해 초기 정렬 오류를 최소화한다. 정합 결과로 얻은 마스크 M_atlas는 크게 세 가지 프롬프트로 변환된다. 클릭 프롬프트는 가장 큰 연결 영역의 중심을, 박스 프롬프트는 최소 외접 박스를, 마스크 프롬프트는 전체 라벨을 그대로 사용한다. 이러한 다중 프롬프트는 nnInteractive, Med‑SAM 등 다양한 인터랙티브 파운데이션 모델뿐 아니라 VesselFM과 같은 비‑인터랙티브 모델에도 적용 가능하도록 설계되었다.

파운데이션 모델이 출력한 예측 M_fm과 아틀라스 정합에서 직접 얻은 마스크 M_atlas는 어댑티브 퓨전 모듈에서 결합된다. 퓨전 모듈은 각 voxel마다 두 예측의 신뢰도를 추정하는 gain map G를 학습하고, 최종 출력은 Ŷ = G·M_fm + (1‑G)·M_atlas 형태로 계산된다. 이 방식은 작은 구조처럼 파운데이션 모델이 약한 경우 아틀라스의 강인한 구조 정보를 보완하고, 반대로 파운데이션 모델이 잘 학습된 영역에서는 그 성능을 그대로 활용한다는 장점을 제공한다.

실험에서는 공개 BrainRT, Fe‑MRA, AbdomenCT 등 7개 데이터셋과 자체 수집한 복합 모달리티 데이터를 사용했으며, 특히 “uncommon‑scene Dice”(희귀·소형 구조)에서 기존 nnInteractive(5‑click) 대비 30% 이상 절대 향상을 기록했다. Ablation study에서는 (i) 정합 없이 프롬프트만 사용했을 때 성능 저하, (ii) 퓨전 없이 단일 예측만 사용했을 때 소형 구조에서의 Dice 감소, (iii) 테스트‑타임 정합 대신 사전 학습된 정합 네트워크 사용 시 연산량은 감소하지만 정확도가 떨어지는 현상을 확인했다. 또한, 파운데이션 모델 종류를 바꿔도(예: SAM‑3D, VesselFM) 전반적인 개선 효과가 일관되게 나타났다.

이 논문의 주요 강점은 (1) 라벨링 비용을 1장 아틀라스로 최소화, (2) 파운데이션 모델을 그대로 재사용하면서도 임상별 맞춤형 성능을 확보, (3) 테스트‑타임에만 추가 연산이 필요해 기존 의료 워크플로에 쉽게 통합 가능하다는 점이다. 다만, 정합 단계가 여전히 GPU 메모리를 요구하고, 매우 복잡한 변형(예: 수술 후 변형된 장기)에서는 정합 정확도가 제한될 수 있다는 점은 향후 연구 과제로 남는다.

댓글 및 학술 토론

Loading comments...

의견 남기기