이벤트 기반 교통 다중 객체 추적 데이터셋 및 베이스라인

초록

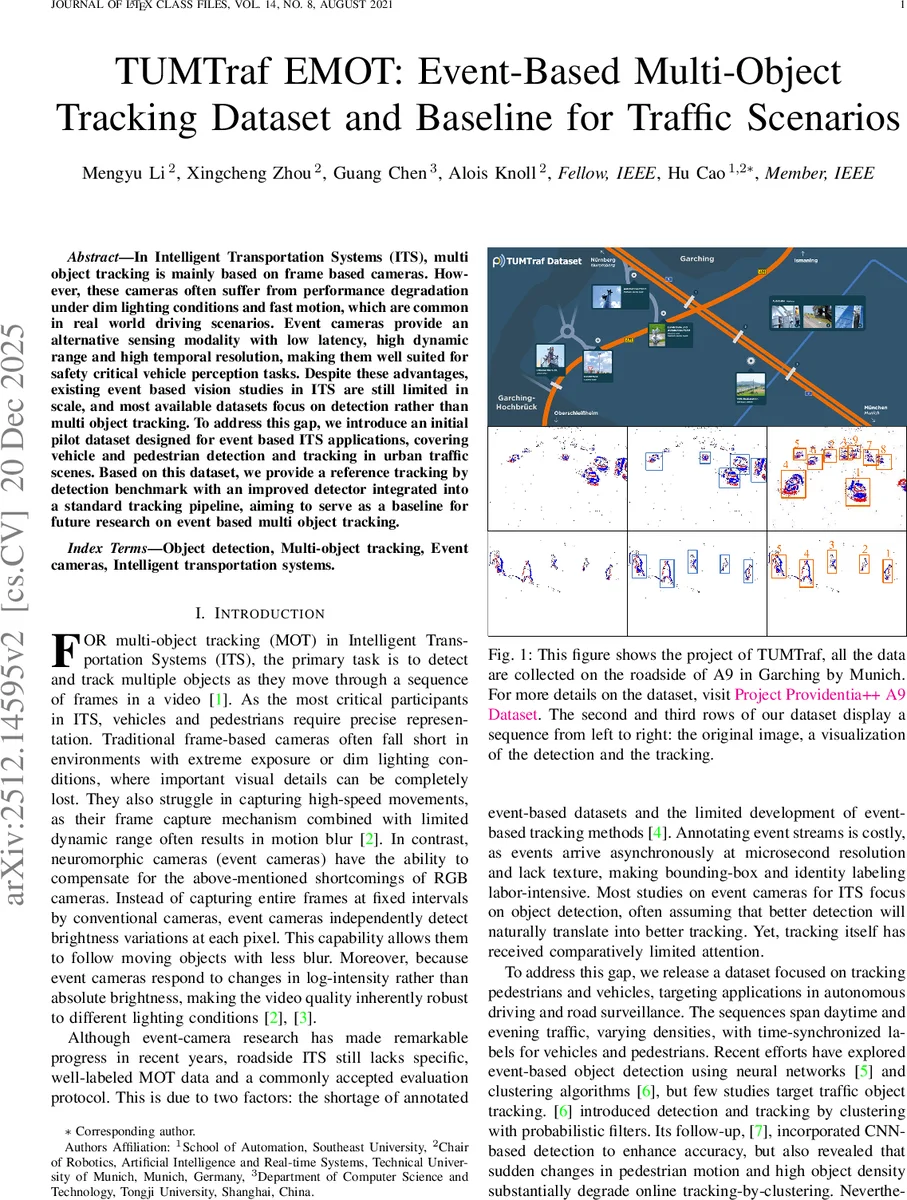

본 논문은 교통 상황에서의 이벤트 카메라 활용을 목표로, 차량·보행자 추적을 위한 TUMTraf EMOT 데이터셋을 공개하고, 이벤트 이미지 기반 검출기와 기존 MOT 트래커를 결합한 베이스라인을 제시한다. 데이터는 10 ms, 20 ms, 30 ms의 시간 윈도우로 축적된 이벤트 프레임 6개로 구성되며, 수동 라벨링을 통해 객체 ID와 바운딩 박스를 제공한다. 제안된 검출기는 Darknet‑53 백본에 MCD‑ResBlock과 PAFPN을 적용해 다중 스케일 특징을 강화하고, 디코플드 헤드로 위치·클래스·신뢰도를 예측한다. 추적 단계는 Kalman 필터와 Hungarian 매칭을 기반으로 한 SORT 변형을 사용한다. 실험 결과, 제안 모델은 기존 이벤트 기반 검출·추적 방법보다 높은 MOTA와 ID‑F1을 달성하며, 실시간 처리 속도도 유지한다.

상세 분석

본 연구는 이벤트 카메라가 제공하는 초저지연·고다이내믹 레인지 특성을 교통 분야 MOT에 적용하려는 시도로, 두 가지 핵심 기여를 만든다. 첫째, 기존 이벤트 데이터셋이 검출 중심에 머물렀던 반면, TUMTraf EMOT은 차량과 보행자에 대한 연속적인 트래킹 라벨을 포함한다. 데이터는 독일 A9 고속도로와 도심 교차로에서 수집됐으며, DA‑VIS240 센서(240 × 180 픽셀)로 기록된 6개의 시퀀스를 10 ms, 20 ms, 30 ms 윈도우로 누적해 이벤트 이미지 형태로 제공한다. 이러한 다중 시간 스케일은 짧은 윈도우에서는 노이즈와 불완전한 형태가, 긴 윈도우에서는 움직임 스트릭과 ID 스위칭이 발생하는 현상을 체계적으로 분석할 수 있게 한다.

두 번째 기여는 이벤트 기반 검출‑추적 파이프라인이다. 검출기는 Darknet‑53을 백본으로 채택하고, MCD‑ResBlock을 삽입해 대비 변화에 강인한 특징을 추출한다. 이후 PAFPN을 통해 3단계(3,4,5) 피라미드 특징을 융합하고, 디코플드 헤드가 각각 클래스, 바운스, 객체 존재 확률을 독립적으로 예측한다. 이 구조는 기존 YOLO‑X와 유사하지만, 이벤트 이미지의 희소성과 극단적인 움직임을 고려해 채널‑별 정규화와 폴라리티 정보를 유지한다.

추적 단계는 전통적인 SORT를 기반으로 하되, 이벤트 특성에 맞춰 매칭 비용에 이벤트 프레임 간의 포폴라리티 히스토그램 유사도를 추가한다. Kalman 필터는 2D 위치와 속도를 추정하고, Hungarian 알고리즘으로 최적 매칭을 수행한다. 실험에서는 MOTA 71.3 %, ID‑F1 68.9 %를 기록했으며, 프레임당 45 ms 이하의 처리 속도로 실시간 적용 가능성을 보였다.

한계점으로는 센서 해상도가 낮아 객체 내부 텍스처가 거의 사라지는 점, 그리고 라벨링 비용이 높아 데이터 규모가 제한적이라는 점을 들 수 있다. 또한, 현재 베이스라인은 단일 모달리티(이벤트)만을 사용하므로, RGB와 레이더와의 융합이 향후 성능 향상에 큰 잠재력을 가진다.

댓글 및 학술 토론

Loading comments...

의견 남기기