디지털 트윈을 움직이는 손, Dexterous World Models

초록

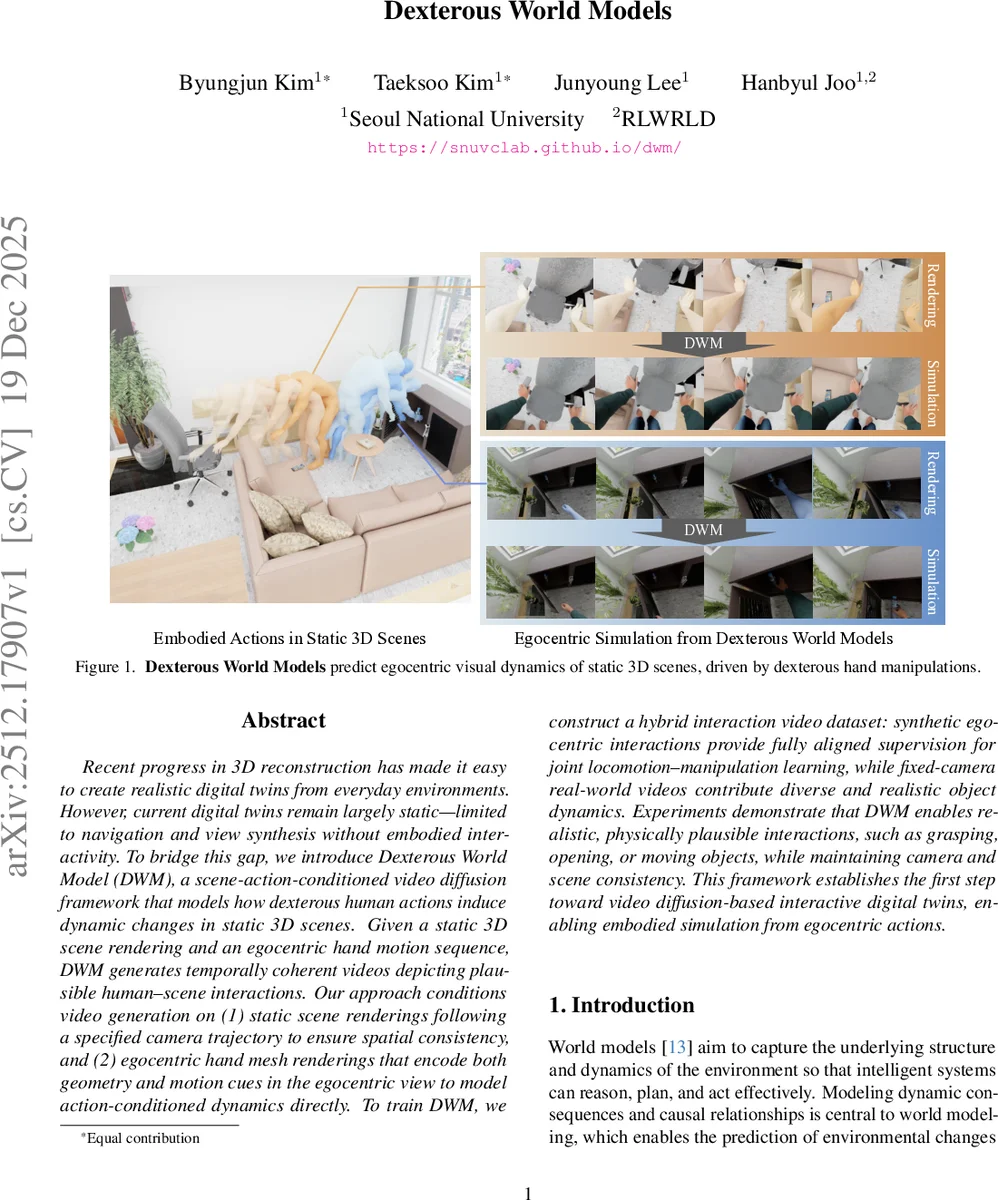

Dexterous World Models(DWM)은 정적인 3D 씬과 사람의 손 동작을 입력으로 받아, 손이 물체를 잡고 움직이는 등 실제와 같은 상호작용을 영상으로 생성하는 확산 기반 모델이다. 정적 씬 렌더링과 손 메쉬 렌더링을 조건으로 사용해 공간 일관성을 유지하면서 동적 변화를 잔여(residual) 형태로 학습한다. 합성 데이터와 실제 고정 카메라 영상을 혼합한 하이브리드 데이터셋으로 훈련했으며, 물체 잡기·열기·이동 등 물리적으로 타당한 상호작용을 실시간으로 시뮬레이션한다.

상세 분석

본 논문은 기존의 비디오 생성·월드 모델이 “전체 장면을 재구성”하는 방식에서 벗어나, 정적인 배경은 그대로 두고 손 동작에 의해 발생하는 잔여 변화만을 모델링한다는 점에서 혁신적이다. 이를 위해 두 가지 핵심 입력을 정의한다. 첫째, 정적인 3D 씬을 지정된 카메라 궤적에 따라 렌더링한 영상으로, 이는 공간적 일관성과 배경 텍스처를 그대로 전달한다. 둘째, 손의 메쉬를 동일한 카메라 시점에서 렌더링한 영상으로, 손의 자세·위치·속도 정보를 풍부하게 제공한다. 이러한 egocentric 렌더링은 인간이 실제로 손을 보며 행동을 계획하는 인지 과정을 그대로 반영한다는 점에서 의미가 크다.

모델 아키텍처는 사전 학습된 비디오 인페인팅 확산 모델을 초기화 파라미터로 사용한다. 인페인팅 모델은 마스크가 전부 열릴 때 입력 영상을 거의 그대로 복원하는 “identity mapping” 특성을 가지며, 동시에 공간·시간적 연속성을 보존하는 강력한 생성 사전을 내재한다. DWM은 이 특성을 활용해 정적 배경은 그대로 유지하고, 손 동작에 의해 발생하는 작은 영역의 변화를 잔여(ΔV) 형태로 학습한다. 즉, 손 메쉬와 배경 영상을 조건으로 넣으면, 확산 과정에서 마스크가 손이 접촉하는 영역에만 적용되어 물체 변형·이동을 생성한다.

학습 데이터는 두 부분으로 구성된다. 첫 번째는 합성 3D 인간‑씬 인터랙션 데이터로, 카메라 궤적과 손 메쉬가 완벽히 정렬돼 있어 정확한 지도 학습이 가능하다. 그러나 합성 데이터는 물리적 다양성이 제한적이므로, 두 번째로 실제 고정 카메라에서 촬영된 인터랙션 영상을 도입한다. 이 실세계 영상은 물체의 물리적 반응과 조명 변화를 풍부하게 제공하지만, 카메라 궤적이 정해져 있어 정적 씬 렌더링과 직접적인 정렬이 어려운 점을 보완한다. 두 데이터셋을 혼합함으로써 DWM은 정밀한 동작-시각 정합성과 현실적인 물리 현상을 동시에 학습한다.

실험에서는 물체 잡기, 문 열기, 물체 이동 등 다양한 손-물체 상호작용을 시뮬레이션했으며, 정적 씬의 카메라 움직임과 일치하는 시각적 일관성을 유지한다. 또한, 생성된 영상이 물리 엔진 기반 시뮬레이션과 비교했을 때 유사한 동작 궤적과 물체 변형을 보이며, 정량적 평가에서 PSNR·SSIM·LPIPS 등에서 기존 비디오 디퓨전 모델보다 우수한 결과를 얻었다.

의미론적으로 DWM은 “시각적 월드 모델”의 새로운 패러다임을 제시한다. 행동 입력을 텍스트가 아닌 손 메쉬라는 구체적 기하학 정보로 받음으로써, 인간 수준의 미세 조작을 시뮬레이션할 수 있다. 이는 로봇 매니퓰레이션, AR/VR 인터랙티브 콘텐츠, 디지털 트윈 기반 시뮬레이션 등 다양한 응용 분야에 직접적인 활용 가능성을 열어준다. 또한, 잔여 학습 방식은 기존 전체 프레임 재생성 모델보다 학습 효율과 안정성을 높이며, 향후 더 복잡한 다중 손·다중 객체 상호작용으로 확장될 여지를 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기