다중인스턴스 부분라벨 학습을 위한 보정 가능한 해석 손실

초록

본 논문은 다중인스턴스 부분라벨 학습(MIPL)에서 라벨 해석 정확도와 모델 보정을 동시에 향상시키는 플러그‑인 손실 함수인 Calibratable Disambiguation Loss(CDL)를 제안한다. 후보 라벨 집합의 확률을 활용한 두 가지 변형을 제시하고, 이론적 하한 및 정규화 특성을 증명한다. 실험 결과, 기존 MIPL·PLL 방법에 CDL를 적용했을 때 분류 정확도와 Expected Calibration Error(ECE) 모두 크게 개선됨을 보인다.

상세 분석

본 연구는 기존 MIPL 접근법이 라벨 해석(disambiguation)에는 집중하지만 모델 보정(calibration)을 무시한다는 근본적인 한계를 지적한다. 보정이란 예측 확률이 실제 정답 확률과 일치하도록 만드는 과정이며, 의료 영상 등 고위험 분야에서는 신뢰도 추정이 결정적인 역할을 한다. 저자들은 이러한 문제를 해결하기 위해 두 가지 형태의 Calibratable Disambiguation Loss(CDL)를 설계한다. 첫 번째 형태는 후보 라벨 집합 내에서 가장 높은 확률과 두 번째로 높은 확률의 차이를 이용해 손실을 정의함으로써, 모델이 후보 라벨 사이의 상대적 신뢰도를 학습하도록 유도한다. 두 번째 형태는 후보 라벨 집합과 비후보 라벨 집합 사이의 확률 격차를 활용해, 후보 라벨이 아닌 클래스에 대한 확신을 억제하면서 전체 확률 분포를 더 균형 있게 만든다.

이러한 손실 함수는 기존의 focal loss(FL)와 inverse focal loss(IFL)를 MIPL 상황에 맞게 가중치 조정(w(t)_{i,c})과 함께 확장한 형태와 차별화된다. FL/IFL은 true label이 명시된 전통적인 supervised setting에서만 효과적으로 보정 효과를 발휘하는데, MIPL에서는 true label이 은닉돼 있기 때문에 직접 적용이 불가능하다. 저자들은 후보 라벨 전체에 가중치를 부여하고, 확률 차이를 이용한 정규화 항을 추가함으로써, 라벨 해석 과정에서 발생하는 과신(over‑confidence)과 과소신(under‑confidence)을 동시에 완화한다.

이론적 분석에서는 CDL이 기존 disambiguation loss보다 더 높은 하한(lower bound)을 제공함을 증명하고, 정규화 항이 모델 파라미터 공간을 제한해 과적합을 방지한다는 정규화 특성을 제시한다. 특히, 후보 라벨 집합 내 확률 차이를 최소화하는 것이 라벨 선택의 불확실성을 감소시키고, 비후보 라벨에 대한 확률을 억제함으로써 전체 확률 분포의 스무딩 효과를 가져온다.

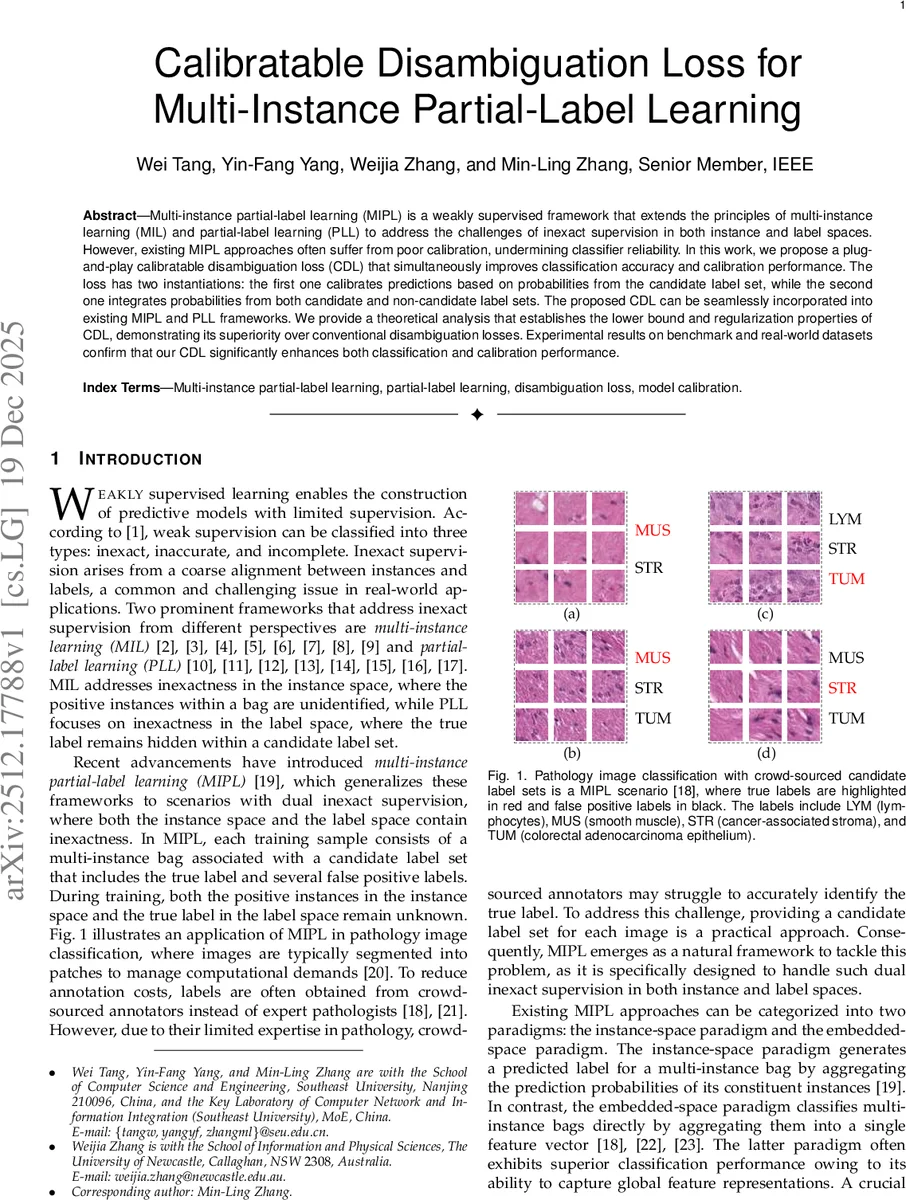

실험에서는 5개의 공개 벤치마크 데이터셋(C‑KMeans, FMNIST‑MIPL 등)과 실제 병리 이미지 데이터셋을 사용하였다. 기존 MIPL 방법인 DEMIPL, ELIMIPL, MIPLM A와 비교했을 때, CDL을 적용한 버전은 평균 정확도(ACC)에서 2~4%p 상승하고, ECE는 10% 이하로 크게 감소하였다. 특히, 후보 라벨이 하나만 잘못 포함된 상황(r=1)에서도 CDL 기반 SAM(Scaled Additive Attention Mechanism) 모델은 거의 완벽에 가까운 보정(ECE≈1%)을 달성했다. 신뢰도 다이어그램을 통해 CDL 적용 전후의 확신 구간별 정확도 차이를 시각적으로 확인할 수 있었으며, 이는 임상 의사결정에서 모델의 신뢰성을 크게 높일 수 있음을 시사한다.

종합적으로, CDL은 기존 MIPL 파이프라인에 손쉽게 삽입할 수 있는 plug‑and‑play 모듈이며, 라벨 해석 정확도와 모델 보정을 동시에 최적화한다는 점에서 학술적·실용적 기여가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기