생성적 인간객체 상호작용 탐지를 위한 차별적 인지 스티어링

초록

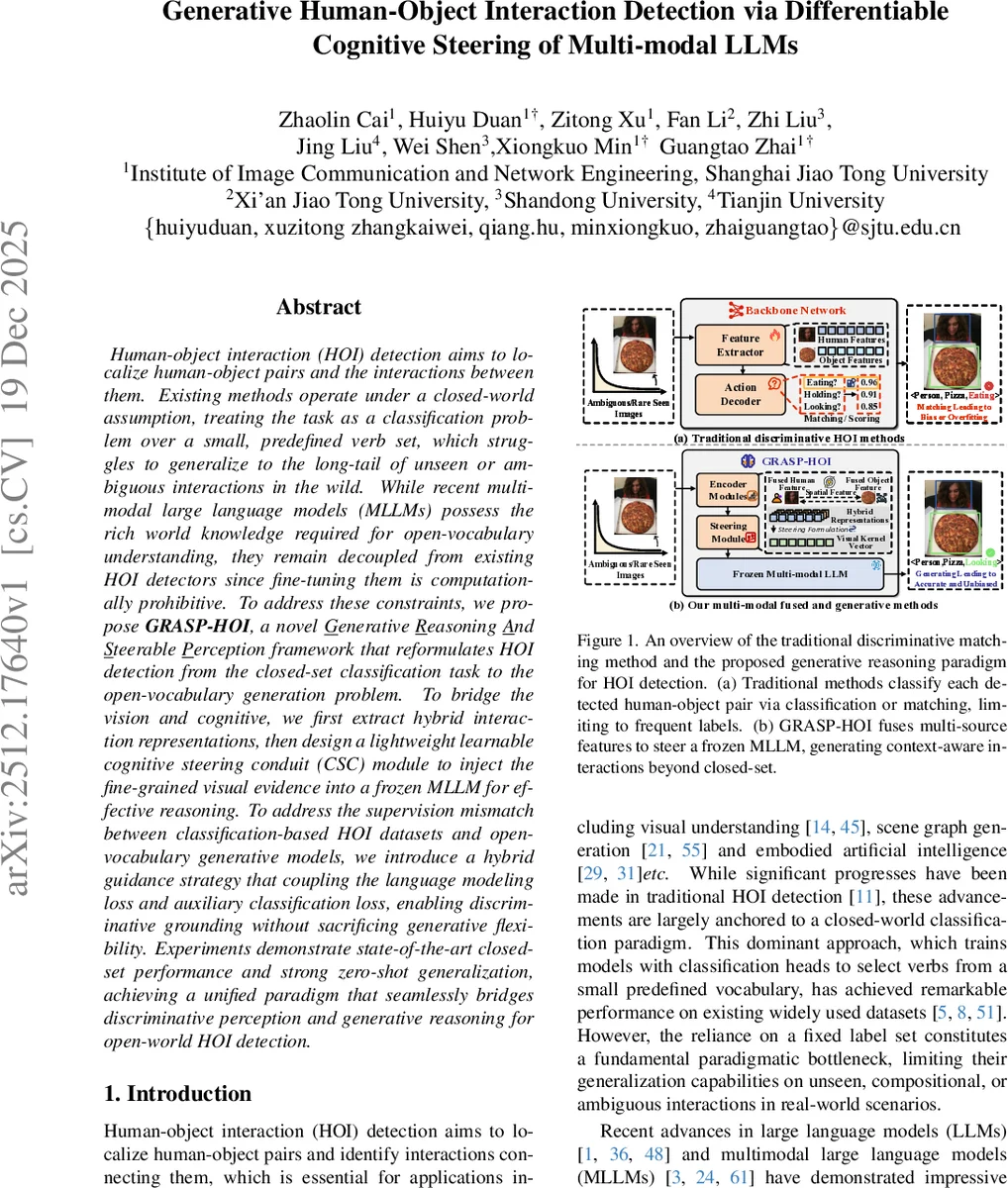

GRASP‑HOI는 기존의 폐쇄형 동사 분류 방식을 탈피해, 시각적 증거를 경량화된 인지 스티어링 모듈(CSC)을 통해 고정된 멀티모달 대형 언어 모델에 주입함으로써 열린 어휘(오픈‑보카뷸러리) 인간‑객체 상호작용을 생성적으로 예측한다. 언어 모델 손실과 보조 분류 손실을 결합한 하이브리드 가이던스로 기존 HOI 데이터셋의 분류 라벨을 활용하면서도 자유로운 텍스트 생성 능력을 유지한다. 실험 결과 HICO‑DET와 V‑COCO에서 최첨단 폐쇄형 성능을 기록했으며, 제로샷 및 오픈‑보카뷸러리 설정에서도 강력한 일반화 능력을 보였다.

상세 분석

본 논문은 인간‑객체 상호작용(HOI) 탐지를 “분류 → 생성” 패러다임으로 전환한다는 근본적인 아이디어를 제시한다. 기존 HOI 모델은 사전 정의된 동사 집합에 대해 다중 클래스 분류기를 학습함으로써, 데이터셋에 존재하지 않는 장기 꼬리(long‑tail) 동사나 새로운 조합에 취약했다. 반면, 최근 멀티모달 대형 언어 모델(MLLM)은 방대한 세계 지식과 언어 추론 능력을 보유하고 있지만, 직접 파인튜닝하면 계산 비용이 과다하고 사전 학습된 지식이 손상될 위험이 있다.

GRASP‑HOI는 이러한 딜레마를 해결하기 위해 Hybrid Interaction Representation과 **Cognitive Steering Conduit(CSC)**라는 두 핵심 모듈을 도입한다.

-

Hybrid Interaction Representation: 인간과 객체 각각에 대해 탐지기에서 얻은 인스턴스 토큰(z)과 RoI‑Pooling을 통해 추출한 외형 토큰(a)를 각각 ϕ_inst, ϕ_app으로 투영 후 MLP로 융합해 f_x를 만든다. 이어서 인간‑객체 쌍(k)에 대해 정규화된 거리·스케일·오버랩 등을 포함한 기하학적 벡터 g_k를 ϕ_g를 통해 얻는다. 최종적으로 (f_h, f_o, g_k)를 concat하고 선형 투영해 후보 토큰 u_k를 만든다.

-

**Salience Adjudication Transformer (SAT)**와 Orchestration Gate (OG): u_k 시퀀스를 SAT에 입력해 전 후보 간의 상호작용(예: 동일 객체에 대한 경쟁, 포즈 상호 배제 등)을 고려한 컨텍스트 토큰 ˜u_k를 생성한다. 이후 시그모이드 기반의 원시 살리언스 점수 s_k와 탐지기 confidence(conf_h, conf_o)를 가중합(α)해 최종 점수 r_k를 산출하고, 인간당 상위 N개의 후보만을 선택해 후보 집합 P*를 만든다.

-

Cognitive Steering Conduit: 후보 토큰 v_k와 고정된 MLLM의 비전 인코더에서 추출한 전역 장면 토큰을 결합해 증거 벡터 e_k를 만든다. e_k를 시각 커널 포뮬레이터에 입력해 시퀀셜 시각 커널 Q_k를 생성하고, 이를 MLLM의 텍스트 디코더에 “조건”으로 주입한다. 이렇게 하면 MLLM은 기존의 자유로운 텍스트 생성 능력을 유지하면서도, 시각적 증거에 의해 구체적인 동사와 객체 관계를 유도한다.

Hybrid Guidance는 두 가지 손실을 동시에 최적화한다. (i) Language Modeling Loss는 MLLM이 정답 동사 시퀀스를 생성하도록 유도하고, (ii) Auxiliary Classification Loss는 기존 HOI 라벨을 이용해 v_k가 올바른 동사 클래스를 포함하도록 강제한다. 이중 손실 구조는 “분류 기반 데이터와 생성 기반 모델 사이의 감독 불일치”를 완화하고, 모델이 자유롭게 새로운 동사를 생성하면서도 기본적인 구분 능력을 잃지 않게 만든다.

실험에서는 HICO‑DET와 V‑COCO 두 벤치마크에서 기존 최첨단(Closed‑Set) 방법들을 능가했으며, 특히 Zero‑Shot 설정에서 “보지 못한 동사‑객체 조합”에 대해 높은 mAP를 기록했다. 이는 CSC가 시각적 증거를 효과적으로 MLLM에 전달해, 사전 학습된 세계 지식을 활용한 추론을 가능하게 했기 때문이다. 또한, 파라미터 효율성 측면에서 CSC는 경량화된 모듈(수백만 파라미터)만을 추가했으며, MLLM 자체는 동결(frozen) 상태를 유지해 학습 비용을 크게 절감했다.

핵심 기여는 다음과 같다.

- 폐쇄형 분류에서 열린 어휘 생성으로 HOI 탐지 패러다임을 전환.

- 시각‑언어 간 차별적 인지 스티어링을 구현한 CSC 설계.

- 언어 모델 손실과 보조 분류 손실을 결합한 하이브리드 목표 함수 제시.

- 다양한 벤치마크에서 SOTA 성능과 강력한 제로샷 일반화 입증.

이러한 접근은 향후 복합적인 인간 행동 이해, 로봇 협동, 비디오 이해 등에서 “시각적 근거 기반의 자유로운 언어 생성”을 요구하는 응용 분야에 중요한 토대를 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기