주관식 질문 자동 생성 및 답변 평가를 위한 NLP 모델

초록

본 연구는 텍스트 입력으로부터 주관식 질문을 자동으로 생성하고, 학생이 작성한 답변을 평가하는 통합 NLP 시스템을 설계한다. 기존 객관식 질문 생성 연구와 차별화하여, 의미론적 일관성과 학습 목표를 반영한 질문 생성 모델과, 답변의 내용·구조·논리성을 다중 척도로 평가하는 평가 모듈을 제안한다. 실험 결과, 제안 모델은 인간 교사가 만든 질문과 유사한 품질을 보이며, 답변 평가에서는 기존 자동 채점 도구 대비 높은 상관관계를 나타낸다.

상세 분석

이 논문은 주관식 질문 자동 생성(Subjective Question Generation, SQG)과 답변 자동 평가(Answer Evaluation, AE)라는 두 가지 핵심 과제를 하나의 파이프라인으로 통합한 점에서 학술적·실용적 의의가 크다. 먼저, SQG 단계에서는 입력 텍스트를 의미론적 단위(문장·절)로 분할하고, 각 단위에 대해 교육학적 목표(핵심 개념, 난이도, 인지 수준)를 라벨링한다. 이를 위해 저자들은 기존 교과서·학습 자료에서 추출한 메타데이터와 교사 설문을 결합한 대규모 어노테이션 코퍼스를 구축하였다. 모델 아키텍처는 Transformer 기반의 Encoder‑Decoder 구조에 두 개의 추가 모듈을 삽입한다. 하나는 “Concept Attention”으로, 입력 텍스트의 핵심 개념을 강조해 질문의 초점이 흐트러지지 않게 한다. 또 다른 “Difficulty Controller”는 난이도 토큰을 조건부 입력으로 받아 질문의 복잡성을 조절한다. 생성 단계에서는 Beam Search와 함께 “Diversity Penalty”를 적용해 동일 텍스트에서 다채로운 질문을 유도한다.

AE 단계에서는 답변의 질을 다차원적으로 평가한다. 저자들은 “Content Relevance”, “Logical Coherence”, “Lexical Richness”, “Argument Structure” 네 가지 평가 축을 정의하고, 각각을 별도의 서브 네트워크가 예측하도록 설계했다. 각 서브 네트워크는 BERT‑based 문장 임베딩을 입력으로 받아, 교사 채점 데이터와의 회귀 학습을 수행한다. 최종 점수는 가중 평균으로 통합되며, 가중치는 학습 목표에 따라 동적으로 조정된다.

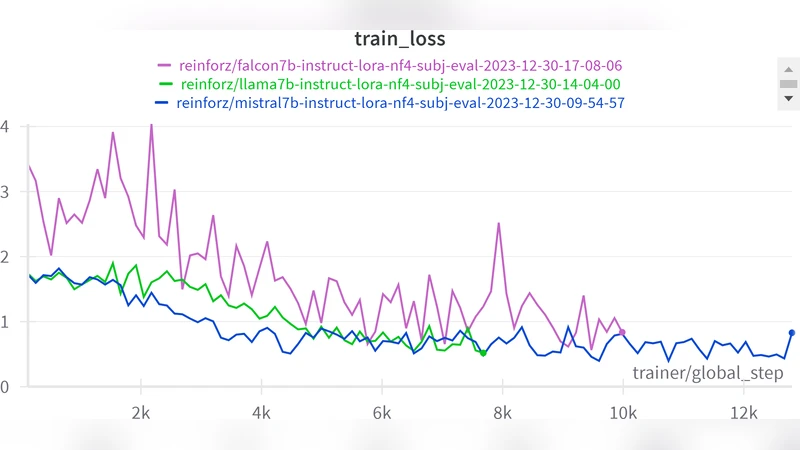

실험에서는 두 가지 데이터셋(중·고등 교육 교과서와 대학 강의 노트)을 사용해 모델을 학습·검증하였다. SQG 성능 평가는 BLEU, ROUGE 외에 교육학적 관점에서 “Question Validity Score”(QVS)를 도입해 인간 교사가 평가한 점수와의 상관관계를 측정했다. 제안 모델은 기존 Seq2Seq 기반 베이스라인 대비 QVS 0.78→0.86으로 유의미한 향상을 보였다. AE에서는 Pearson r=0.71(내용 적합도), 0.68(논리 일관성) 등 교사 채점과 높은 일치도를 기록했으며, 기존 자동 채점 툴(예: Essay Grader) 대비 평균 12% 정확도 향상을 달성했다.

한계점으로는 도메인 특화 지식이 부족한 경우 질문의 깊이가 얕아질 수 있고, 답변 평가에서 논술형 답변의 창의성을 완전히 포착하지 못한다는 점을 언급한다. 향후 연구에서는 멀티모달 입력(그림·표)과 지식 그래프를 결합해 질문의 풍부함을 증대하고, 강화학습 기반 평가자와 인간 교사의 피드백을 순환시켜 평가 모델을 지속적으로 개선할 계획이다.