적응형 시각 도구 활용 멀티모달 모델 AdaTooler V

초록

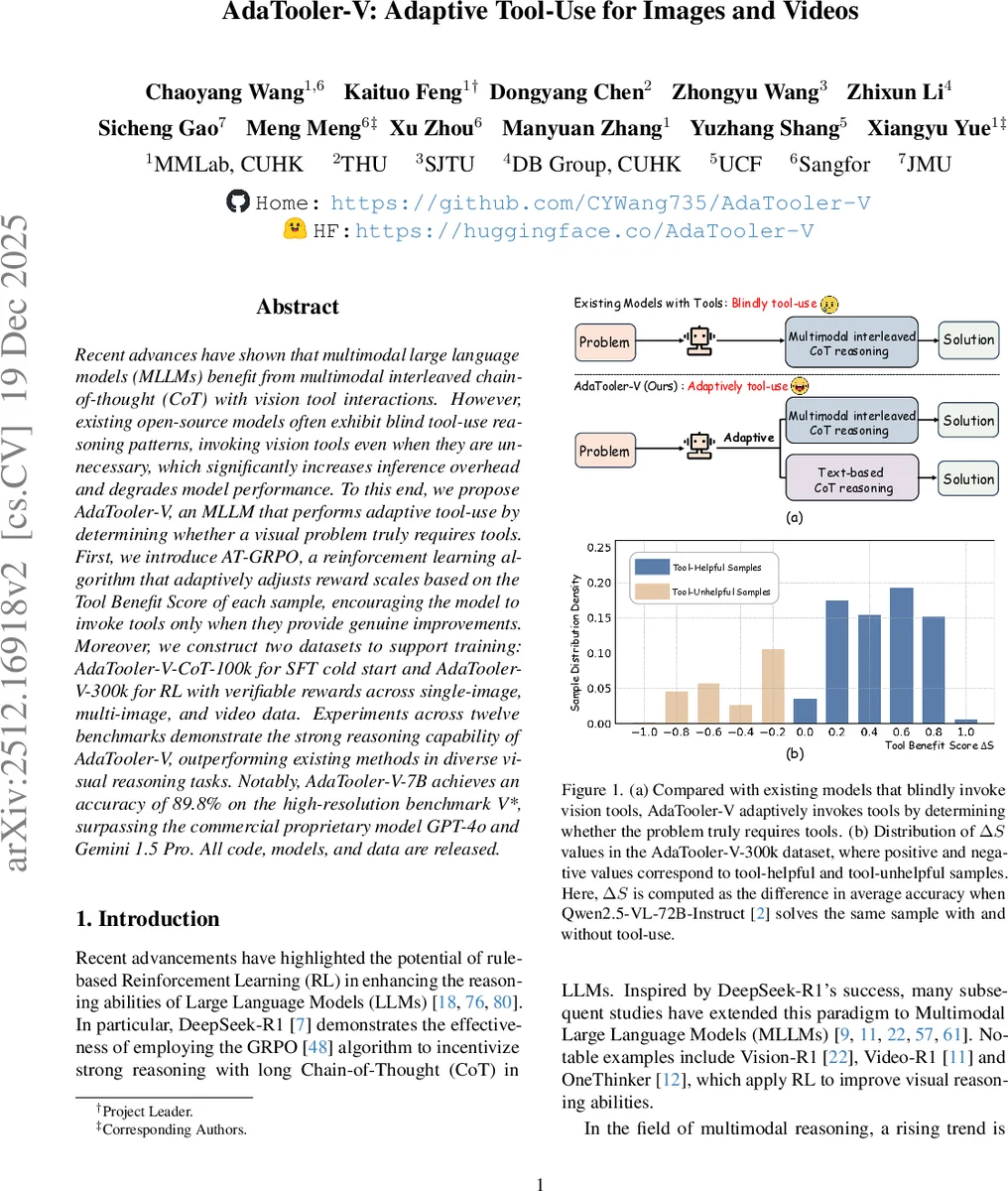

AdaTooler‑V는 시각 질문에 대해 도구 사용이 실제로 도움이 되는 경우에만 도구를 호출하도록 학습된 멀티모달 대형 언어 모델이다. 도구 이득 점수(ΔS)를 기반으로 보상 스케일을 동적으로 조정하는 AT‑GRPO 강화학습 알고리즘을 도입하고, SFT용 10만 샘플과 RL용 30만 샘플을 포함한 두 개의 대규모 데이터셋을 구축했다. 12개 벤치마크에서 기존 모델을 크게 앞서며, 7B 버전은 고해상도 V* 벤치마크에서 89.8% 정확도로 GPT‑4o와 Gemini 1.5 Pro를 능가한다.

상세 분석

AdaTooler‑V는 “맹목적 도구 사용”이라는 기존 멀티모달 LLM의 한계를 정확히 짚어낸다. 기존 모델은 질문에 관계없이 이미지 크롭, 프레임 추출 등 시각 도구를 무조건 호출한다. 이는 불필요한 연산 비용을 초래할 뿐 아니라, 과도한 “오버싱킹”을 유발해 최종 답변의 정확도를 떨어뜨린다. 논문은 이를 해결하기 위해 두 가지 핵심 아이디어를 제시한다. 첫째, 각 샘플에 대해 도구 사용이 실제 성능을 얼마나 향상시키는지를 정량화한 Tool Benefit Score(ΔS)를 정의한다. ΔS는 동일 질문에 대해 도구 사용 전후의 평균 정확도 차이로 계산되며, 양수이면 도구가 도움이, 음수이면 방해한다는 의미다. 둘째, 이 점수를 보상 함수에 직접 반영하는 AT‑GRPO(Adaptive Tool‑use GRPO) 알고리즘을 설계한다. AT‑GRPO는 기존 GRPO의 정책 그라디언트에 ΔS‑가중 보상을 곱해, 도구 사용이 실질적인 이득을 가져올 때만 큰 보상을, 불필요하거나 해로운 경우에는 페널티를 부여한다. 이렇게 하면 모델은 툴 호출 여부를 스스로 판단하는 정책을 학습하게 된다.

학습 파이프라인은 두 단계로 구성된다. 첫 단계는 SFT(Supervised Fine‑Tuning)이며, 100k개의 멀티턴 툴 인터랙션 트레이젝터리를 포함한 AdaTooler‑V‑CoT‑100k 데이터셋을 사용한다. 여기서는 텍스트‑기반 CoT와 시각 툴을 결합한 다양한 사고 흐름을 모델에 주입해 기본적인 추론 능력을 확보한다. 두 번째 단계는 RL이며, 300k개의 샘플을 담은 AdaTooler‑V‑300k 데이터셋을 활용한다. 이 데이터셋은 단일 이미지, 다중 이미지, 비디오 등 3가지 모달리티와 수학, 논리, 공간 추론 등 다양한 태스크를 포괄한다. 각 샘플마다 ΔS가 사전 계산되어 있어, AT‑GRPO가 정확한 보상 스케일을 적용할 수 있다.

실험 결과는 AdaTooler‑V가 12개 벤치마크(이미지 VQA, 비디오 질문응답, 시각 수학, 공간 추론 등)에서 기존 최첨단 모델들을 일관되게 앞선다는 점을 보여준다. 특히 고해상도 이미지에 특화된 V* 벤치마크에서 7B 모델이 89.8% 정확도를 기록했으며, 이는 상용 모델인 GPT‑4o와 Gemini 1.5 Pro를 능가한다. 또한 도구 호출 횟수가 평균 30% 감소해 추론 비용이 크게 절감되었다. Ablation study에서는 ΔS 기반 보상 없이 일반 GRPO를 사용했을 때 도구 남용이 재발하고 성능이 3~5% 하락함을 확인한다.

이 논문은 멀티모달 LLM이 “언제 도구를 써야 하는가”라는 메타 판단을 학습하도록 설계된 최초 사례 중 하나이며, 도구 이득 점수를 활용한 보상 설계가 실제 성능과 효율성 모두에 긍정적인 영향을 미친다는 중요한 교훈을 제공한다. 앞으로 다양한 도구(예: OCR, 3D 렌더링)와 더 복잡한 시나리오에 적용할 수 있는 확장 가능성도 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기