인간‑로봇 상호 모방으로 일반화된 비전‑언어‑액션 모델 MiVLA

초록

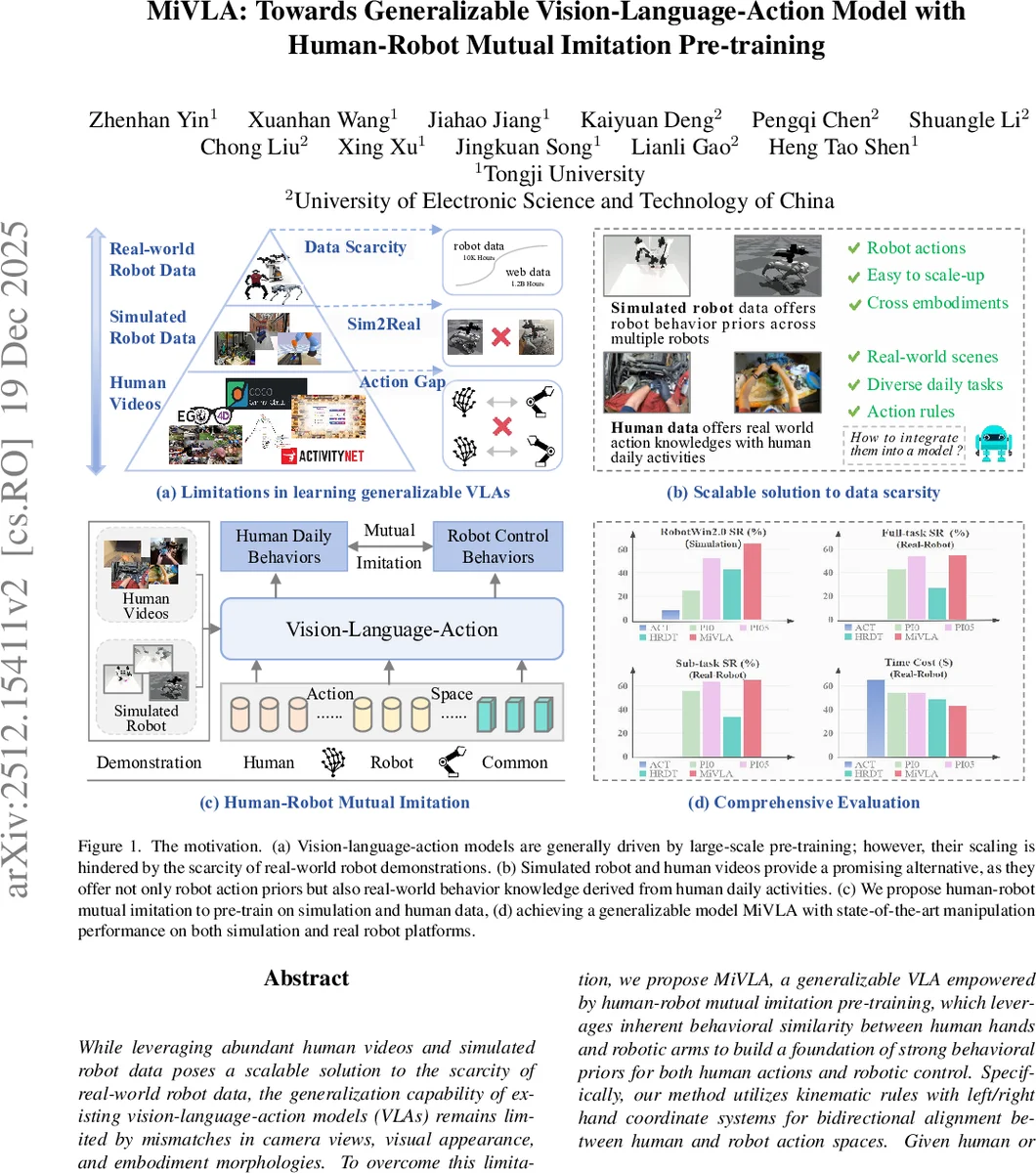

MiVLA는 인간 동영상과 시뮬레이션 로봇 데이터를 활용해 인간 손동작과 로봇 팔 동작을 양방향으로 정렬하는 kinematic 변환 규칙을 도입한다. 인간·로봇 시연을 서로 모방하도록 사전학습함으로써 실제 로봇 데이터 없이도 행동 선행지식을 통합하고, 시뮬레이션‑실제 격차와 형태 차이를 극복한다. 실험 결과, 시뮬레이션에서 25%, 실제 로봇에서 14%의 성공률 향상을 달성했다.

상세 분석

MiVLA는 기존 Vision‑Language‑Action(VLA) 모델이 실세계 로봇 시연 데이터 부족으로 일반화에 한계가 있다는 문제를 근본적으로 재구성한다. 핵심 아이디어는 ‘인간‑로봇 상호 모방(pre‑training)’이다. 저자는 인간 손목·엄지 관절과 로봇 엔드‑이펙터를 기준점으로 삼아 좌·우 손 좌표계를 이용한 양방향 kinematic 변환을 정의한다. 인간‑to‑Robot 변환에서는 인간 엄지의 상대 변위를 로봇 초기 엔드‑이펙터 위치에 적용하고, 역기구학(IK) 솔버를 통해 로봇 관절값을 복원한다. 반대로 Robot‑to‑Human 변환에서는 로봇 엔드‑이펙터를 인간 엄지 관절로 매핑하고, 해부학적 거리 추정 함수를 이용해 손가락 위치를 재구성한다. 이러한 변환은 두 형태 간의 행동 차이를 기하학적으로 최소화하면서, 동일한 시연을 서로 다른 구현체에 투사할 수 있게 한다.

모델 아키텍처는 대규모 멀티모달 토크나이저(DINOv2, SigLIP, T5)와 diffusion‑transformer 기반 연속 액션 디코더를 결합한다. 시각·언어·자세 정보를 공통 임베딩 공간에 투사하고, 노이즈가 섞인 액션 시퀀스를 조건부로 디노이징하면서 목표 행동을 생성한다. 학습 목표는 두 손실을 동시에 최소화하는 것이다. 로봇 시연에서는 (① 로봇 액션 재구성 손실, ② 로봇→인간 모방 손실) 을, 인간 시연에서는 (③ 인간 액션 재구성 손실, ④ 인간→로봇 모방 손실) 을 사용해 전체 손실 L=ℓ_r2h+ℓ_h2r 로 결합한다. 이렇게 하면 하나의 시연이 두 구현체에 대한 라벨을 자동 생성해 데이터 효율성을 크게 높인다.

실험은 세 종류의 로봇(ARX, PiPer, LocoMan)과 다양한 시뮬레이션·실제 작업에서 수행되었다. 비교 대상인 π₀, π₀.₅, H‑RDT와 비교했을 때, 시뮬레이션 전반에서 성공률 25% 향상, 실제 로봇에서는 14% 향상을 기록했다. 또한 시간 비용 측면에서도 MiVLA가 기존 모델보다 빠른 추론 속도를 보였다. Ablation 연구에서는 (a) 양방향 변환 없이 단일 방향 변환만 사용했을 때 성능 저하, (b) 인간·로봇 데이터 혼합 없이 각각만 사용했을 때 일반화 감소를 확인해 제안 방법의 필요성을 입증했다.

강점은 (1) 인간 동영상이라는 방대한 공개 데이터와 시뮬레이션 로봇 데이터를 효과적으로 결합, (2) 형태 차이를 기하학적 변환으로 해결해 실제 로봇 데이터 없이도 높은 일반화 달성, (3) 연속 액션을 직접 예측하는 diffusion‑transformer 설계로 디스크리트 토큰화의 한계를 극복한다. 한계점으로는 (① 변환 과정이 엄지·손목 중심에 의존해 손가락 세밀 동작을 완전히 재현하기 어려움, ② IK 솔버와 거리 추정 함수가 로봇 종류에 따라 튜닝 필요, ③ 대규모 인간 영상의 품질·노이즈가 모델에 미치는 영향에 대한 정량적 분석이 부족함을 들 수 있다. 향후 연구에서는 보다 정교한 해부학적 모델링, 다양한 로봇 형태에 대한 자동 변환 학습, 그리고 인간 행동의 의도·힘 제어까지 확장하는 방향이 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기