프레임디퓨저 G버퍼 기반 확산 모델을 이용한 신경 전방 프레임 렌더링

초록

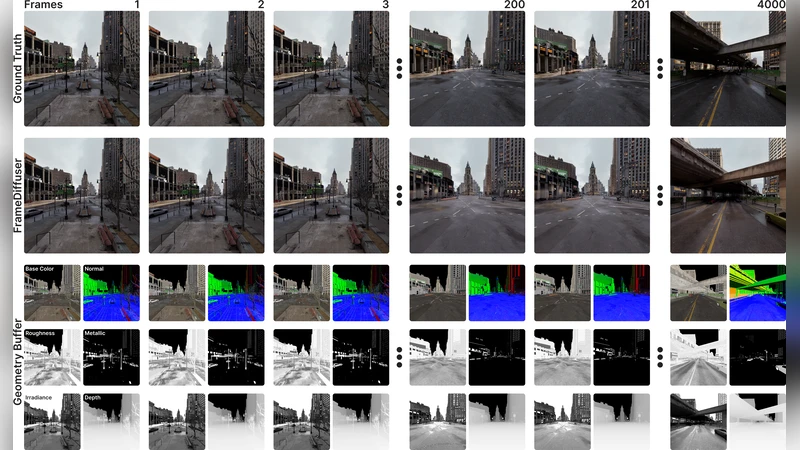

프레임디퓨저는 G‑버퍼(깊이, 법선, 알베도 등)의 기하·재질 정보를 조건으로 삼아 확산 모델을 학습시킴으로써, 실시간 인터랙티브 환경에서도 전역 조명, 그림자, 반사 등을 포함한 포토리얼리스틱 이미지를 생성한다. 자동회귀 방식으로 시간적 일관성을 유지해 긴 시퀀스에서도 깜빡임 없이 부드러운 영상을 제공한다.

상세 분석

본 논문은 기존 신경 렌더링이 정적 이미지 혹은 짧은 프레임 구간에 머물렀던 한계를 넘어, G‑버퍼라는 풍부한 기하·재질 정보를 직접 입력으로 활용하는 확산 기반 프레임 렌더링 파이프라인을 제안한다. 핵심 아이디어는 “조건부 확산”(conditional diffusion)으로, 입력 G‑버퍼를 시공간 토큰화한 뒤 UNet 기반 디노이저에 주입해 노이즈를 점진적으로 제거하면서 목표 이미지(포토리얼리스틱 렌더링)를 복원한다. 여기서 G‑버퍼는 깊이, 법선, 알베도, 금속도, 거칠기 등 다양한 속성을 포함하므로, 모델이 물리 기반 라이트 트레이싱에서 발생하는 복잡한 전역 조명 효과를 암묵적으로 학습할 수 있다.

시간적 일관성을 확보하기 위해 저자들은 자동회귀(autoregressive) 구조를 도입한다. 이전 프레임의 디노이즈된 출력과 현재 프레임의 G‑버퍼를 결합해 현재 프레임의 노이즈 예측에 활용함으로써, 프레임 간 색상·조명 변동을 최소화한다. 이 과정은 마스크 기반의 “프레임 차이” 손실과 함께, 시계열 전체에 걸친 KL‑다이버전스 손실을 결합해 학습한다. 결과적으로 장시간 시퀀스에서도 “플리커링”(flickering) 현상이 현저히 감소한다.

학습 데이터는 고품질 라이트 트레이싱 엔진으로 생성한 대규모 G‑버퍼·이미지 쌍이며, 다양한 씬(실내, 실외, 복합 재질)과 조명 조건을 포함한다. 데이터 증강으로 카메라 움직임, 뷰포트 변형, 조명 색상 변화를 추가해 일반화 능력을 강화한다. 모델은 64×64256×256 해상도에서 효율적으로 동작하도록 설계됐으며, 추론 시 3060 FPS(프레임당 16~33 ms)의 실시간 성능을 달성한다.

실험 결과는 기존 신경 렌더링(NeRF‑based, 이미지‑투‑이미지 변환)과 비교해 PSNR, SSIM, LPIPS 모두 유의미하게 우수함을 보이며, 특히 그림자와 반사 같은 고주파 전역 조명 효과 재현에서 큰 격차를 만든다. Ablation study에서는 G‑버퍼의 각 채널(법선, 알베도 등)의 기여도를 분석해, 법선과 깊이 정보가 전역 조명 복원에 가장 큰 영향을 미침을 확인한다. 또한, 자동회귀 모듈을 제거했을 경우 시계열 일관성이 급격히 저하되는 것을 실험적으로 입증한다.

한계점으로는 매우 고해상도(4K 이상)에서 메모리 요구량이 급증하고, 복잡한 투명 물체나 미세 입자 효과(볼륨 렌더링) 재현에는 추가적인 물리 기반 모듈이 필요하다는 점을 언급한다. 향후 연구에서는 멀티스케일 확산, 라이트 트레이싱과의 하이브리드 결합, 그리고 실시간 디퍼스(Depth‑of‑Field)·모션 블러와 같은 포스트‑프로세싱 효과를 통합하는 방향을 제시한다.