온라인 퍼스널 VLM을 위한 실시간 개념 학습 프레임워크

초록

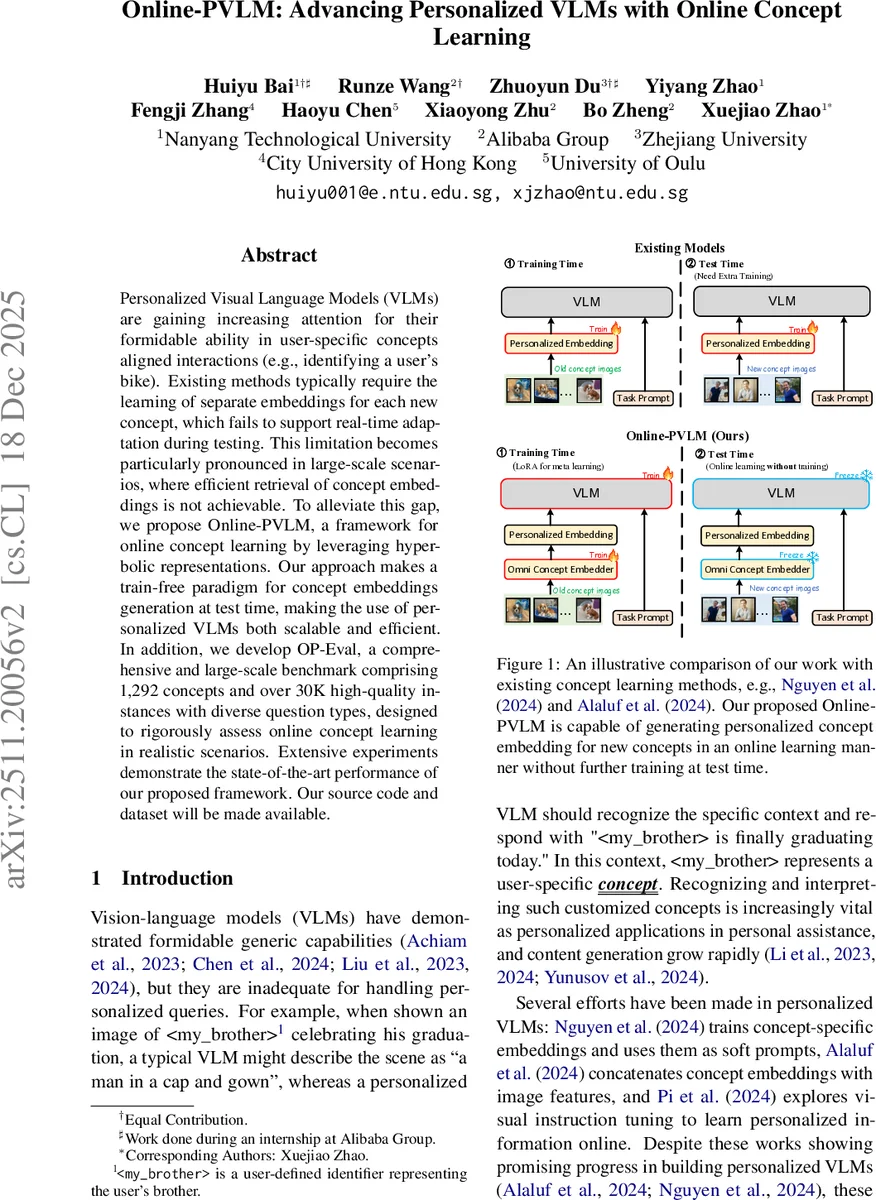

Online-PVLM은 하이퍼볼릭 임베딩과 LoRA 어댑터를 활용해 테스트 시 별도 학습 없이 사용자 정의 개념을 즉시 생성·활용한다. 경량 Omni Concept Embedder가 이미지 집합으로부터 개념 임베딩을 만들고, 하이퍼볼릭 판별기가 이미지‑개념 매칭을 강화한다. OP‑Eval이라는 1,292개 개념·30K 이상 질문·답변을 포함한 대규모 벤치마크를 제시하며, 기존 방법 대비 메모리·온라인 학습·확장성 측면에서 우수한 성능을 보인다.

상세 분석

본 논문은 퍼스널라이즈드 비주얼‑언어 모델(VLM)에서 새로운 개념을 실시간으로 학습할 수 없는 기존 한계를 극복하기 위해 세 가지 핵심 설계를 제안한다. 첫째, 경량 Omni Concept Embedder(O)는 사용자 제공 이미지 집합을 ViT 기반 멀티모달 인코더로 추출한 특징에 인스턴스 정규화와 평균 풀링을 적용한 뒤, MLP를 통해 고정 차원의 임베딩 zᵢ를 생성한다. 이 과정은 별도 파라미터 업데이트 없이 한 번의 순전파만으로 수행되므로 테스트 시 비용이 거의 없다. 둘째, 하이퍼볼릭 판별기(Dₕ)는 Poincaré 볼에 이미지와 개념 임베딩을 매핑해 초거리(hyperbolic distance)를 이용한 마진 기반 손실 ℓ(y)를 정의한다. 양성(동일 개념)과 음성(다른 개념) 쌍을 구분함으로써 의미 구조를 비유클리드 공간에 효과적으로 정렬한다. 셋째, LoRA 어댑터를 삽입한 VLM(M)은 기존 대규모 언어·비전 파라미터를 동결한 채, 텍스트 프롬프트와 결합된 개념 임베딩을 입력받아 자동회귀 손실 L_ans과 Dₕ 손실 L_disc을 가중치 λ로 결합해 공동 최적화한다. 학습 단계에서는 이 세 모듈을 순차적으로 훈련하지만, 추론 단계에서는 두 가지 무학습 모드가 제공된다. 파싱 모드에서는 새 개념에 대한 이미지 집합을 한 번만 통과시켜 임베딩을 생성하고 즉시 사용하며, 이후 메모리 뱅크에 저장해 재사용한다. 리트리벌 모드에서는 이미 캐시된 임베딩을 활용해 빠른 매칭과 질의응답을 수행한다. 이러한 설계는(1) 동적 메모리 유지·재활용, (2) 테스트 시 추가 파라미터 업데이트 없이 새로운 개념을 즉시 수용, (3) 이미지당 1~10장 정도의 소량 데이터만으로도 확장 가능한 개인화가 가능하도록 만든다. 실험에서는 OP‑Eval 벤치마크를 통해 QA, 식별, 캡션 등 다양한 태스크에서 기존 MyVLM, Yo’LLA‑VA, MC‑LLAVA 등과 비교해 평균 10% 이상 정확도 향상을 달성했으며, 특히 대규모 개념(>1k) 상황에서도 메모리·연산 비용이 선형적으로 증가하지 않음을 확인했다. 전체적으로 하이퍼볼릭 공간 활용과 LoRA 기반 경량 어댑터가 실시간 개인화 VLM 구현에 효과적임을 입증한다.

댓글 및 학술 토론

Loading comments...

의견 남기기