일관성 있는 대화형 얼굴 생성 프레임워크

초록

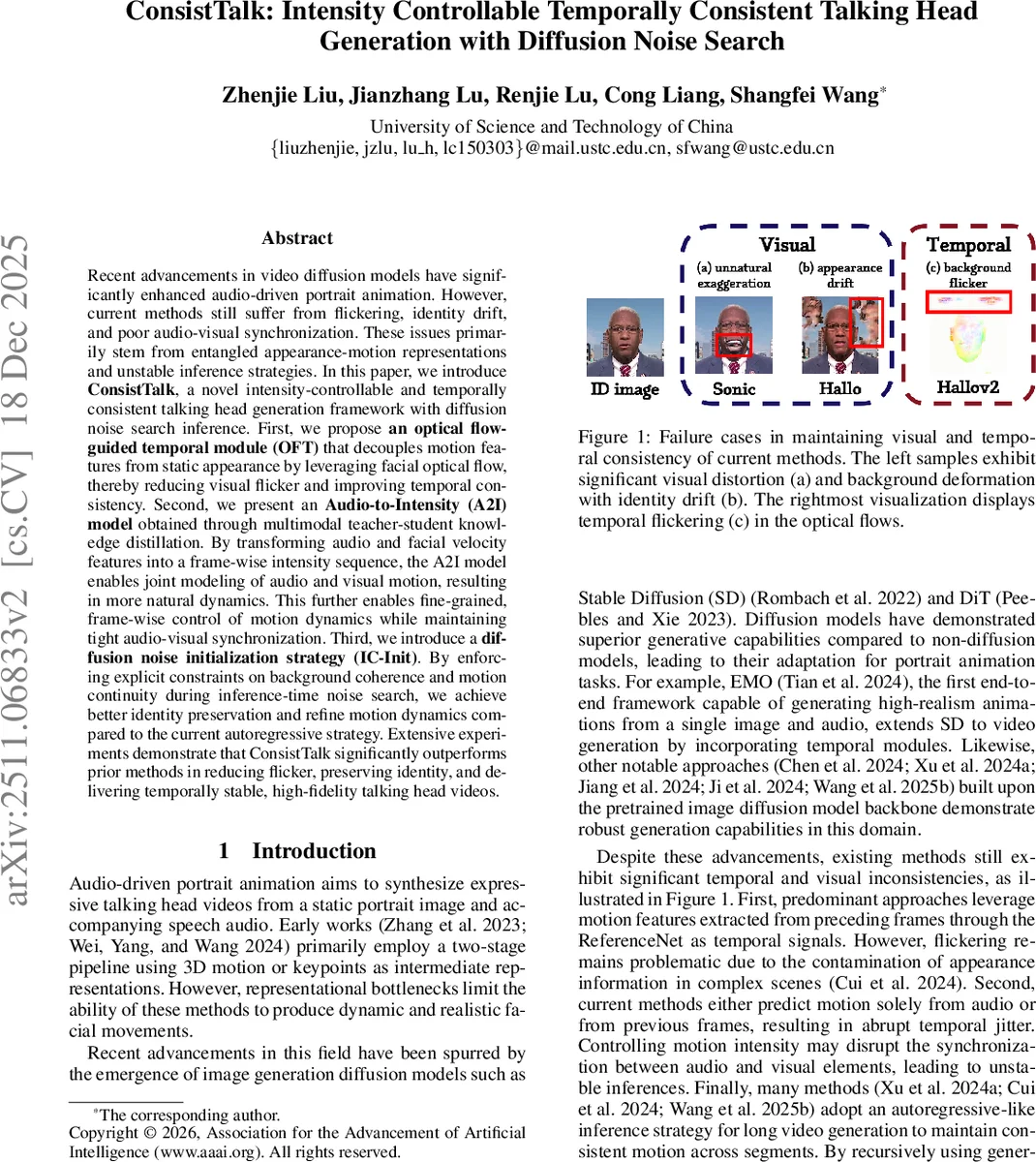

ConsistTalk은 광학 흐름 기반의 시간 모듈, 오디오‑투‑인텐시티(A2I) 모델, 그리고 강도 가이드 노이즈 초기화(IC‑Init) 세 가지 핵심 기술을 결합해, 정적 이미지와 음성 입력만으로 시각적 깜빡임과 정체성 손실을 최소화하고, 프레임 단위의 움직임 강도를 정밀하게 제어할 수 있는 고품질 토킹 헤드 영상을 생성한다.

상세 분석

본 논문은 최신 비디오 디퓨전 모델이 안고 있는 ‘시각적 플리커’, ‘정체성 드리프트’, ‘오디오‑비주얼 비동기화’ 문제를 세 가지 혁신적인 설계로 해결한다. 첫 번째로 제안된 Optical Flow‑Guided Temporal Module(OFT)은 얼굴 광학 흐름을 이용해 움직임 정보를 정적 외관 특징으로부터 명확히 분리한다. 기존 ReferenceNet 기반 접근법은 이전 프레임의 전체 시각 정보를 모션 신호로 사용하면서 외관 오염을 초래했지만, OFT는 광학 흐름을 3D 컨볼루션으로 저해상도 라텐트 공간에 매핑하고 Full‑Attention + RoPE를 적용해 시공간 정보를 효율적으로 융합한다. 이 과정에서 정적 텍스처는 CLIP‑기반 ReferenceNet을 통해 한 번만 인코딩되고, 움직임은 순수히 흐름 벡터에 의해 제어되므로 배경 변형이나 눈 깜박임 등에서 발생하는 플리커가 크게 감소한다.

두 번째 핵심인 Audio‑to‑Intensity(A2I) 모델은 멀티모달 교사‑학생 지식 증류를 활용한다. 교사 모델은 오디오와 얼굴 속도(헤드 모션, 랜드마크 변동) 사이의 복합 관계를 멀티헤드 교차‑어텐션과 GLU‑변형으로 학습하고, Swish 활성화 후 강도 시퀀스를 출력한다. 학생 모델은 오디오만을 입력으로 받아 동일한 강도 시퀀스를 예측하도록 MSE와 형태·시간 손실을 결합해 훈련한다. 이렇게 얻어진 강도 값은 디퓨전 UNet의 오디오‑조건 레이어에 스케일 팩터로 곱해져, 프레임 별 움직임 강도를 직접 조절할 수 있게 한다. 결과적으로 ‘음성에 비례한 자연스러운 움직임’과 ‘사용자 정의 강도 제어’를 동시에 달성한다.

세 번째 기여인 IC‑Init은 기존 자동회귀식 추론이 누적 오류로 인한 정체성 변형을 야기하는 문제를 해결한다. 고주파는 미세 움직임, 저주파는 전체 구조와 정체성을 담당한다는 관찰 아래, 노이즈 탐색 단계에서 강도 시퀀스에 기반한 보상 함수를 정의한다. 구체적으로, 후보 라텐트를 생성하고 look‑ahead 디노이징을 수행한 뒤, 강도에 따라 가중된 보상을 계산해 빔 서치를 진행한다. 이 과정은 ‘배경 일관성’과 ‘모션 연속성’ 두 가지 제약을 동시에 만족시키며, 최종 라텐트 시퀀스가 초기 정체성 이미지와 시간적 흐름을 모두 보존하도록 만든다.

실험 결과는 FVD, E‑FID, Flicker, ID‑Dist 등 다양한 정량 지표에서 기존 최첨단 방법들을 앞선다. 특히 플리커 감소율이 40% 이상이며, 정체성 보존 점수가 99.68%에 달한다. Ablation Study에서도 OFT, A2I, IC‑Init 각각이 독립적으로 성능 향상에 기여함을 확인한다. 종합적으로, ConsistTalk은 디퓨전 기반 토킹 헤드 생성에 있어 시각적 일관성, 정체성 유지, 그리고 강도 제어라는 세 축을 모두 만족시키는 최초의 프레임워크라 할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기