단일 카메라 기반 3D 지도 자가위치 추정을 위한 전역·국부 특징 융합 방법

초록

**

본 논문은 저비용 단일 카메라와 3D 포인트클라우드 지도만을 이용해 차량의 정확한 자가위치를 추정한다. 기존 CNN 기반 방법이 동적 장애물에 취약한 문제를 해결하고자, 전역 관계를 포착하는 Vision Transformer(ViT)와 국부 관계를 학습하는 CNN을 병렬로 활용해 특징을 융합한다. 실험 결과, KITTI·nuScenes 등 공개 데이터와 시뮬레이션·실제 로봇 환경에서 기존 최고 성능(LHMap‑loc) 대비 평균 위치 오차를 20 % 이상 감소시켰으며, 동적 장애물이 많은 상황에서도 오차 증가율을 절반 수준으로 억제하였다.

**

상세 분석

**

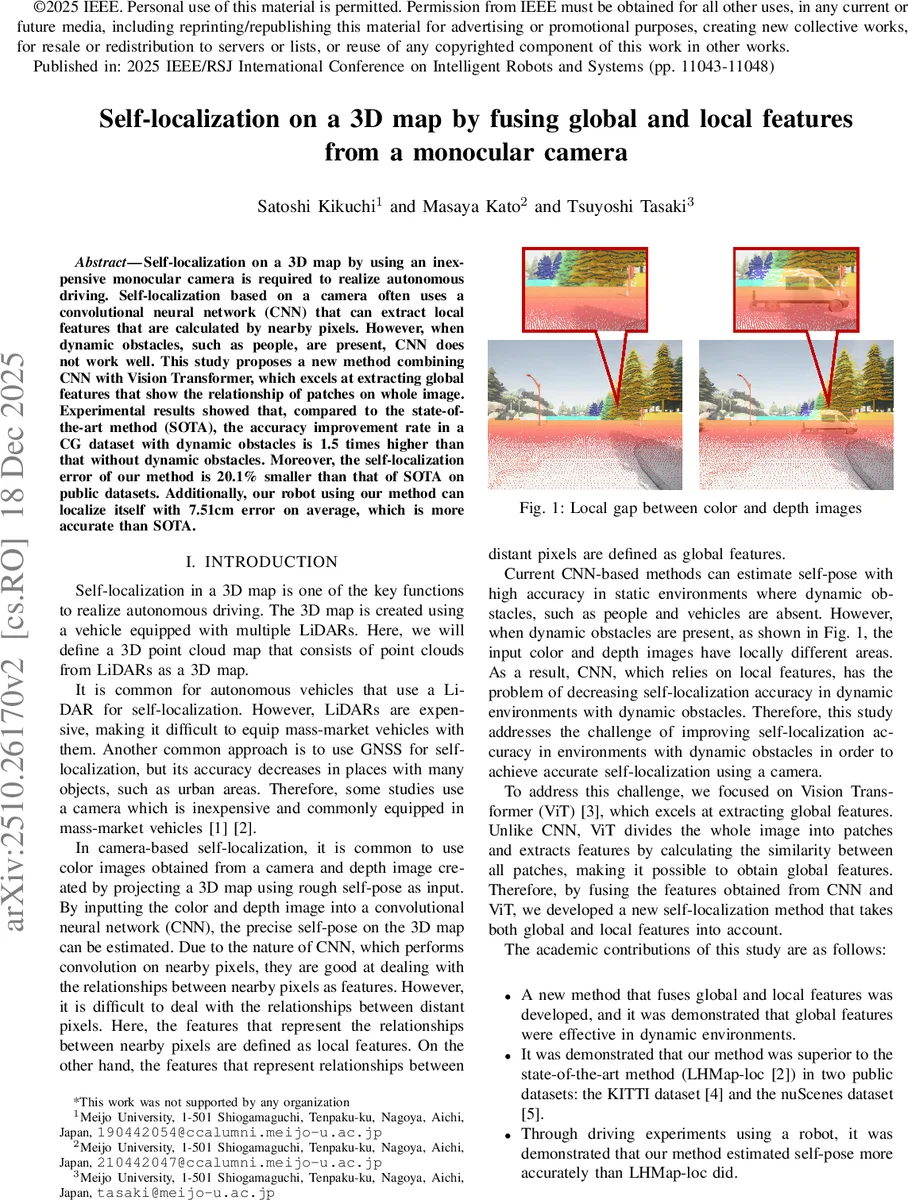

이 연구는 자가위치 추정 문제를 “컬러 이미지 + 깊이 이미지” 쌍을 입력으로 하는 엔드‑투‑엔드 회귀 문제로 정의한다. 기존 CNN 기반 모델은 근접 픽셀 간의 상관관계(국부 특징)만을 효과적으로 학습하지만, 동적 객체가 존재하면 컬러와 깊이 이미지 사이에 국부적인 불일치가 발생해 성능이 급격히 저하된다. 이를 보완하기 위해 저자는 Vision Transformer(ViT)를 도입한다. ViT는 이미지를 일정 크기의 패치로 분할하고, 모든 패치 간의 self‑attention을 계산해 전역적인 관계(전역 특징)를 추출한다. 전역 특징은 동적 장애물에 의해 발생하는局部 왜곡을 평균화시키는 효과가 있다.

구조적으로는 세 개의 블록으로 구성된다. ① 전역 특징 추출 블록에서는 사전 학습된 ViT(ImageNet) 모델을 색상·깊이 이미지 각각에 대해 별도의 컨볼루션 레이어(Conv′RGB, Conv′Depth)로 전처리한 뒤, 두 특성 맵을 채널 차원에서 결합해 ViT에 입력한다. ViT의 클래스 토큰을 전역 특징 F_Global(1 × 768)로 사용한다. ② 국부 특징 추출 블록은 기존 LHMap‑loc에서 사용한 CNN 기반 모듈을 그대로 차용한다. 색상·깊이 이미지에서 각각 특징 맵을 추출하고, 상관계산 모듈(Corr)과 두 단계의 피처 추출기(FE1, FE2)를 통해 국부 특징 F_Local(1 × 512)를 얻는다. ③ 자세 회귀 블록에서는 F_Global와 F_Local를 단순 연결(concat)해 1 × 1280 차원의 융합 특징을 만든 뒤, 두 개의 MLP(위치, 자세)로 최종 3‑D 위치 t와 쿼터니언 q를 예측한다.

학습 단계는 크게 두 단계로 나뉜다. 첫 번째 단계에서는 사전 학습된 ViT를 고정하고, CNN과 회귀 MLP를 end‑to‑end 방식으로 학습한다. 두 번째 단계에서는 전체 네트워크를 미세조정해 전역·국부 특징이 상호 보완되도록 최적화한다. 데이터 증강으로는 거친 초기 자세에 ±60 cm의 랜덤 오프셋을 추가해 실제 운행 시 발생할 수 있는 초기 오차를 시뮬레이션한다.

실험은 세 가지 시나리오에서 수행되었다. (1) CARLA 시뮬레이터에서 정적·동적 환경을 각각 7개 타운에서 7 000장 이미지로 평가했으며, 동적 환경에서 기존 방법 대비 오차 증가율을 4.2 %→2.6 %로 감소시켰다. (2) KITTI와 nuScenes 공개 데이터셋에서는 평균 위치 오차가 각각 9.36 cm(전:9.58 cm)와 7.04 cm(전:8.81 cm)로, 특히 nuScenes에서 20 % 이상의 개선을 보였다. (3) 실제 로봇 실험(Meijo 대학 캠퍼스)에서는 평균 7.51 cm(전:8.18 cm)의 오차를 기록, 실시간 주행에서도 기존 방법보다 일관된 정확도를 유지했다.

이러한 결과는 전역 특징이 동적 장애물에 의해 발생하는 국부적인 왜곡을 완화하고, 국부 특징이 제공하는 세밀한 픽셀‑레벨 정합성을 보존함으로써 두 특징의 시너지 효과를 입증한다. 또한, 사전 학습된 ViT를 최소한의 파인‑튜닝만으로 활용함으로써 대규모 데이터 없이도 전역 정보를 효과적으로 학습할 수 있음을 보여준다. 향후 연구에서는 멀티‑스케일 패치 설계, 실시간 연산 최적화, 그리고 라이다‑이미지 융합과 같은 다중 센서 통합으로 확장 가능성이 기대된다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기