스페이셜비드 대규모 영상 데이터셋

초록

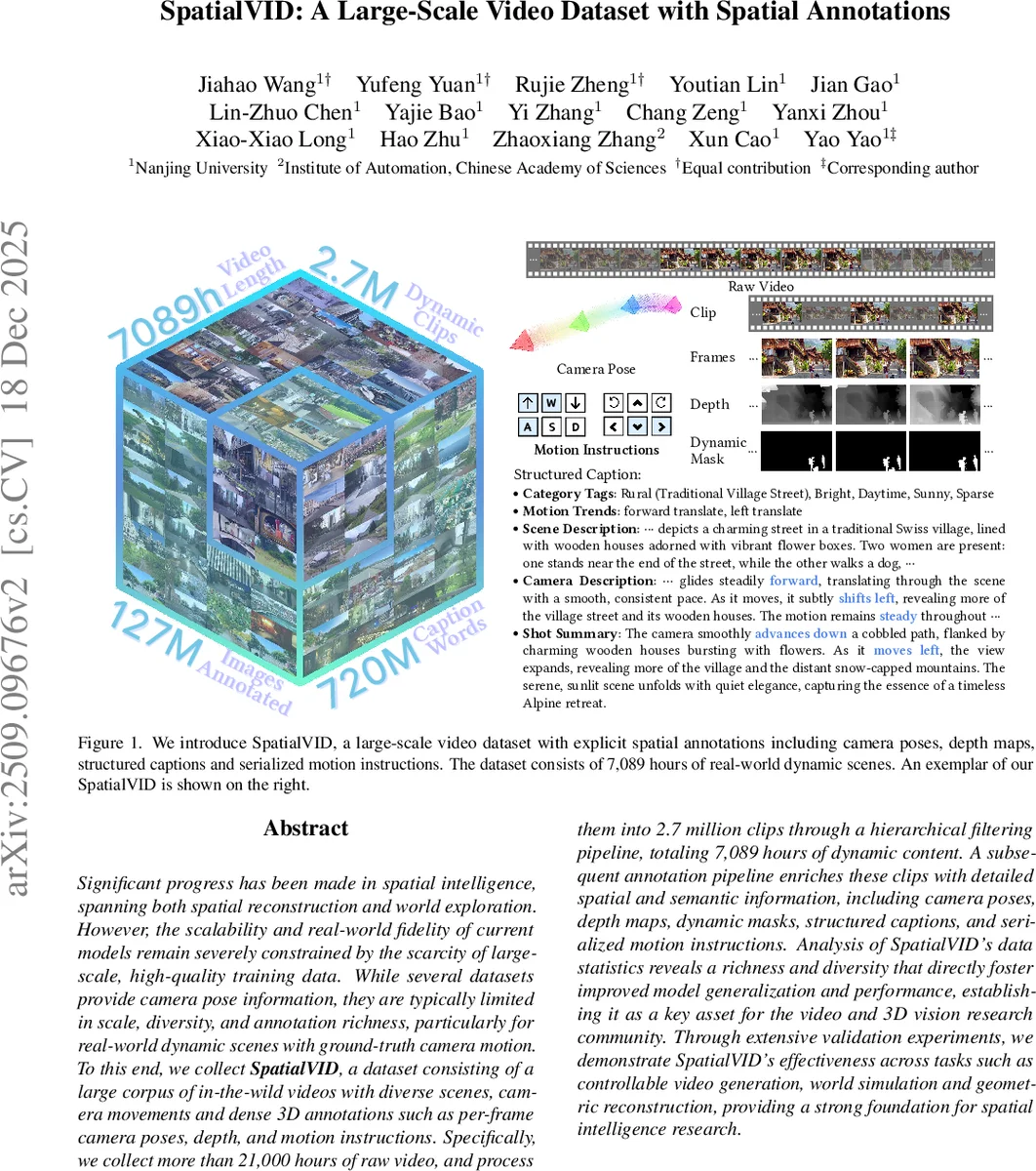

스페이셜비드(SpatialVID)는 21,000시간 이상의 인터넷 영상을 기반으로 7,089시간(2.7 백만 클립)의 고품질 동적 영상을 선별·필터링하고, 프레임별 카메라 포즈, 깊이 지도, 동적 마스크, 구조화된 캡션 및 움직임 명령어 등 풍부한 3D 공간 메타데이터를 부착한 대규모 공개 데이터셋이다. 기존 영상·3D 데이터셋의 규모·다양성·주석 부족 문제를 해소하고, 제어 가능한 비디오 생성·세계 시뮬레이션·기하학적 재구성 등 여러 작업에서 성능 향상을 입증한다.

상세 분석

본 논문은 공간 인텔리전스 연구에 필수적인 “영상 ↔ 3D” 연결 고리를 대규모 실세계 데이터로 메우려는 시도로, 데이터 수집·전처리·주석 부착 전 과정을 체계화한 파이프라인을 제시한다. 먼저, 유튜브에서 “walk”, “tour”, “drone” 등 움직임을 암시하는 키워드로 33,443개의 영상을 수집하고, 수동 검수를 통해 카메라 움직임이 뚜렷하고 텍스트·오버레이가 적은 클립만을 남긴다. 이후 PySceneDetect 기반으로 3~15초 구간으로 세분화하고, H.265 720p로 통일해 7 백만 개 이상의 후보 클립을 만든다.

품질 필터링 단계에서는 네 가지 메트릭을 활용한다. CLIP + MLP 기반 미학 점수로 시각적 품질을 평가하고, VMAF 기반 모션 강도 측정으로 충분한 카메라 이동을 보장한다. PaddleOCR을 이용해 텍스트 영역 비율을 검출해 자막·로고 등 방해 요소를 제거하고, 조도 필터링으로 과·과소 노출을 배제한다. 이 과정을 거쳐 2.7 백만 클립(7,089 시간)만을 최종 데이터셋에 포함한다.

주석 생성은 두 축으로 나뉜다. 기하학적 정보는 MegaSaM을 개량해 프레임별 카메라 포즈와 깊이 맵을 자동 추출한다. 이때 기존 SfM·SLAM 대비 동적 씬에서도 안정적인 추정이 가능하도록 optical‑flow와 multi‑view matching을 결합한다. 의미적 주석은 대형 비전‑언어 모델(VLM)로부터 초기 장면·카메라 설명을 얻고, 대형 언어 모델(LLM)이 이를 카메라 포즈와 연계해 구조화된 캡션(장면 유형, 조명, 날씨, 인구 밀도 등)과 움직임 지시어(W‑A‑S‑D)로 정제한다.

또한, 데이터 편향을 최소화하기 위해 “SpatialVID‑HQ”라는 1,111 시간 규모의 균형 서브셋을 샘플링한다. 여기서는 카메라 궤적 다양성, 카테고리 분포, 동적 마스크 비율 등을 고려해 고품질 학습·평가용 데이터를 제공한다.

실험에서는 제어 가능한 비디오 생성(Stable Video Diffusion, Sora 등), 세계 시뮬레이션(Genie3, Cosmos) 및 기하학적 재구성(NeRF, DUSt3R) 작업에 SpatialVID를 사전학습 데이터로 활용했을 때, 기존 데이터셋 대비 PSNR, SSIM, FVD 등 정량 지표와 인간 평가에서 모두 유의미한 개선을 보였다. 이는 풍부한 3D 메타데이터와 구조화된 텍스트가 모델이 공간적 일관성을 학습하도록 돕는 효과를 입증한다.

결론적으로, 스페이셜비드는 “대규모·다양성·정밀 주석”이라는 세 축을 모두 만족하는 최초의 실세계 동적 영상 데이터셋으로, 향후 3D 인식·생성·시뮬레이션 연구에 표준 베이스라인이 될 가능성을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기