시각장애인용 실시간 내비게이션 안내 생성 모델 LaF‑GRPO

초록

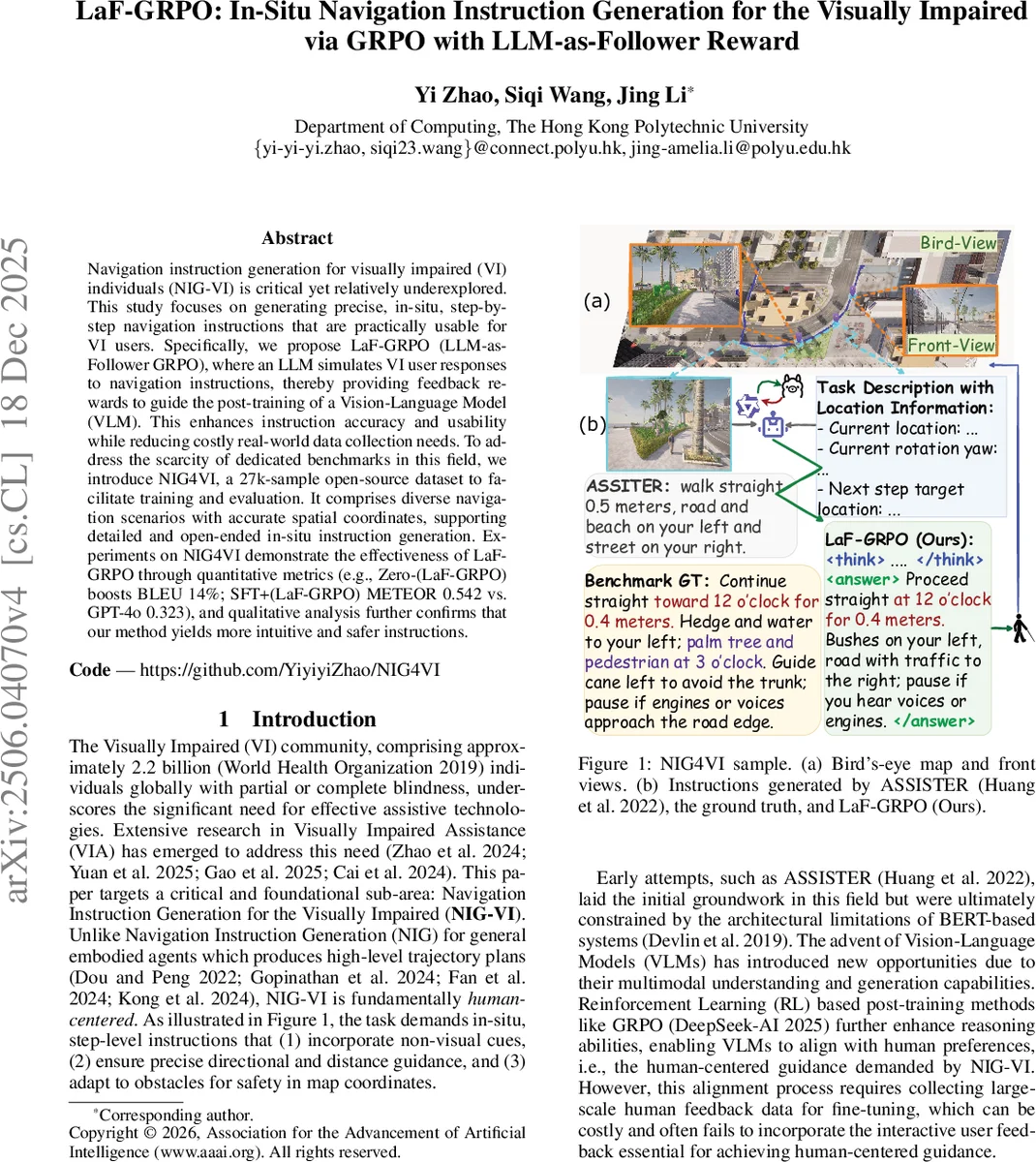

본 논문은 시각장애인에게 현장 상황에 맞는 단계별 안내문을 자동으로 생성하는 LaF‑GRPO 프레임워크를 제안한다. 대형 언어 모델(LLM)을 사용해 사용자의 반응을 시뮬레이션하고, 이를 보상으로 활용해 비전‑언어 모델(VLM)을 강화학습(GRPO)으로 미세조정한다. 또한 27 000개의 멀티모달 데이터와 정확한 좌표 정보를 포함한 NIG4VI 벤치마크를 공개한다. 실험 결과, 제안 방법은 제로샷 및 SFT 기반 모델 대비 BLEU·METEOR 등에서 크게 향상되었으며, 안전하고 직관적인 안내문을 제공한다.

상세 분석

LaF‑GRPO는 기존 NIG‑VI 연구가 갖는 두 가지 한계를 동시에 해결한다. 첫째, 실제 시각장애인과의 대면 실험 없이도 “사용자‑팔로워” 역할을 하는 LLM을 통해 피드백을 생성한다는 점이다. 이 LLM은 사전 학습된 LLaMA‑3‑8B‑Instruct를 SFT로 미세조정해, 입력된 안내문을 ‘move’(방향·거리)와 ‘detailed_hazard_alert’(위험 경고)라는 구조화된 행동 해석으로 변환한다. 파싱 정확도가 98 % 이상임을 검증했으며, 이는 보상 함수에 직접 활용될 수 있는 신뢰성 높은 시뮬레이터 역할을 한다.

둘째, VLM의 강화학습 단계에서 기존 GRPO에 LLM‑as‑Follower 보상(r_LaF)을 추가한다. r_LaF는 방향 정확도(dir), 거리 정확도(dist), 위험 경고(alert)의 가중합으로 정의되며, 각각 0·1의 이진 매칭을 사용한다. 이와 별도로 형식 보상(r_format)과 텍스트 생성 보상(r_meteor)을 병행함으로써, 모델이 지정된 XML‑like 포맷을 유지하면서도 의미적으로 풍부하고 안전한 문장을 생성하도록 유도한다.

학습 파이프라인은 두 단계로 구성된다. ① SFT 단계에서 대규모 VLM(Qwen2.5‑VL)에게 인간 주석이 포함된 NIG4VI 데이터를 이용해 기본 안내문 생성 능력을 학습한다. ② GRPO 단계에서 과거 정책(π_θ_old)으로부터 G개의 후보 출력을 샘플링하고, 각 후보에 대해 r_format, r_meteor, r_LaF를 계산한다. PPO‑style surrogate loss L_i와 KL‑regularization을 결합한 목표함수 J_GRPO(θ)를 최적화한다.

NIG4VI 데이터셋은 CARLA 시뮬레이터 기반으로, 다양한 도시·교외 환경, 날씨, 조명 조건을 포함한다. 각 샘플은 (현재 위치·방위, 목표 위치·방위, 전방 이미지, 의미 분할 이미지)와 함께 인간 검증을 거친 고품질 안내문을 제공한다. 데이터 생성 파이프라인은 GPT‑4o, Claude‑3.5, Gemini‑2 등 최신 LLM을 활용하고, DeepSeek‑R1을 통해 시각장애인 친화적 표현으로 변환한 뒤, 두 명의 독립 annotator가 교차 검증한다.

실험 결과는 세 가지 평가 축을 제시한다. (1) 제로‑샷 대비 LaF‑GRPO 적용 시 BLEU가 평균 14 % 상승, (2) SFT+LaF‑GRPO 모델이 METEOR 0.542를 기록해 GPT‑4o(0.323)를 크게 앞섰으며, (3) 정성적 평가에서 안전 경고, 비시각적 랜드마크, 거리·방향의 정밀도가 현저히 개선되었다. 특히 “버스 오른쪽, 모터사이클 앞에 안개”와 같은 복합 상황에서도 정확히 위험을 인식하고, “엔진 소리 들릴 때 멈추라”는 안전 지시를 포함한다.

이 논문은 (i) LLM을 팔로워 시뮬레이터로 활용한 보상 설계, (ii) VLM‑GRPO와의 효율적 결합, (iii) 실용적인 대규모 VI‑전용 데이터셋 공개라는 세 축에서 NIG‑VI 분야에 새로운 패러다임을 제시한다. 향후 실제 시각장애인 대상 현장 테스트와 GPS 기반 실시간 서비스 연계가 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기