개인화 수요 인식 비디오 검색을 위한 쿼리 재작성 시점과 방법

초록

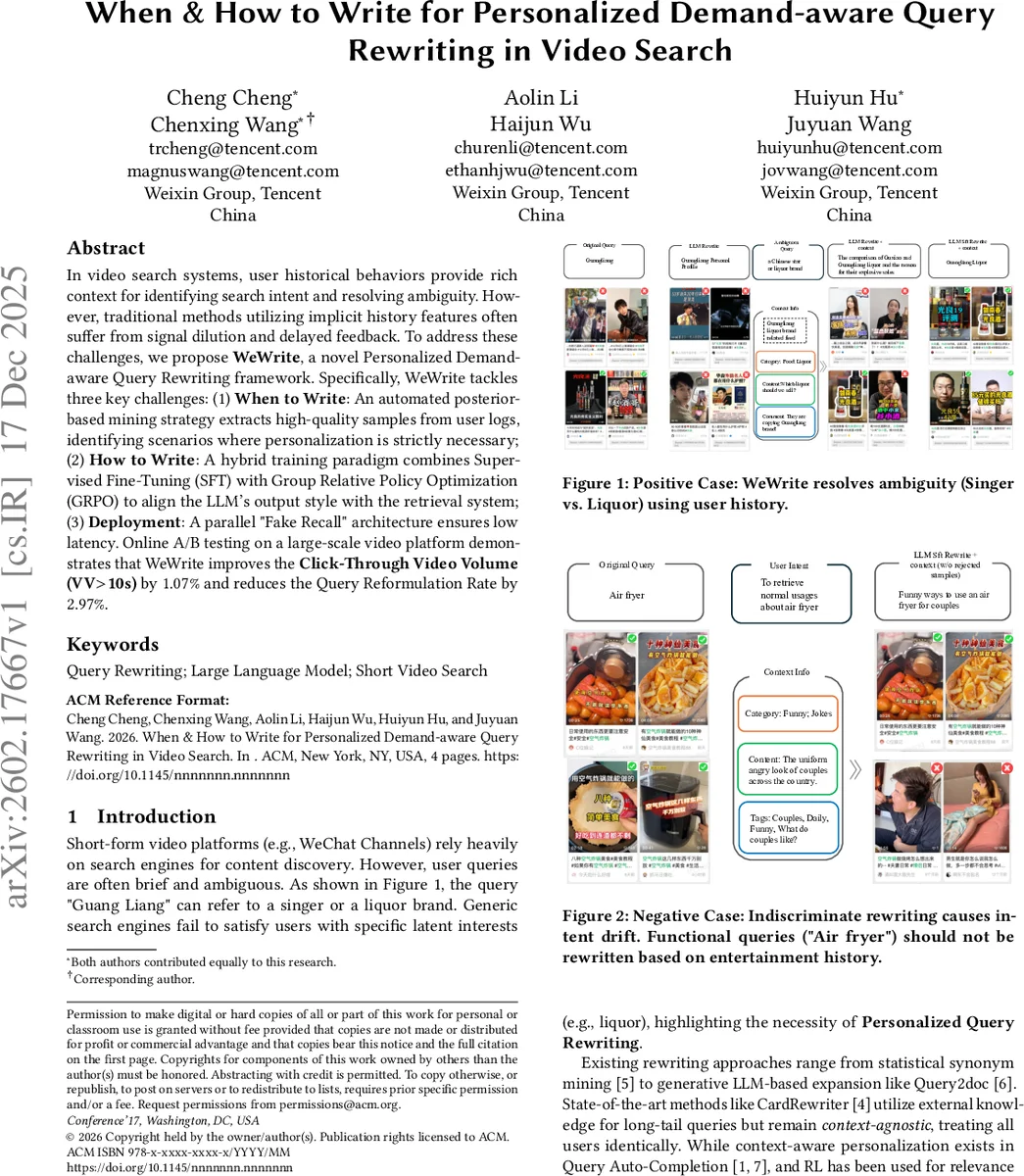

WeWrite는 사용자 행동 로그의 후방 피드백을 활용해 “언제” 개인화된 쿼리 재작성을 해야 하는지를 자동으로 판단하고, SFT와 GRPO 기반 강화학습을 결합해 “어떻게” 검색 인덱스에 적합한 재작성문을 생성한다. 가짜 리콜(Fake Recall) 병렬 구조를 도입해 실시간 서비스 지연을 최소화했으며, 대규모 온라인 A/B 테스트에서 클릭‑through 비디오 볼륨을 1.07% 상승, 쿼리 재작성 비율을 2.97% 감소시켰다.

상세 분석

WeWrite는 비디오 검색 환경에서 사용자 히스토리(검색어, 시청 영상, 지리 정보)를 정형화된 컨텍스트 𝐶𝑢 로 정의하고, 이를 기반으로 두 가지 핵심 문제를 해결한다. 첫 번째는 “When to Write”이다. 기존 방법은 모든 쿼리에 무조건 재작성 전략을 적용해 의도 드리프트와 불필요한 연산을 초래한다. WeWrite는 후방 피드백(쿼리 재작성 후 체류 시간, 클릭 여부)을 이용해 고품질 양성 샘플과 부정 샘플을 자동 채굴한다. 양성 샘플은 원본 쿼리(Q_ori)와 재작성된 쿼리(Q_next) 사이에 사용자가 즉시 재작성하고, Q_next에 대한 체류 시간이 일정 임계값(>10 s)을 초과하는 경우를 선택한다. 여기서 두 단계 필터링이 적용된다. ① Coarse‑grained Context Overlap: Q_next에 새로 등장한 토큰 ΔT 중 최소 하나가 사용자의 시청 영상 제목·태그 등 컨텍스트에 존재해야 한다. ② Fine‑grained LLM‑based Intent Verification: 대형 교사 모델(Qwen3‑32B)을 프롬프트화해 “새로운 용어가 실제 컨텍스트에 나타나는가”를 이진 분류한다. 부정 샘플은 Q_ori 자체가 만족스러운 결과를 제공하고, 재작성 없이 긴 체류(>τ_long)만 발생한 경우를 수집해

두 번째는 “How to Write”이다. WeWrite는 두 단계 학습 파이프라인을 구축한다. (1) Supervised Fine‑Tuning(SFT) 단계에서는 위에서 만든 양·부정 데이터셋을 이용해 LLM을 조건부 생성 모델로 미세조정한다. 입력은 “컨텍스트 + 원본 쿼리” 형태의 시스템 프롬프트이며, 출력은 재작성된 쿼리 또는

실시간 서비스 적용을 위해 WeWrite는 “Fake Recall”이라는 병렬 인프라를 설계한다. 사전에 구축된 가짜 인덱스 I_fake은 인기 쿼리와 장기 로그 기반 상위 K(=50) 문서를 KV 형태로 저장한다. 온라인 요청 시 전통적인 텍스트·벡터 리콜 파이프라인과 LLM 재작성 파이프라인을 동시에 실행한다. LLM이 생성한 Q_rew가 I_fake에 매치되면 즉시 해당 문서 리스트를 반환하고, 경량 리레버런스 모델로 안전성 검증 후 메인 후보와 합병한다. LLM 추론은 비동기적으로 진행되므로 전체 응답 지연은 기존 시스템과 동일하게 유지된다.

대규모 온라인 A/B 테스트 결과, 최적 모델(Qwen3‑4B + SFT + GRPO) 적용 시 VV>10 s(클릭‑through 비디오 볼륨)가 1.07% 상승하고, Query Reformulation Rate가 2.97% 감소했다. 이는 개인화된 재작성 시점 판단과 인덱스 친화적 생성이 실제 사용자 만족도와 검색 효율성을 동시에 끌어올렸음을 증명한다.

WeWrite의 주요 기여는 (1) 후방 피드백 기반 자동 샘플링으로 “언제” 재작성할지를 데이터‑드리븐하게 결정, (2) SFT와 GRPO를 결합한 하이브리드 학습으로 “어떻게” 검색 친화적 쿼리를 생성, (3) 가짜 리콜 병렬 구조를 통한 실시간 서비스 적용 가능성 제시이다. 이 접근법은 짧은 영상 플랫폼뿐 아니라 다양한 멀티모달 검색 서비스에 확장 가능하며, LLM 기반 개인화가 지연 제한이 있는 프로덕션 환경에서도 실용적임을 보여준다.

댓글 및 학술 토론

Loading comments...

의견 남기기