Mamba 기억의 선택적 소멸: 오토인코더로 본 토큰·문맥 특성 분석

초록

본 논문은 고정 메모리 구조를 갖는 SSM 기반 언어모델 Mamba가 긴 시퀀스 처리 시 어떤 종류의 토큰과 문맥을 더 쉽게 잊는지를 오토인코더 재구성 실험을 통해 규명한다. 결과는 수학 기호·숫자, 조직명(NER), 비표준 영어 방언 등 희귀 토큰이 재구성 오류가 크게 나타나며, 이는 사전학습 데이터에서 해당 토큰의 등장 빈도가 낮은 것과 상관관계가 있음을 보여준다.

상세 분석

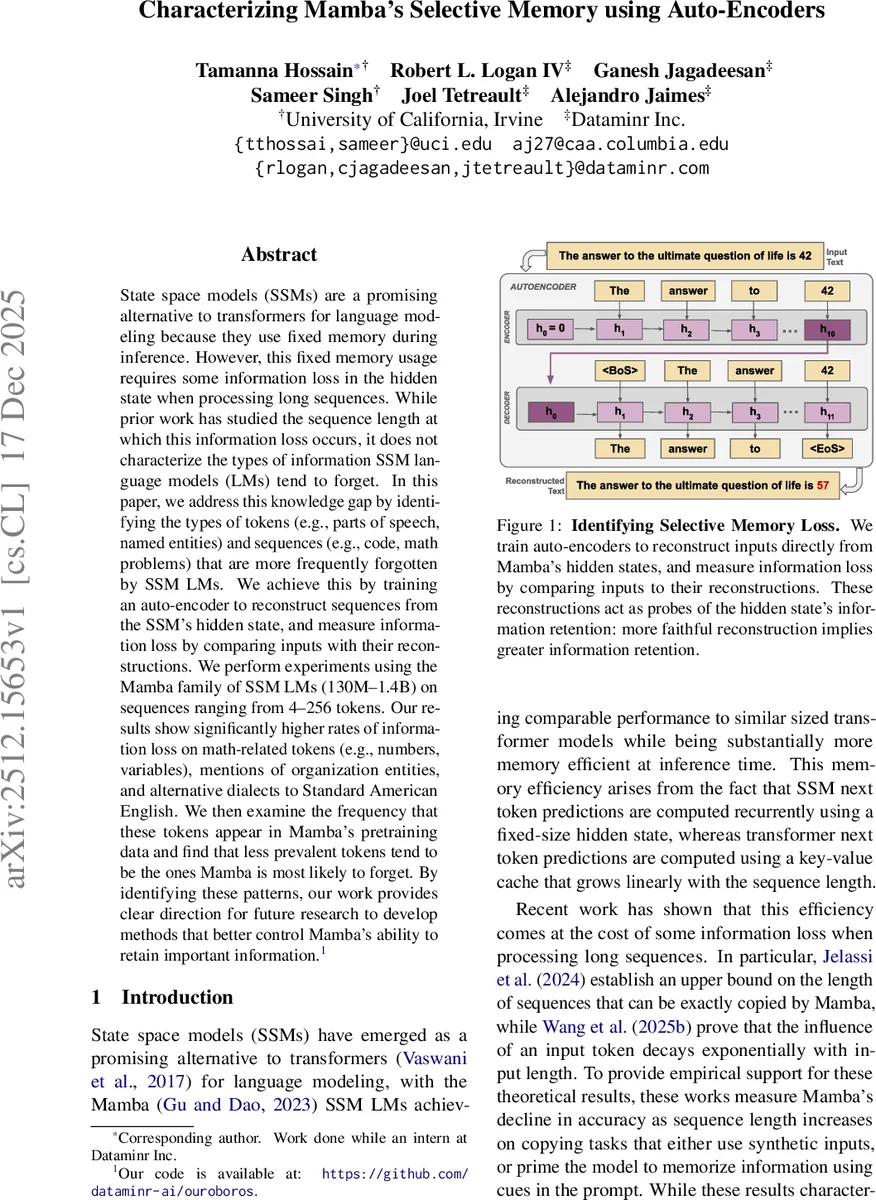

본 연구는 Mamba와 같은 상태공간 모델(SSM)의 고정‑크기 은닉 상태가 장기 의존성을 유지하는 데 한계가 있음을 기존 이론(Jelassi 2024, Wang 2025b)과 실험으로 확인한 뒤, “무엇을” 잊는지에 초점을 맞췄다. 핵심 방법은 사전학습된 Mamba 인코더를 동결하고, 해당 은닉 상태를 입력으로 하는 오토인코더 디코더를 학습시켜 입력 텍스트를 재구성하는 것이다. 재구성 품질은 토큰 누락률(Omission Rate)과 ROUGE‑F1 두 지표로 측정한다.

실험은 130 M에서 1.4 B 파라미터 규모의 Mamba 모델들을 4~256 토큰 길이의 시퀀스에 대해 수행했으며, 모델 크기와 시퀀스 길이에 따라 재구성 성능이 크게 달라짐을 확인했다. 특히 16 토큰 이상부터 ROUGE‑F1이 급격히 감소하고, 128·256 토큰에서는 85 %·66 % 수준으로 떨어졌다. 이는 은닉 상태가 정보를 압축하면서 장거리 정보를 손실한다는 기존 이론을 실증한다.

토큰‑레벨 분석에서는 수학 관련 토큰(숫자, 변수), 조직명(NER), 그리고 African American Vernacular English(AAE)와 같은 비표준 방언이 높은 누락률을 보였다. 시퀀스‑레벨에서는 수학 문제, 코드 스니펫 등 구조적으로 복잡한 텍스트에서도 오류가 집중되었다. 이러한 현상은 Pile 데이터셋에서 해당 토큰·문맥의 등장 빈도가 낮은 것과 강한 상관관계를 보였으며, 희귀성(rare‑ness)이 기억 손실의 주요 요인임을 시사한다.

또한, 모델 크기가 커질수록 장거리 시퀀스에서의 복원 성능이 개선되지만, 790 M 모델이 1.4 B 모델을 능가하는 비단조적 현상도 관찰되었다. 이는 파라미터 수 외에도 학습 초기화, 하이퍼파라미터, 그리고 SSM 내부 시간‑의존 파라미터 설계가 복합적으로 작용함을 암시한다.

연구는 두 가지 중요한 시사점을 제공한다. 첫째, SSM 기반 LM은 희귀 토큰·특수 방언에 대한 기억이 취약하므로, 사전학습 데이터의 토큰 분포 균형을 재고하거나 희귀 토큰을 위한 별도 보강 전략이 필요하다. 둘째, 오토인코더 기반 재구성 프로브는 기존의 “프롬프트‑기반 기억 테스트”와 달리 자연스러운 입력 전반에 걸친 기억 특성을 정량화할 수 있는 유용한 도구임을 입증한다. 향후 연구는 토큰‑가중 손실 함수, 메모리‑보강 모듈, 혹은 하이브리드 트랜스포머‑SSM 구조를 통해 선택적 기억 손실을 완화하는 방법을 탐색할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기