GPU 기반 블룸 필터 최적화와 실시간 고정밀 처리

초록

본 논문은 GPU의 대규모 스레드 병렬성과 고대역폭 메모리를 활용해 블룸 필터의 조회·구축 속도를 극대화한다. 벡터화, 워프 협력, 연산 지연 최소화라는 세 축을 설계 공간으로 삼아, 필터가 L2 캐시 영역에 완전히 들어갈 때 최고의 성능을 달성함을 보인다. 최적화된 구현은 동일 오류율에서 기존 GPU 구현보다 조회는 15.4배, 구축은 11.35배 빠르며, B200 GPU에서 실질적인 속도 한계의 92%에 근접한다.

상세 분석

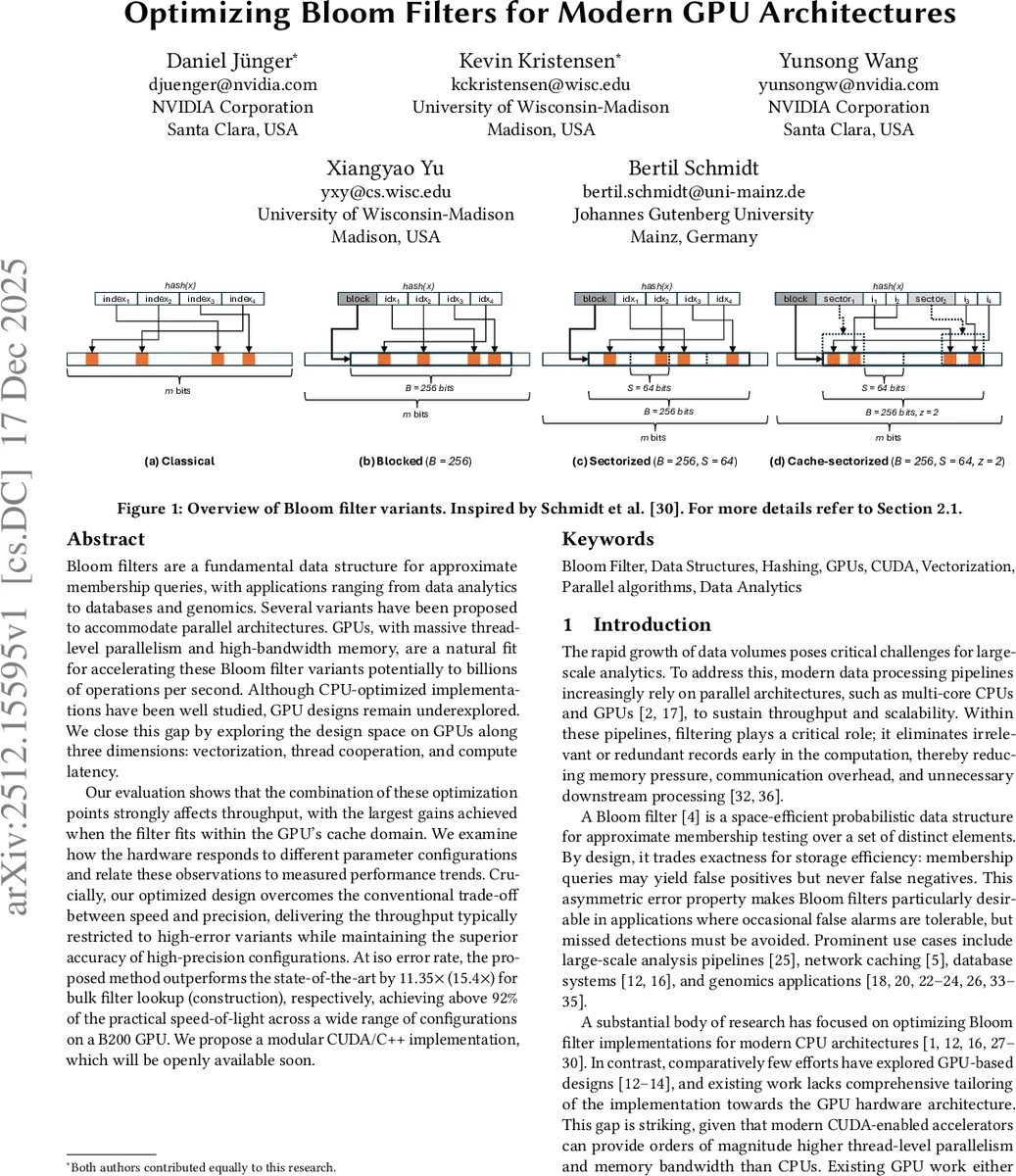

논문은 먼저 고전적 블룸 필터(CBF), 블록형 블룸 필터(BBF), 레지스터 블록 블룸 필터(RBBF), 섹터형 블룸 필터(SBF), 캐시‑섹터형 블룸 필터(CSBF) 등 기존 변형들을 정리하고, 각각이 메모리 접근 패턴과 정확도에 미치는 영향을 분석한다. GPU 메모리 서브시스템은 L1·L2 캐시와 HBM/DDR 메모리로 구성되며, 접근 단위는 32 B(또는 ECC 적용 시 64 B)인 섹터이다. 따라서 메모리 접근의 공동화(coalescing)와 원자적 업데이트가 성능에 결정적이다. 저자는 세 가지 최적화 축을 제시한다. 첫째, 수평·수직 벡터화를 통해 블록 내 연속된 워드들을 16 B 혹은 32 B 와이드 로드로 한 번에 가져와 메모리 대역폭을 최대 활용한다. 둘째, 워프 협력 실행 방식을 도입해 동일 워프 내 스레드가 같은 블록을 공유하도록 함으로써 중복 해시 연산을 제거하고, 워프 간 동기화 비용을 최소화한다. 셋째, 연산 지연을 줄이기 위해 분산 곱셈 해시를 사용해 분기 없는 해시 생성 파이프라인을 구축하고, 이를 ILP와 결합해 각 스레드가 독립적으로 연산을 진행하도록 설계했다. 실험에서는 필터 크기가 L2 캐시(≈8 MB) 안에 들어가는 경우와 DRAM에 상주하는 경우를 구분해 성능을 측정한다. 캐시 내에서는 메모리 요청이 거의 지연 없이 처리돼 이론적 속도 한계에 근접하고, DRAM 영역에서는 메모리 대역폭이 병목이 되지만, 최적화된 접근 패턴 덕분에 92 % 수준의 효율을 유지한다. 또한 다양한 GPU 아키텍처(B200, H200 SXM, RTX PRO 6000)에서 일관된 이득을 확인한다. 비교 대상인 WarpCore BBF 구현은 특정 설정에서만 경쟁력을 보였지만, 오류율이 크게 높아 실용성이 떨어진다. 최종적으로 저자는 모듈형 CUDA/C++ 라이브러리를 제공하고, 향후 오픈소스로 공개할 계획임을 밝힌다.

댓글 및 학술 토론

Loading comments...

의견 남기기