포즈와 표정을 완벽하게 분리하여 제어하는 차세대 인물 애니메이션 기술 DeX-Portrait

초록

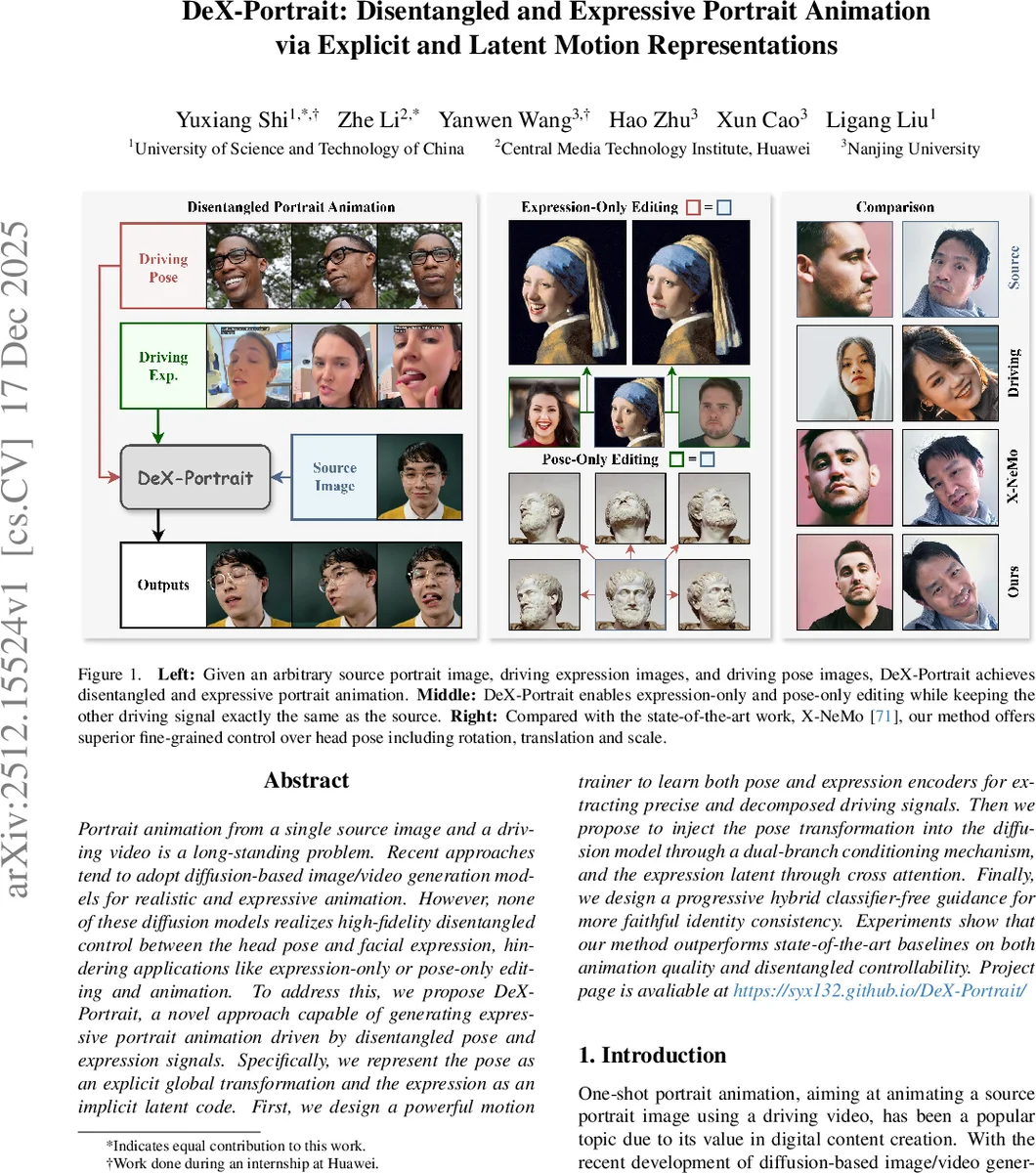

DeX-Portrait는 기존 확산 모델 기반 인물 애니메이션의 한계인 ‘포즈와 표정의 결합(Entanglement)’ 문제를 해결하기 위해, 움직임을 전역적 3D 변환(포즈)과 잠재적 코드(표정)로 명확히 분리하여 정밀한 제어와 높은 품질의 애니메이션을 구현한 기술입니다.

상세 분석

DeX-Portrait의 핵심적인 기술적 혁신은 움직임(Motion)을 표현하는 방식을 ‘명시적(Explicit)’ 요소와 ‘암시적(Implicit)’ 요소로 이원화하여 분리(Disentanglement)했다는 점에 있습니다. 기존의 확산 기반(Diffusion-based) 모델들은 드라이빙 비디오에서 추출된 특징을 하나의 통합된 벡터나 특징 맵으로 처리하는 경향이 있었습니다. 이로 인해 머리의 각도를 조절(Pose)하려고 하면 눈이나 입의 모양(Expression)이 의도치 않게 변하는 ‘얽힘 현상’이 발생했습니다.

이를 해결하기 위해 저자들은 포즈를 3D 변환 행렬(P)이라는 명시적인 기하학적 변환으로 정의했습니다. 이는 머리의 회전과 이동을 수학적으로 명확하게 규정함으로써, 기하학적 구조의 왜곡 없이 물리적인 움직임만을 전달할 수 있게 합니다. 반면, 미세하고 비선형적인 변화가 특징인 표정은 잠재 코드(Latent Code)라는 암시적인 방식으로 처리하여, 복잡한 근육의 움직임을 유연하게 학습할 수 있도록 설계했습니다.

구현 측면에서 주목할 점은 ‘Dual-branch Conditioning’ 메부아니즘입니다. 포즈 정보는 확산 모델 내에서 공간적 변환을 유도하는 브랜치로 주입되어 픽셀의 위치를 재배치하는 역할을 수행하며, 표정 정보는 Cross-attention 메커니즘을 통해 텍스트-이미지 생성 모델과 유사한 방식으로 특징을 주입받습니다. 또한, ‘Progressive Hybrid Classifier-Free Guidance’를 도입하여, 드라이빙 신호를 충실히 따르면서도 원본 이미지의 정체성(Identity)이 훼손되지 않도록 정교하게 제어합니다. 이러한 구조적 분리는 단순한 품질 향상을 넘어, ‘표정만 변경하기’ 또는 ‘포즈만 변경하기’와 같은 고차원적인 편집 기능을 가능하게 합니다.

최근 생성형 AI 기술의 발전으로 단 한 장의 사진만으로도 살아 움직이는 듯한 인물 애니메이션을 만드는 것이 가능해졌습니다. 하지만 기존의 확산 모델 기반 기술들은 치명적인 약점을 가지고 있었습니다. 바로 움직임의 제어권이 분리되지 않았다는 점입니다. 사용자가 인물의 고개 각도를 바꾸고 싶을 때, 모델은 의도치 않게 인물의 미소나 눈매까지 함께 변형시켜 버리는 ‘Entanglement(얽힘)’ 문제를 겪어왔습니다. 이는 정교한 영상 편집이나 디지털 휴먼 제작 분야에서 매우 큰 장애물이었습니다.

본 논문에서 제안하는 DeX-Portrait는 이러한 문제를 해결하기 위해 움직임의 표현 방식을 근본적으로 재정의합니다. 연구진은 움직임을 두 가지 독립적인 채널로 나누었습니다. 첫째, ‘포즈(Pose)‘는 전역적인 3D 변환 행렬을 통해 명시적으로 표현됩니다. 이는 머리의 회전, 이동, 크기 변화와 같은 기하학적 움직임을 수학적 변환으로 처리하여, 얼굴의 구조적 일관성을 유지하면서도 정확한 자세 변화를 이끌어냅니다. 둘째, ‘표정(Expression)‘은 암시적인 잠재 코드로 표현됩니다. 입꼬리의 떨림이나 눈의 깜빡임 같은 미세한 변화는 정형화된 수식보다는 데이터의 패턴을 학습하는 잠재 공간을 통해 구현함으로써, 훨씬 풍부하고 자연스러운 표정 생성을 가능케 했습니다.

이러한 분리된 신호를 효과적으로 결합하기 위해 DeX-Transformer라는 강력한 모션 트레이너를 설계했습니다. 이 트레이너는 드라이빙 비디오로부터 포즈와 표정을 각각 정밀하게 추출하는 인코더를 학습시킵니다. 추출된 신호는 확산 모델의 생성 과정에 서로 다른 방식으로 주입됩니다. 포즈 정보는 듀얼 브랜치 메커니즘을 통해 이미지의 공간적 변형을 유도하는 방식으로 작용하며, 표정 정보는 크로스 어텐션(Cross-attention)을 통해 이미지의 세부적인 특징을 결정하는 방식으로 작용합니다.

마지막으로, 인물 애니메이션에서 가장 중요한 요소 중 하나인 ‘정체성 유지(Identity Consistency)‘를 위해 ‘Progressive Hybrid Classifier-Free Guidance’라는 새로운 가이던스 전략을 제안합니다. 이는 생성 과정의 단계에 따라 드라이빙 신호의 영향력과 원본 이미지의 특징 유지력을 동적으로 조절함으로써, 움직임은 역동적이면서도 인물의 얼굴은 원본과 똑같이 유지되도록 돕습니다.

실험 결과, DeX-Portrait는 기존의 최첨단(SOTA) 모델들과 비교했을 때 애니메이션의 품질뿐만 아니라, 포즈와 표정을 각각 독립적으로 제어할 수 있는 능력(Disentangled Controllability) 면에서 압도적인 성능을 보여주었습니다. 이는 향후 영화 제작, 게임 개발, 메타버스 내 디지털 휴먼 구현 등 정교한 인물 제어가 필요한 다양한 산업 분야에 혁신적인 도구가 될 것으로 기대됩니다.

댓글 및 학술 토론

Loading comments...

의견 남기기