집중된 주의가 모든 것을 바꾸는 생성형 추천 FAIR

초록

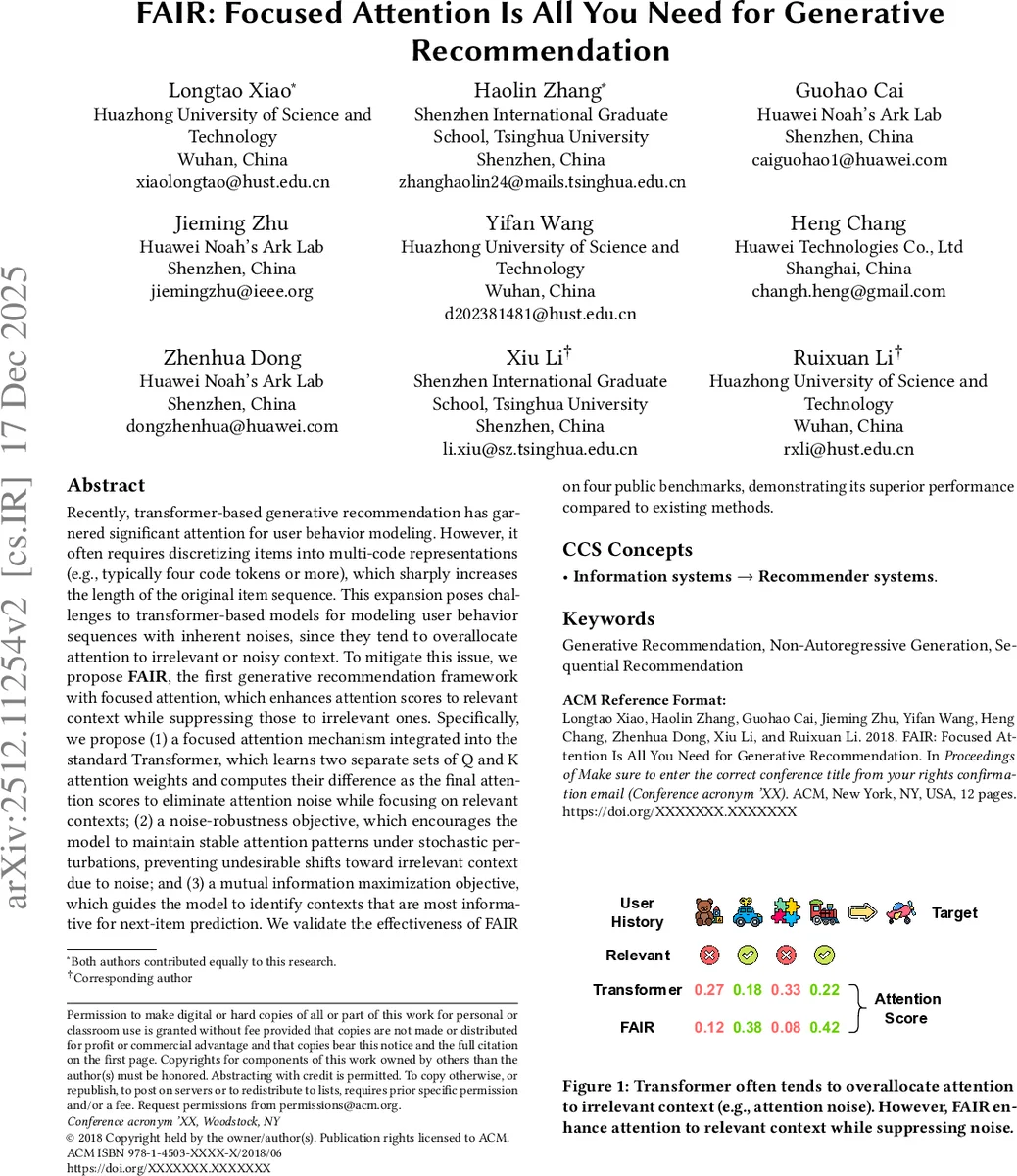

FAIR는 멀티코드 토큰으로 길어지는 사용자 행동 시퀀스에서 발생하는 ‘주의 잡음’을 억제하기 위해 두 개의 독립적인 Q‑K 행렬을 학습하고, 이들의 어텐션 점수를 차감해 집중된 어텐션을 구현한다. 또한, 노이즈 강인성을 위한 일관성 손실과 다음 아이템 예측에 가장 유용한 컨텍스트를 강조하는 상호정보 최대화 손실을 도입해, 기존 Transformer 기반 생성형 추천 모델보다 전반적인 성능을 크게 향상시킨다.

상세 분석

FAIR 논문은 최근 Transformer 기반 생성형 추천 시스템이 아이템을 다중 코드 토큰으로 변환하면서 시퀀스 길이가 급격히 늘어나고, 이로 인해 노이즈가 많은 컨텍스트에 과도하게 어텐션이 할당되는 문제를 지적한다. 이를 해결하기 위해 제안된 핵심 메커니즘은 ‘Focused Attention’이다. 기존 Transformer는 하나의 Q‑K 매트릭스를 사용해 어텐션 스코어를 계산하지만, FAIR는 두 개의 독립적인 Q와 K 행렬(Q₁, K₁ 및 Q₂, K₂)을 학습한다. 각각의 어텐션 스코어 A₁, A₂를 Softmax 후 차감하고 정규화함으로써(A = Norm(λ₁A₁ − λ₂A₂)) 노이즈에 해당하는 상관관계를 억제하고, 실제로 유의미한 상호작용을 강조한다. 이 차분 연산은 신호 처리 분야의 차분 증폭기와 유사하게 작동해, 잡음이 큰 영역의 어텐션 값을 감소시킨다.

또한, 모델의 견고성을 높이기 위해 Noise‑Robustness Task(NRT)를 도입한다. 원본 코드 시퀀스를 무작위 마스킹·대체(p_mask=0.1, p_sub=0.1)하여 노이즈 버전을 생성하고, 원본과 노이즈 버전의 은닉 표현 h, \tilde{h} 사이의 거리를 최소화하면서 배치 내 다른 샘플 h⁻와는 일정 마진(m) 이상 차이 나도록 트리플렛 손실(L_NR)을 적용한다. 이는 모델이 입력 변동에 대해 불변성을 학습하도록 강제해, 실제 서비스 환경에서 발생할 수 있는 데이터 결함이나 불완전한 토큰에 대한 민감도를 크게 낮춘다.

마지막으로, Mutual Information Maximization Task(MIM)을 통해 컨텍스트와 목표 아이템 사이의 상호 정보를 직접 최적화한다. 평균 풀링된 시퀀스 임베딩 x_t와 목표 아이템 임베딩 h_t 사이의 InfoNCE 손실(L_MIM)을 최소화함으로써, 양쪽 표현이 서로를 예측하기에 충분히 풍부하도록 만든다. 이는 기존의 단순 교차 엔트로피 손실만으로는 포착하기 어려운 고차원 의존성을 학습하게 하며, 어텐션이 실제로 예측에 기여하는 부분에 집중하도록 유도한다.

FAIR는 위 세 가지 구성요소를 하나의 Transformer 기반 인코더에 통합하고, 비자동회귀(NAR) 방식으로 전체 코드 시퀀스를 한 번에 예측한다. NAR 접근은 긴 코드 시퀀스에서도 효율적인 추론을 가능하게 하며, 다중 헤드 형태의 Focused Attention을 적용해 다양한 표현 서브스페이스에서 동시에 잡음 억제와 정보 강조를 수행한다. 실험에서는 Four public benchmark(예: Amazon, MovieLens 등)에서 기존 생성형 모델(T5‑Rec, GPTRec, TIGER 등) 및 전통적인 시퀀스 모델(SASRec, BERT4Rec) 대비 HR@10, NDCG@10 등 주요 지표에서 일관된 개선을 보였으며, 특히 코드 길이가 8~12 토큰으로 늘어났을 때 성능 격차가 두드러졌다.

전반적으로 FAIR는 어텐션 스코어 자체를 재구성해 잡음에 강인한 집중 어텐션을 구현하고, 노이즈 일관성 및 상호정보 최적화를 통해 학습 목표를 보강함으로써, 멀티코드 기반 생성형 추천 시스템의 핵심 한계를 효과적으로 극복한다는 점에서 의미가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기