비전‑언어 모델의 시각 비교 추론을 위한 CompareBench 벤치마크

초록

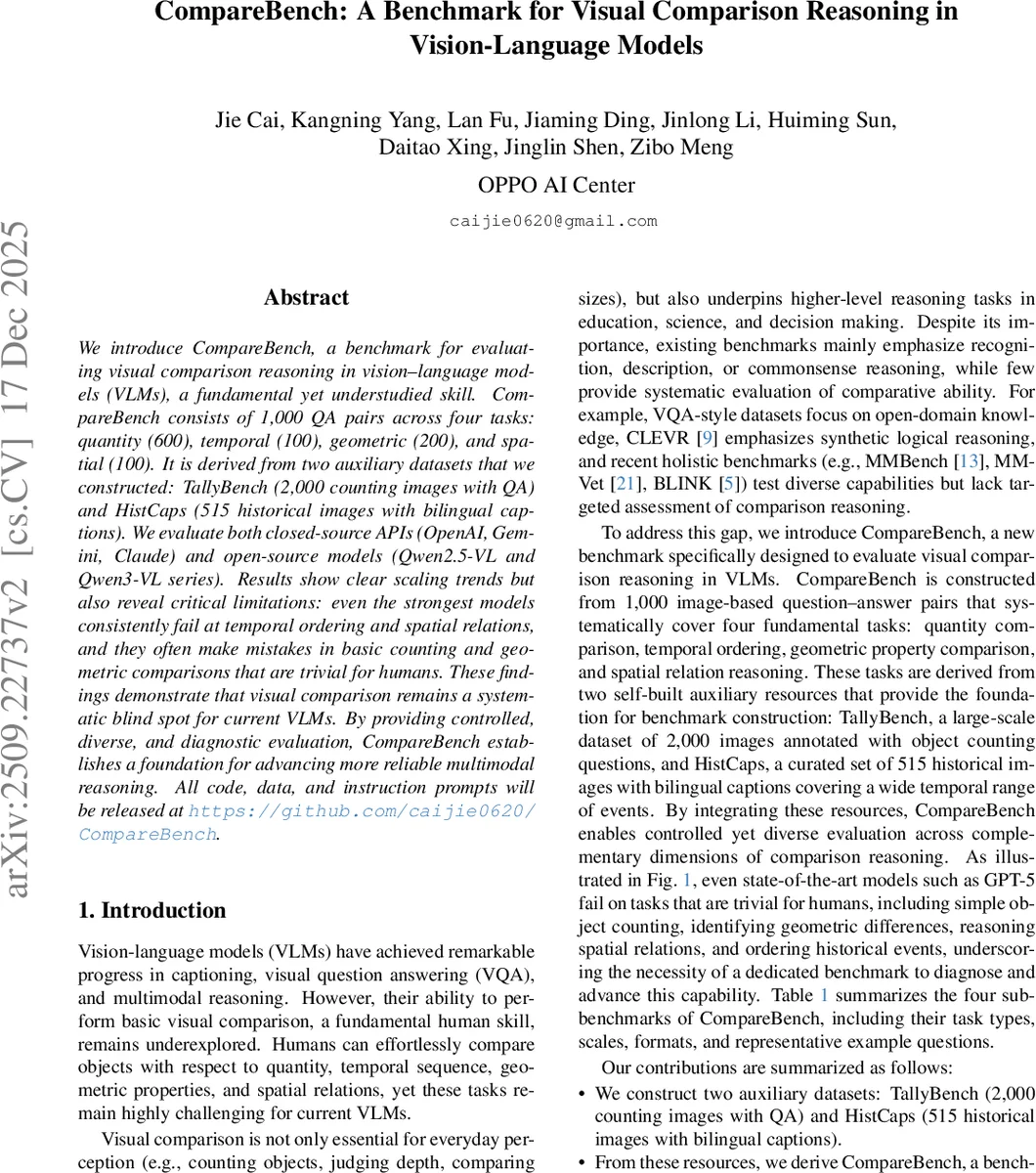

CompareBench는 시각적 비교 추론 능력을 평가하기 위해 1,000개의 QA 쌍을 네 가지 과제로 구성한 새로운 벤치마크이다. TallyBench와 HistCaps라는 두 보조 데이터셋을 기반으로 수량, 시간 순서, 기하학적 속성, 공간 관계 네 영역을 진단한다. 최신 클로즈드‑소스 API와 오픈소스 VLM을 실험한 결과, 모델 규모가 커질수록 전반적인 성능은 향상되지만, 특히 시간 순서와 공간 관계에서 일관된 오류가 발생한다는 한계가 드러났다.

상세 분석

CompareBench는 시각‑언어 모델(VLM)이 인간과 같이 “어떤 것이 더 많고, 더 크고, 더 앞선가”를 판단하는 기본적인 비교 능력을 체계적으로 측정하도록 설계되었다. 먼저 2,000장의 이미지와 카운팅 질문을 포함한 TallyBench를 구축했으며, 여기서는 동물·식물·사람·가전 등 50여 개의 세부 카테고리를 균등하게 배분해 실제 환경에서의 수량 추론을 검증한다. 두 번째 보조 데이터셋인 HistCaps는 515장의 역사적 사진에 영어·중국어 이중 캡션을 달아 시간적 태그와 사건 맥락을 제공한다. 이 두 데이터셋을 바탕으로 CompareBench는 다음 네 가지 서브베치마크로 나뉜다.

-

CompareTallyBench (600) – 4장의 이미지가 1600×1600 그리드로 배열된 형태에서 “어떤 이미지에 개가 가장 많이 보이는가”와 같은 상대적 수량 비교 질문을 제시한다. 질문마다 동일한 객체 카테고리를 대상으로 하며, 모델은 각 서브이미지의 카운트를 정확히 수행한 뒤 가장 큰 값을 가진 이미지를 선택해야 한다.

-

CompareTemporalBench (100) – HistCaps에서 추출한 4장의 역사 사진을 1920×1440 그리드에 배치하고, “어느 장면이 가장 먼저 일어났는가”와 같이 시간 순서를 판단하도록 한다. 각 이미지에는 연도 메타데이터가 포함돼 있어 정답을 명확히 알 수 있다.

-

CompareGeometryBench (200) – 단일 이미지에 A‑D 라벨이 붙은 네 개의 물체를 제시하고, “어떤 물체가 길이가 가장 긴가” 등 길이·너비·높이·두께·직경 중 하나를 비교하도록 한다. 여기서는 시각적 크기와 실제 물리적 차이를 구분해야 하며, 텍스처나 색상은 무시한다.

-

CompareSpatialBench (100) – 역시 A‑D 라벨이 붙은 네 지점을 포함한 이미지에서 “어떤 물체가 카메라에 가장 가깝다” 혹은 “어떤 물체가 지면보다 높이 떠 있다”와 같은 공간 관계를 판단한다. 모델은 라벨된 대상만을 고려하고, 배경이나 다른 객체는 무시해야 한다.

각 서브베치마크는 동일한 프롬프트 템플릿을 사용해 “답은 A‑D 중 하나만 제시하라”는 형식으로 제한함으로써 모델이 불필요한 설명을 생성하지 않게 한다.

평가에서는 OpenAI(GPT‑4o, GPT‑5 시리즈), Google Gemini, Anthropic Claude 등 클로즈드‑소스 API와 Qwen2.5‑VL·Qwen3‑VL 시리즈 같은 오픈소스 모델을 포함해 20여 종을 실험했다. 결과는 모델 규모와 파라미터 수가 증가할수록 전반적인 정확도가 상승하는 스케일링 트렌드를 보였지만, 특히 시간 순서와 공간 관계에서 70 % 이하의 정확도에 머물렀다. 수량 비교에서도 80 %를 넘는 모델이 드물었으며, 기하학적 비교는 상대적으로 높은 성능을 보였지만 여전히 인간 수준(≈95 %)과는 큰 격차가 있다.

오류 분석을 통해 모델이 주로 (1) 시각적 힌트를 과도하게 일반화해 “두께”와 “길이”를 혼동, (2) 이미지 내 반사·그림자 등을 실제 객체로 오인, (3) 시간 메타데이터를 무시하고 시각적 분위기에만 의존하는 경향을 보였다. 특히 GPT‑5 시리즈는 최신 모델임에도 불구하고 TemporalBench에서 70 % 이하, SpatialBench에서 65 % 이하의 성능을 기록해, 현재 VLM이 “시간·공간” 개념을 내재화하는 데 한계가 있음을 시사한다.

이 논문은 기존 VQA·CLEVR·MMBench 등과 달리 실제 사진 기반이며, 다양한 비교 차원을 동시에 다루는 최초의 종합 벤치마크를 제공한다는 점에서 의의가 크다. 또한 데이터와 코드, 프롬프트를 공개함으로써 향후 연구자들이 비교 추론 능력을 강화하기 위한 모델 설계·학습 전략을 손쉽게 검증할 수 있게 한다.

댓글 및 학술 토론

Loading comments...

의견 남기기