끊김 없는 긴 영상 생성을 위한 혁신적 적응형 메모리 기술 MemFlow

초록

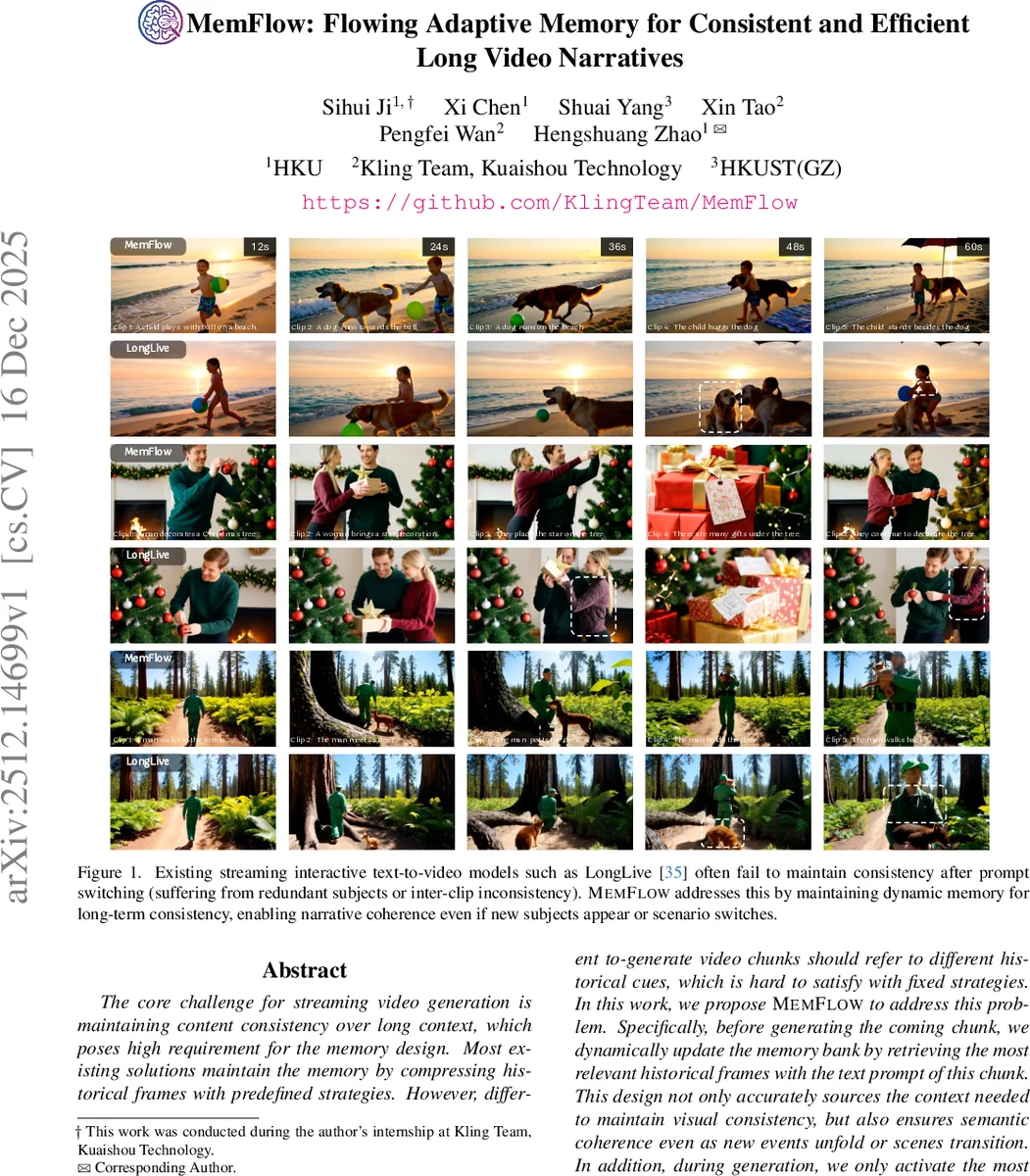

긴 스트리밍 비디오 생성 시 발생하는 콘텐츠 불일치 문제를 해결하기 위해, 현재 생성할 텍스트 프롬프트를 기반으로 과거의 가장 관련 있는 프레임을 동적으로 검색하고 필요한 토큰만 선택적으로 활성화하는 적응형 메모리 관리 기술인 MemFlow를 제안합니다. 이 기술은 연산 효율성을 극대화하면서도 장면 전환이나 새로운 사건 발생 시에도 높은 영상 일관성을 유지합니다.

상세 분석

본 논문에서 제안하는 MemFlow의 핵심 기술적 가치는 ‘정적 압축’에서 ‘동적 검색’으로의 패러다임 전환에 있습니다. 기존의 스트리밍 비디오 생성 모델들은 긴 문맥(Long-context)을 처리하기 위해 과거 프레임을 일정한 규칙(예: 고정된 프레임 스킵 또는 평균화)으로 압축하여 메모리에 저장하는 방식을 취해왔습니다. 그러나 이러한 고정된 전략은 영상 내에서 새로운 이벤트가 발생하거나 배경(Scenario)이 급격하게 전환되는 ‘의미론적 변화(Semantic Shift)‘가 일어날 때, 현재 생성 중인 프레임과 무관한 과거 정보가 메모리를 점유하게 만들어 영상의 일관성을 해치는 치명적인 약점이 있습니다.

MemFlow는 이를 해결하기 위해 ‘텍스트 프롬프트 기반의 동적 메모리 업데이트’ 메커니즘을 도입했습니다. 새로운 비디오 청크(Chunk)를 생성하기 직전, 해당 청크의 텍스트 프롬프트를 쿼리(Query)로 사용하여 메모리 뱅크 내의 과거 프레임들 중 가장 관련성이 높은 프레임을 능동적으로 찾아냅니다. 이는 일종의 ‘비디오 생성용 RAG(Retrieval-Augmented Generation)‘라고 볼 수 있으며, 이를 통해 모델은 현재 생성해야 할 내용에 가장 적합한 과거의 시각적 단서만을 선별적으로 참조할 수 있게 됩니다.

또한, 연산 효율성 측면에서도 혁신적인 접근을 보여줍니다. 메모리 뱅크에 저장된 모든 토큰을 어텐션(Attention) 레이어에서 계산하는 대신, 쿼리와 관련성이 높은 핵심 토큰만을 활성 상태로 유지하여 계산량을 획기적으로 줄였습니다. 결과적으로 MemFlow는 메모리가 없는 베이스라인 모델과 비교했을 때 단 7.9%의 속도 저하만을 보이면서도, 긴 문맥에서의 일관성을 비약적으로 향상시켰습니다. 이는 KV 캐시를 사용하는 기존의 모든 스트리밍 비디오 생성 모델에 즉시 적용 가능한 ‘플러그 앤 플레이(Plug-and-play)’ 방식의 범용성을 갖추었음을 의미합니다.

비디오 생성 AI 기술이 발전함에 따라, 짧은 클립을 넘어 수 분 이상의 긴 영상을 생성하는 ‘스트리밍 비디오 생성’이 중요한 과제로 떠오르고 있습니다. 하지만 긴 영상을 생성할 때 가장 큰 걸림돌은 영상의 시작부터 끝까지 등장인물, 배경, 사물의 특징이 변하지 않고 유지되는 ‘콘텐츠 일관성(Content Consistency)‘을 확보하는 것입니다. 기존의 기술들은 과거의 프레임들을 압축하여 메모리에 저장하는 방식을 사용했으나, 이는 고정된 압축 전략을 사용하기 때문에 영상 중간에 새로운 사건이 등장하거나 장면이 바뀌는 상황에 유연하게 대응하지 못한다는 한계가 있었습니다.

이러한 문제를 해결하기 위해 등장한 MemFlow는 ‘흐르는 듯한 적응형 메모리(Flowing Adaptive Memory)‘라는 개념을 제시합니다. MemFlow의 작동 원리는 크게 두 가지 핵심 축으로 구성됩니다.

첫째, ‘동적 메모리 업데이트(Dynamic Memory Update)‘입니다. 기존 방식이 과거 데이터를 무조건적인 규칙에 따라 압축했다면, MemFlow는 현재 생성하고자 하는 비디오 조각의 텍스트 프롬프트를 활용합니다. 즉, “숲속을 달리는 사자"라는 프롬프트가 들어오면, 메모리 뱅크 내의 과거 데이터 중 사자나 숲과 관련된 시각적 정보를 우선적으로 검색하여 메모리를 업데이트합니다. 이러한 방식은 새로운 이벤트나 시나리오 전환이 발생하더라도, 모델이 현재 문맥에 가장 적합한 과거의 기억을 소환할 수 있게 하여 서사의 일관성을 유지하는 강력한 동력이 됩니다.

둘째, ‘효율적인 토큰 활성화(Efficient Token Activation)‘입니다. 긴 영상을 처리할 때 가장 큰 문제는 데이터가 쌓일수록 연산량이 기하급수적으로 늘어난다는 점입니다. MemFlow는 어텐션 레이어 연산 시 메모리 뱅크 내의 모든 정보를 검토하는 대신, 현재 쿼리와 가장 관련성이 높은 핵심 토큰들만을 선별적으로 활성화합니다. 이는 불필요한 연산을 제거하여 모델의 추론 속도를 유지하는 데 결정적인 역할을 합니다.

실험 결과, MemFlow는 놀라운 성능을 입증했습니다. 메모리가 없는 기본 모델과 비교했을 때 연산 속도 저하는 단 7.9%에 불과했음에도 불구하고, 긴 문맥에서의 영상 일관성은 압도적인 수준을 보여주었습니다. 특히 주목할 점은 MemFlow의 범용성입니다. 이 기술은 KV 캐시(Key-Value Cache)를 사용하는 기존의 어떠한 스트리밍 비디오 생성 모델과도 결합이 가능합니다. 이는 MemFlow가 단순한 하나의 모델을 넘어, 차세대 긴 영상 생성 AI를 위한 표준적인 메모리 관리 프레임워크로 기능할 수 있음을 시사합니다. 결론적으로 MemFlow는 효율성과 일관성이라는 두 마리 토끼를 모두 잡음으로써, 진정한 의미의 장편 비디오 생성 시대를 앞당길 수 있는 핵심 기술로 평가받을 수 있습니다.

댓글 및 학술 토론

Loading comments...

의견 남기기