장시간 음성 인코딩을 위한 세그먼트 기반 어텐션 디코딩 개선

초록

본 논문은 기존 어텐션 기반 인코더‑디코더(AED) 모델이 긴 형태(long‑form) 음성 인코딩을 처리할 때 절대 위치 정보를 잃어 순서 인식에 실패하는 문제를 지적한다. 이를 해결하기 위해 (1) 교차 어텐션에 절대 위치 인코딩을 삽입하고, (2) 긴 문맥을 포함한 학습으로 암묵적 위치 정보를 제거하며, (3) 다양한 세그먼트 구성을 학습시키기 위한 세그먼트 연결, (4) CTC 기반 의미 세그멘테이션을 도입한다. 실험 결과, 이 네 가지 변형이 짧은 구간과 긴 구간 간의 정확도 격차를 크게 줄이고, 자동 회귀 방식의 어텐션 디코더 사용을 가능하게 함을 보여준다.

상세 분석

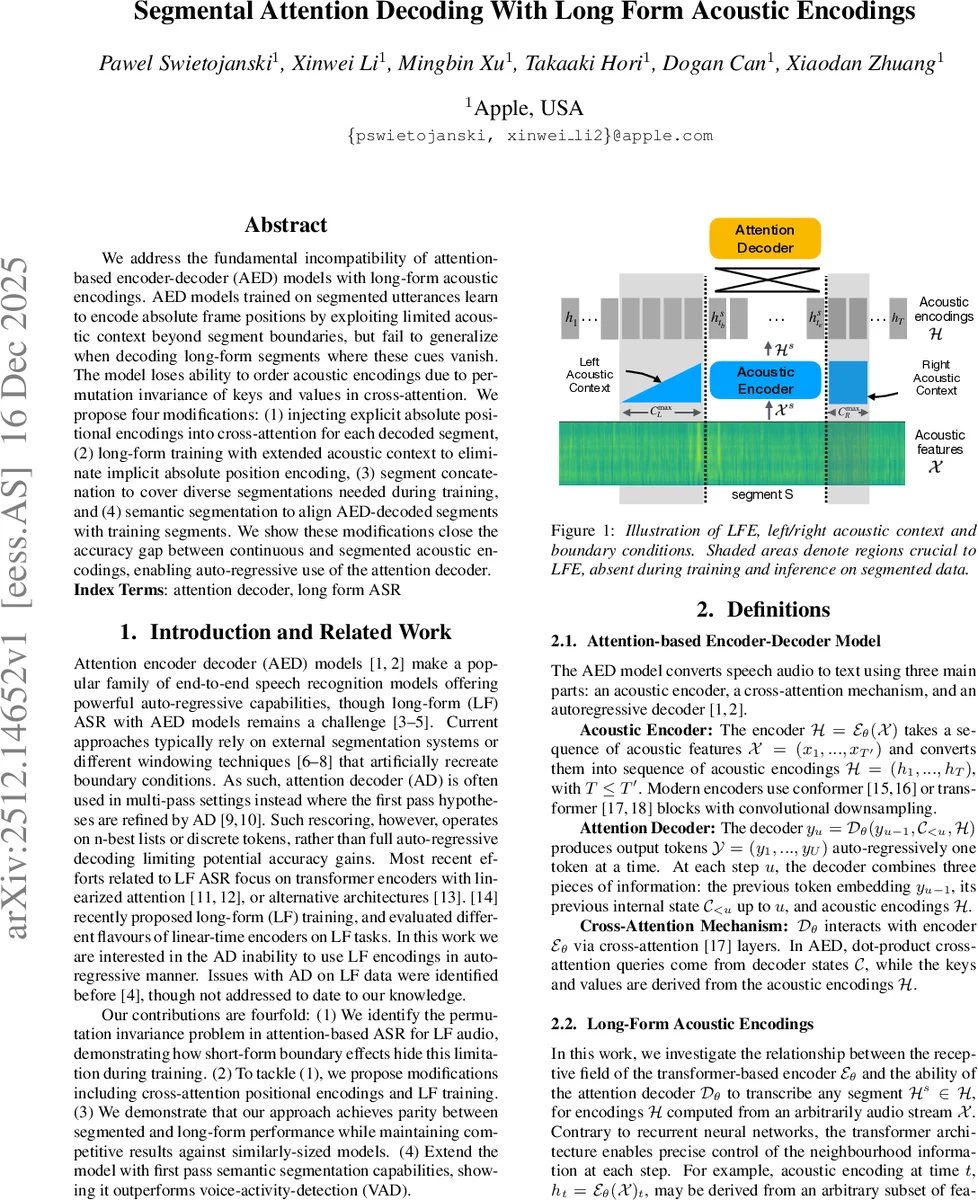

본 연구는 AED 모델이 짧은 구간(세그먼트) 기반 학습 시, 인코더가 경계 근처에서 제한된 양방향 컨텍스트만을 사용함으로써 각 프레임에 암묵적인 절대 위치 정보를 부여한다는 점을 발견한다. 이러한 “경계 효과”는 교차 어텐션이 키와 값의 순열 불변성(permutation invariance) 특성에도 불구하고 디코더가 프레임 순서를 추론하도록 돕는다. 그러나 긴 형태(LFE)에서는 모든 프레임이 최대 좌·우 컨텍스트를 갖게 되면서 경계 효과가 사라지고, 키‑값 쌍이 순서에 무관해지므로 디코더는 반복 출력이나 EOS 토큰 미출력 등 심각한 오류를 보인다.

첫 번째 제안인 절대 위치 인코딩(PE) 삽입은 각 세그먼트에 독립적인 위치 벡터 p를 더해, 교차 어텐션의 쿼리‑키 내적이 시간 순서를 반영하도록 만든다. 기존 입력 단계에서 사용되는 RoPE와는 별도로, 인코더 출력 H에 직접 PE를 더함으로써 디코더가 세그먼트 내부에서만 위치 정보를 활용하도록 설계하였다.

두 번째는 데이터 수준 변형으로, 학습 시 인코더에 좌·우 컨텍스트를 확장(Acoustic Context, AC)하여 실제 LFE와 동일한 환경을 제공한다. 이를 위해 원본 세그먼트 양쪽에 충분한 길이의 음성 데이터를 붙이고, 디코더는 중앙의 유효 구간만을 사용해 손실을 계산한다. 이렇게 하면 모델이 경계에 의존하지 않고, 기존 RoPE가 제공하는 상대적 위치 정보에 기반해 순서를 파악하게 된다.

세 번째 변형인 세그먼트 연결(Segment Concatenation, SC)은 학습 데이터에 여러 연속 세그먼트를 임의로 이어 붙여, 다양한 길이와 경계 패턴을 경험하게 한다. 이는 특히 긴 구간에서 발생할 수 있는 다양한 컨텍스트 조합에 대한 일반화를 촉진한다.

네 번째는 의미 기반 세그멘테이션(Semantic Segmentation, SS)으로, CTC 헤드를 이용해 “segE” 토큰을 예측하게 함으로써 음성 신호가 아닌 의미 단위(문장) 경계를 자동으로 탐지한다. 이렇게 얻은 세그먼트는 두 번째 패스 디코더에 입력되어, 실제 의미적 경계와 일치하는 LFE 세그먼트를 디코딩하도록 한다.

실험에서는 두 가지 모델 규모(Ours.base 90M 파라미터, Ours.small 240M 파라미터)를 사용해 TED‑LIUM3, Earnings21, CommonVoice 등 공개 벤치마크에서 평가하였다. 표 1에서 각 변형을 순차적으로 적용했을 때, 기본 모델은 LFE에서 295%라는 비정상적인 WER를 보였으나, SC만 적용해도 전체 WER가 감소했으며, AC 적용 시 LFE WER가 40.3%까지 크게 개선되었다. PE와 SS를 추가하면 최종적으로 LFE WER가 4.7% 수준으로 SFE와 거의 동등한 성능을 달성했다. 또한, CTC‑Attention 결합 방식과 자동 회귀(AD) 방식 모두에서 긴 구간에 대한 정확도가 크게 상승했으며, Whisper 기반 모델과 비교했을 때 동일하거나 더 나은 결과를 기록했다.

이러한 결과는 (1) 절대 위치 정보를 명시적으로 제공함으로써 교차 어텐션의 순열 불변성 문제를 완화하고, (2) 학습 단계에서 긴 컨텍스트를 경험하게 함으로써 모델이 경계 의존성을 버리게 만들며, (3) 다양한 세그먼트 구성을 학습에 포함시켜 일반화 능력을 강화하고, (4) 의미 기반 세그멘테이션을 통해 실제 문장 경계와 일치하는 디코딩을 가능하게 한다는 네 가지 핵심 아이디어가 서로 보완적으로 작용한다는 점을 보여준다.

댓글 및 학술 토론

Loading comments...

의견 남기기