고성능 실시간 TTS 시스템 GLM TTS

초록

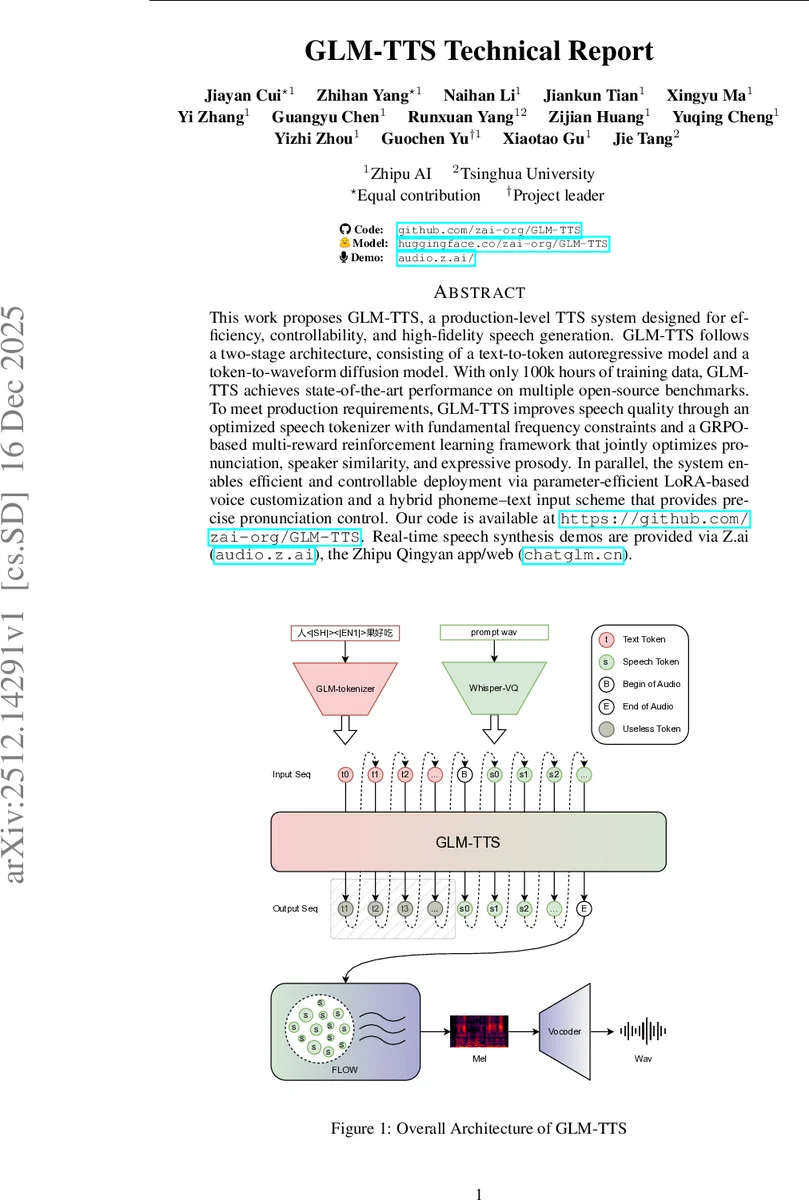

GLM TTS는 텍스트‑투‑토큰 자동회귀 모델과 토큰‑투‑웨이브 디퓨전 모델을 결합한 2단계 구조를 갖춘 생산 수준의 텍스트‑투‑스피치 시스템이다. 100 k시간 규모의 데이터만으로도 공개 벤치마크에서 최첨단 성능을 달성했으며, 기본 주파수 제약이 적용된 Whisper‑VQ 토크나이저, 다중 보상 강화학습(GRPO), LoRA 기반 저비용 프리미엄 음성 커스터마이징, 하이브리드 음소‑텍스트 입력 방식을 통해 발음 정확도와 감정 표현, 사용자 맞춤화를 크게 향상시켰다.

상세 분석

GLM‑TTS는 최근 TTS 연구의 흐름을 반영하면서도 산업 현장의 실용성을 최우선으로 설계된 점이 눈에 띈다. 첫 번째 단계인 텍스트‑투‑토큰 모델은 기존의 자동회귀 방식에 25 Hz 토큰 생성률과 32 k 규모의 확장 vocab을 적용해 고속 발화에서도 발음 오류를 최소화한다. 특히 Whisper‑VQ 기반 토크나이저에 피치 추정 모듈을 추가하고, 인과적 제한을 해제한 비인과적 구조를 채택함으로써 ASR·PE 양쪽의 정확도를 동시에 끌어올렸다.

두 번째 단계인 토큰‑투‑웨이브 디퓨전 모델은 Vocos2D라는 2차원 컨볼루션 기반 보코더를 도입해 주파수 서브밴드 처리를 효율화하고, DiT‑스타일 잔차 연결을 통해 고주파 디테일을 보존한다. 이는 기존 1D GAN 기반 보코더 대비 잡음 감소와 고음역대 재현성을 크게 개선한다.

학습 효율성 측면에서 GLM‑TTS는 대규모 데이터 파이프라인을 구축해 음성 표준화, VAD, 소스 분리·노이즈 제거, 화자 다이어리제이션, WER 기반 필터링 등을 자동화하였다. 특히 WER이 5 % 이하인 고품질 샘플만을 선별함으로써 모델이 학습하는 텍스트‑음성 정렬의 신뢰성을 확보했다.

강화학습 파트에서는 GRPO(Gradient‑Regularized Policy Optimization)를 활용해 CER, SIM, Emotion, Laughter 네 가지 보상을 계층적으로 정규화하고, 동적 샘플링·가변 클리핑을 적용해 보상 해킹과 그래디언트 소실 문제를 완화했다. 이 설계는 감정 표현과 웃음 같은 부가적인 파라링귀스틱 특성을 자연스럽게 학습하도록 만든다.

커스터마이징 측면에서는 LoRA 기반 파라미터 효율 적응을 적용해 전체 파라미터의 15 %만을 튜닝함으로써 1시간 분량의 단일 화자 데이터로도 프리미엄 음성 복제 품질을 달성한다. 이는 기존 전체 파라미터 미세조정 대비 80 % 이상의 비용 절감 효과를 제공한다.

마지막으로 발음 정확도를 위한 Phoneme‑In 기법은 폴리폰 및 희귀 문자에 대해 별도 음소 사전을 구축하고, 학습 시 ‘Hybrid Phoneme+Text’ 방식을 확률적으로 적용한다. 추론 단계에서는 G2P 모듈을 통해 전체 문장을 음소화하고, 지정된 문자만 음소로 교체해 정확한 발음 제어와 자연스러운 억양을 동시에 확보한다.

전반적으로 GLM‑TTS는 토크나이저 설계, 강화학습 보상 설계, 저비용 커스터마이징, 발음 제어 메커니즘을 체계적으로 통합함으로써 고품질, 저지연, 다목적 TTS 서비스를 구현했다. 다만 100 k시간 데이터가 “대규모”라고는 하지만, 실제 산업 현장에서의 다언어·다방언 확장성, 실시간 추론 비용, 그리고 강화학습 보상의 도메인 일반화 등에 대한 추가 검증이 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기