표준 벵골어에서 방언 번역을 위한 검색 강화 생성 비교 연구

초록

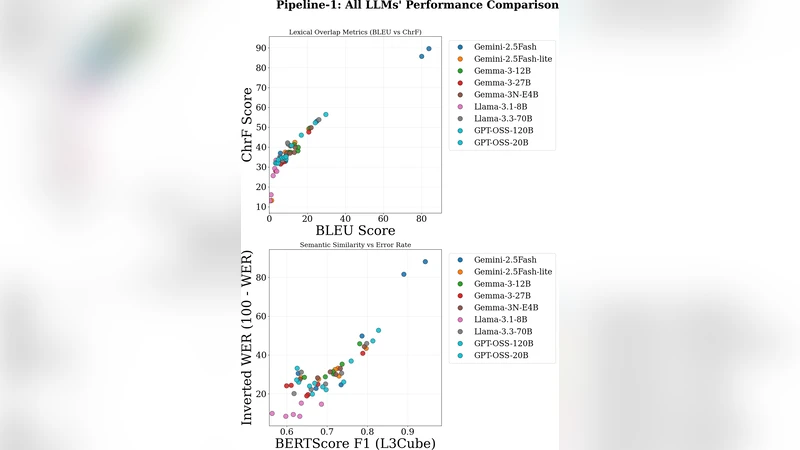

본 논문은 벵골어 표준어를 여섯 지역 방언으로 번역하기 위해 두 가지 검색‑증강 생성(RAG) 파이프라인을 제안하고 비교한다. 첫 번째는 오디오 전사에서 추출한 긴 방언 문맥을 활용하는 전사 기반 파이프라인이며, 두 번째는 구조화된 방언‑표준 문장 쌍을 이용하는 표준화된 문장‑쌍 파이프라인이다. BLEU, ChrF, WER, BERTScore 등 네 가지 지표로 평가한 결과, 문장‑쌍 파이프라인이 전사 기반보다 일관되게 우수했으며, 특히 치타공 방언에서 WER를 76 %에서 55 %로 감소시켰다. 또한 작은 모델(Llama‑3.1‑8B)도 대형 모델(GPT‑OSS‑120B)을 능가할 수 있음을 보여, 검색 전략 설계가 모델 규모보다 핵심임을 강조한다.

상세 분석

이 연구는 저자원이면서도 방언 간 변이도가 큰 언어 환경에서 번역 성능을 끌어올리기 위한 실용적 접근법을 제시한다. 핵심 아이디어는 대규모 사전학습 언어 모델(LLM)에 외부 지식을 동적으로 삽입하는 RAG 구조를 활용하는 것이다. 두 파이프라인은 지식베이스 구축 방식에서 차이를 보인다. 전사 기반 파이프라인은 현장 녹음에서 얻은 방언 음성 전사를 활용해 방언 문맥을 길게 확보한다. 이는 방언 특유의 억양·어휘 변이를 포착하려는 시도지만, 전사 품질에 크게 의존하고 잡음이 섞일 위험이 있다. 반면 표준화된 문장‑쌍 파이프라인은 현지 언어학자와 협업해 만든 방언‑표준 병렬 문장을 데이터베이스화한다. 이 방식은 문장 수준에서 정확한 의미 대응을 보장하고, 검색 단계에서 고품질 후보를 빠르게 반환한다는 장점이 있다.

실험에서는 6개 방언(치타공, 라자, 실렛, 다카, 코르시, 바리) 각각에 대해 동일한 LLM(예: Llama‑3.1‑8B, Llama‑3.1‑70B, GPT‑OSS‑120B)을 적용했다. 평가 지표는 전통적인 BLEU와 ChrF 외에도 음성 인식 오류를 반영하는 WER, 의미적 일치를 측정하는 BERTScore를 포함해 다각적인 성능을 검증했다. 결과는 일관되게 문장‑쌍 파이프라인이 전사 기반보다 우수했으며, 특히 WER 감소폭이 두드러졌다. 이는 검색 단계에서 정확한 방언 문장을 제공함으로써 LLM이 불필요한 추론 오류를 줄이고, 더 직접적인 번역 경로를 선택하게 만든 것으로 해석된다.

또한 모델 규모와 성능의 상관관계를 재조명했다. 작은 Llama‑3.1‑8B 모델은 고품질 검색 결과와 결합될 때 GPT‑OSS‑120B와 비교해 동일하거나 더 나은 BLEU·ChrF·WER 점수를 기록했다. 이는 “모델 크기보다 검색 전략이 핵심”이라는 결론을 뒷받침한다. 저자들은 이 점을 통해 저자원 방언 번역에 있어 대규모 파인튜닝 대신 효율적인 RAG 설계가 비용·시간 측면에서 더 현실적임을 강조한다.

한계점으로는 전사 기반 파이프라인이 잡음에 취약하고, 방언‑표준 문장‑쌍 데이터베이스 구축에 인적 비용이 많이 든다는 점을 들었다. 또한 현재 실험은 LLM의 프롬프트 설계에 크게 의존하므로, 프롬프트 최적화가 추가 성능 향상의 여지를 남긴다. 향후 연구에서는 멀티모달(음성·텍스트) 통합 RAG, 자동 문장‑쌍 생성 기법, 그리고 방언 간 상호보완적 전이 학습을 탐색할 계획이다.

전반적으로 이 논문은 저자원 방언 번역 문제에 대한 실용적 해결책을 제시하고, 검색‑증강 전략이 모델 규모를 뛰어넘는 효과를 가질 수 있음을 실증적으로 보여준다.

댓글 및 학술 토론

Loading comments...

의견 남기기