VIBE: 비전 언어 모델이 사회적 상황을 읽을 수 있을까

초록

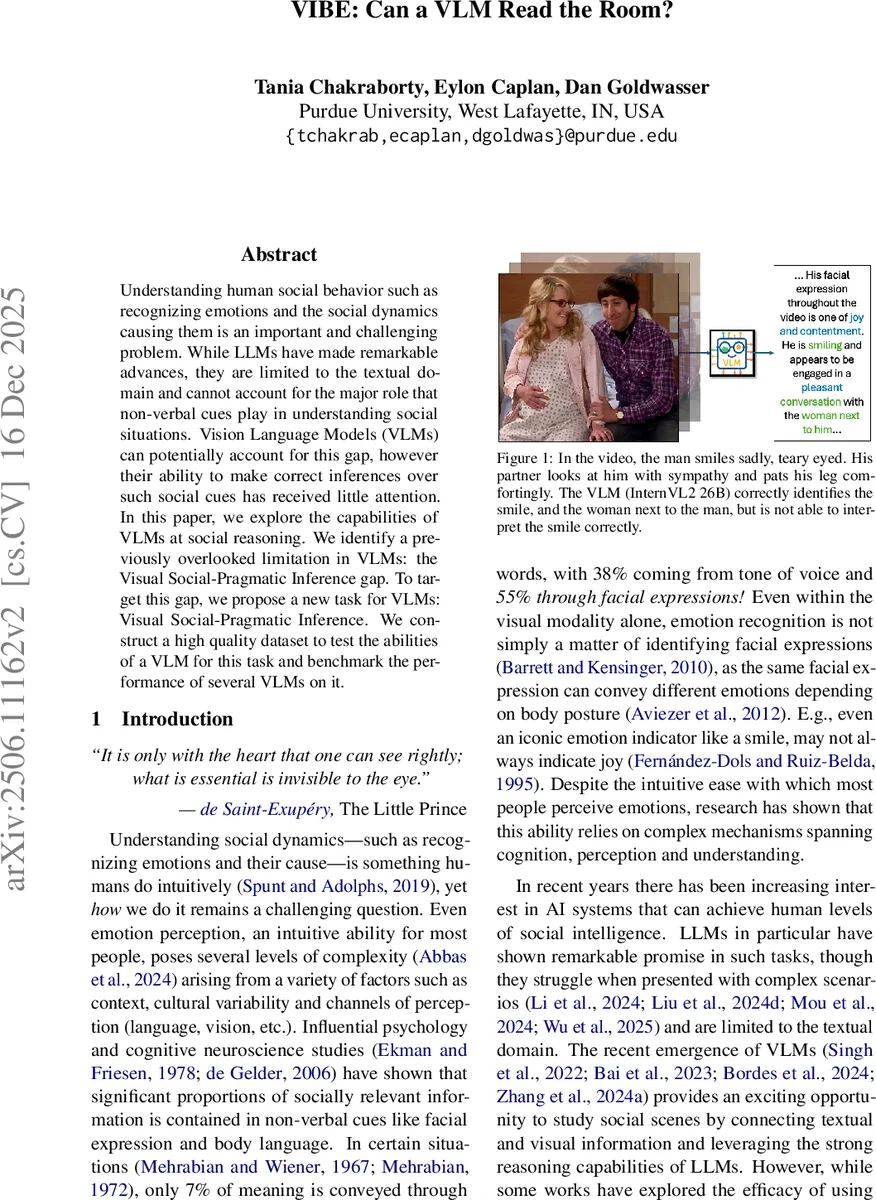

본 논문은 비전‑언어 모델(VLM)이 영상 속 비언어적 단서들을 올바르게 해석해 인간의 감정 및 사회적 의미를 추론하는 능력을 평가한다. 이를 위해 ‘Visual Social‑Pragmatic Inference’(VSP)라는 새로운 과제를 정의하고, 994개의 사례로 구성된 VIBE 데이터셋을 구축해 여러 최신 VLM을 벤치마크하였다. 결과는 VLM이 시각적 단서는 인식하지만, 그 의미를 실질적으로 파악하는 데는 인간보다 크게 뒤처진다는 점을 보여준다.

상세 분석

본 연구는 VLM이 사회적 상황을 이해하는 데 필요한 두 단계, 즉 “시각적 단서(Visual Cue) 탐지”와 “그 단서에 대한 실용적(pragmatic) 해석(VSP Inference)” 사이에 존재하는 격차를 체계적으로 규명한다. 기존 연구들은 주로 시각적 단서의 존재 여부(즉, hallucination 여부)만을 평가했으나, 저자들은 동일한 단서를 올바르게 인식하더라도 그 의미를 오해하는 경우가 빈번함을 발견한다. 이를 ‘Visual Social‑Pragmatic Inference gap’이라 명명하고, VSP Inference 전용 과제와 데이터셋을 설계하였다.

VIBE 데이터셋은 994개의 비디오 클립(4초 이하, 다중 언어·문화)에서 명시적으로 “시각적 단서”가 존재함을 보장하고, 각 클립마다 두 개의 상반된 VSP 추론(예: ‘웃음=기쁨’ vs. ‘웃음=슬픔’)을 제시한다. 인간 평가자를 통해 정답 라벨을 확보했으며, 이는 모델이 단순히 hallucination을 피하고 실제 의미를 파악하도록 강제한다.

실험에서는 InternVL2 26B, Qwen 3B/7B 등 4가지 VLM을 독립형(VLM‑only)과 VLM‑LLM 협업(시각적 설명을 LLM에 전달) 두 시나리오에서 평가했다. 감정 예측 진단 과제에서는 텍스트 전용 GPT‑4o‑mini가 가장 높은 F1(0.538)을 기록했으며, VLM이 시각 정보를 추가해도 성능 향상이 미미했다. 특히, 가장 큰 모델인 InternVL2 26B조차 텍스트 전용보다 크게 앞서지 못했다. VSP Inference 과제에서는 인간이 17.2% 높은 정확도를 보였으며, 모델들의 주요 오류는 미세한 눈동자 움직임, 눈물, 몸 자세와 같은 “미묘한 비언어적 신호”를 잘못 해석하거나 무시하는 것이었다.

이러한 결과는 현재 VLM이 시각적 패턴 인식에는 강하지만, 사회적·정서적 맥락을 고려한 의미론적 추론에는 한계가 있음을 시사한다. 또한, VLM‑LLM 연동 시에도 시각 설명이 노이즈가 많아 LLM의 추론을 오히려 방해할 수 있음을 보여준다. 향후 연구는 (1) 시각적 단서와 그 의미 사이의 연결 고리를 명시적으로 학습시키는 방법, (2) 프라그머틱 정보를 강화하는 멀티모달 프롬프트 설계, (3) 장시간 영상에서의 연속적 맥락 파악 능력 향상이 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기