밀도 추정에서 최적 근사 계수: 2와 3의 경계

초록

본 논문은 임의의 밀도 집합 𝒬에 대해 총변동거리(TV) 기준으로 목표 분포 p와 가장 가까운 후보를 찾는 문제를 다룬다. 기존 Yatracos 알고리즘은 𝒬에서 적절히 선택된 후보를 3배 근사 보장으로 학습할 수 있음을 보여주었지만, 저자는 (i) 적절한(Proper) 학습에서는 3이라는 계수를 넘을 수 없으며, (ii) 부적절한(Improper) 학습, 즉 𝒬 외의 분포를 출력하도록 허용하면 계수를 2로 낮출 수 있음을 증명한다. 두 가지 접근법(정적·동적)을 제시하고, 샘플 복잡도 분석에 적응형 데이터 분석 기법을 활용한다.

상세 분석

논문은 먼저 총변동거리(TV)를 거리 척도로 선택한 이유를 상세히 논증한다. TV는 L¹ 노름과 동등하고, 확률 측면에서 가장 큰 사건 차이를 직접 측정한다는 점에서 다른 거리(예: KL, Hellinger)보다 강건하고 해석이 쉬우며, 무한 도메인에서도 정의가 가능하다. 그런 점에서 ‘agnostic’ 설정—즉 p가 𝒬에 속하지 않을 수도 있다는 가정—하에 TV 기반 학습이 자연스럽다. 기존 연구(Yatracos, 1985)는 Yatracos 집합을 이용해 𝒬가 유한할 때 O(ε⁻²) 샘플로 3배 근사(α=3)를 달성할 수 있음을 보였으며, Mahalanabis‑Stefankovic(2008)는 n=2인 경우 무작위 적절 알고리즘으로 2배 근사를 얻을 수 있음을 제시했다. 그러나 일반적인 유한 𝒬에 대해 2배 근사를 얻는 보편적 방법은 없었다.

저자는 두 가지 주요 정리를 제시한다. 정리 1은 모든 유한 𝒬에 대해 부적절 학습(임의의 밀도 출력 허용)으로 α=2를 달성할 수 있음을 보이며, 정리 2는 적절 학습에서는 α<3이 불가능함을 보여준다. 정리 2의 하한은 Le Cam 방법을 텐서화하고 ‘생일 역설’ 논리를 적용해 두 개의 특수 분포를 구성함으로써 증명된다. 이때 TV 거리의 하한은 2·opt이므로, 적절 알고리즘은 3배 계수 이하로 개선될 여지가 없다는 것이 핵심이다.

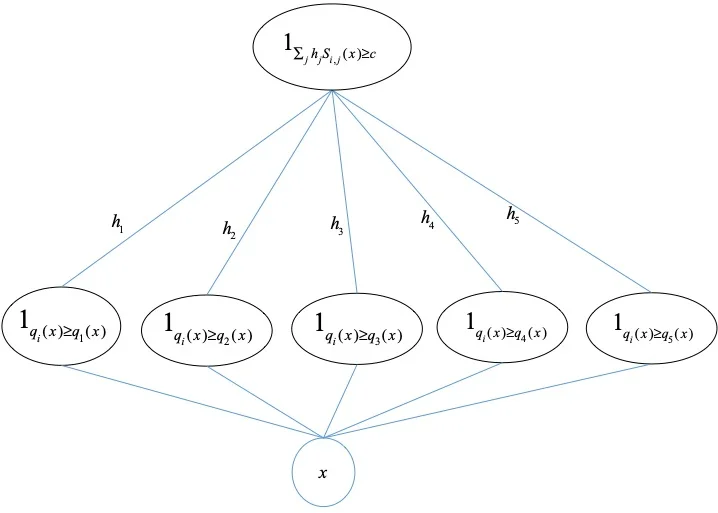

알고리즘 설계는 ‘거리 벡터’ v(p) = (TV(p,q₁),…,TV(p,q_n))에 기반한다. Lemma 3에 따르면, 어떤 q가 v(q) ≤ v(p)+ε·1ₙ을 만족하면 TV(q,p) ≤ 2·opt+ε가 된다. 이를 이용해 두 가지 구현 방식을 제시한다. 첫 번째는 정적 방법으로, Yatracos 집합을 일반화한 함수군 𝔽를 정의하고, 그 VC 차원을 이용해 서브‑TV 메트릭 d_𝔽를 추정한다. 여기서는 서브‑TV를 정확히 추정하기 위해 샘플 복잡도가 O(|𝒬|·ε⁻²·log|𝒳|) 정도 필요하다. 두 번째는 적응형 방법으로, 각 후보 q_i에 대한 하한 z_i를 유지하면서 매 단계 하나 이상의 z_i를 ε만큼 올린다. 이때 최소극값 정리를 활용해 f_i 함수를 찾아 E_p

댓글 및 학술 토론

Loading comments...

의견 남기기