Olmo 3: 완전 공개형 대규모 언어·사고 모델 패밀리

초록

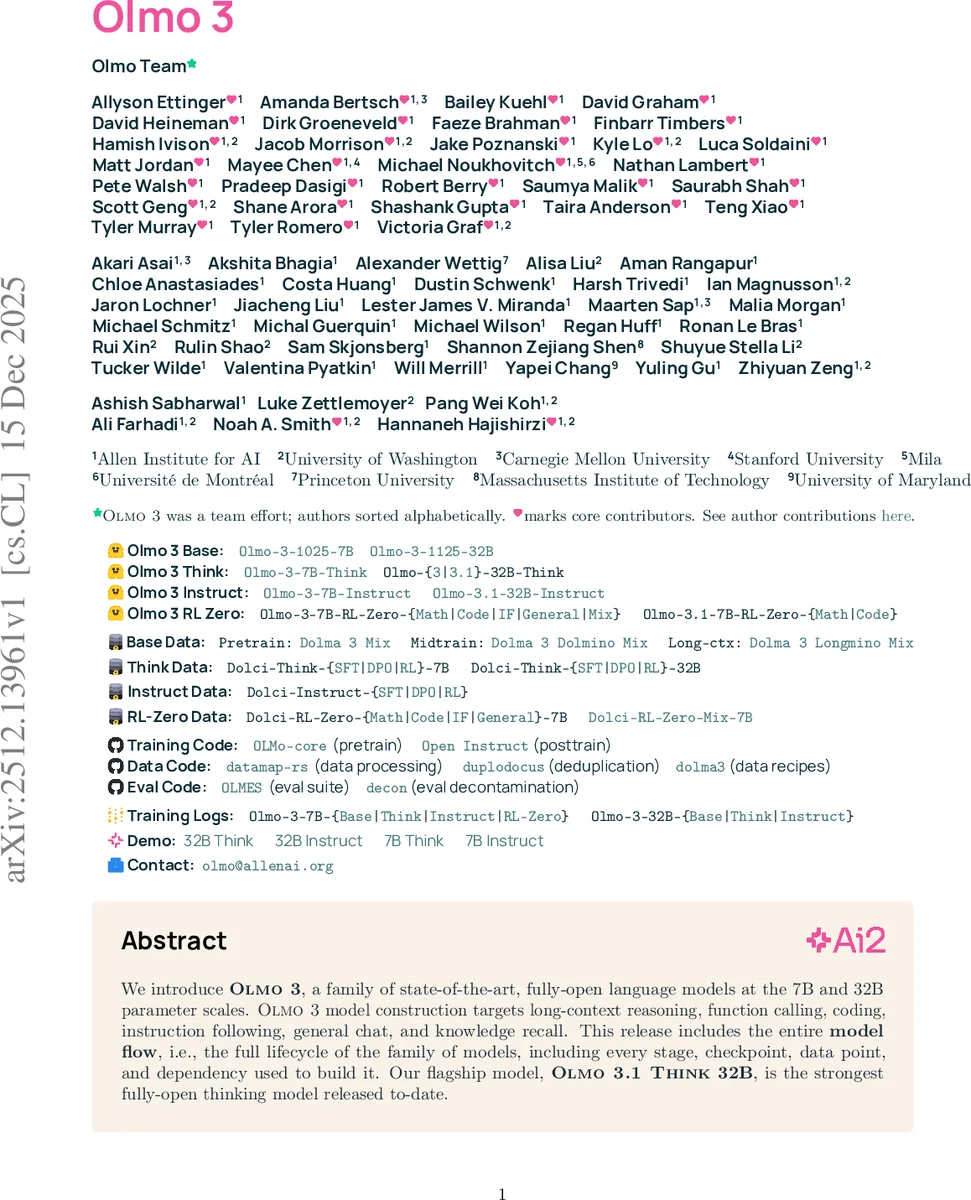

Olmo 3는 7 B와 32 B 파라미터 규모의 완전 공개 언어 모델 시리즈로, 기본 베이스 모델을 기반으로 사고(Think), 명령(Instruct), 그리고 RL‑Zero 세 가지 파생 모델을 제공한다. 장기 컨텍스트, 함수 호출, 코딩, 지식 회수 등 다양한 작업에 최적화됐으며, 전체 모델 흐름(데이터, 코드, 체크포인트)을 모두 공개한다. 특히 Olmo 3.1 Think 32 B는 현재 공개된 사고 모델 중 최고 성능을 기록한다.

상세 분석

Olmo 3 프로젝트는 모델 개발 전 과정을 투명하게 공개함으로써 연구 재현성과 커스텀화를 극대화한다는 철학을 갖는다. 베이스 모델은 5.9 T 토큰 규모의 Dolma 3 Mix(전처리·중복제거·학술 PDF OCR)으로 사전학습을 시작하고, 이어 100 B 토큰 규모의 Dolma 3 Dolmino Mix으로 중간 학습(mid‑training)한다. 이 단계에서는 코드·수학·일반 QA 데이터를 고품질로 재구성해 모델의 추론 능력을 급격히 향상시킨다. 장기 컨텍스트 확장은 Dolma 3 Longmino Mix을 활용해 65 K 토큰까지 입력을 지원하도록 설계했으며, 22.3 M개의 8 K‑이상, 4.5 M개의 32 K‑이상 문서를 포함한다.

베이스 모델 위에 구축된 파생 모델은 각각 다른 목표를 가진다. Think 시리즈는 SFT → DPO → RL‑VR 순서로 단계적 파인튜닝을 수행한다. Dolci Think SFT는 사고 트레이스를 포함한 합성 데이터를 사용해 단계별 추론 과정을 학습시키고, Dolci Think DPO는 Delta Learning 기반의 고품질 대비 데이터로 선호 튜닝을 수행한다. 마지막 RL‑VR 단계에서는 검증 가능한 보상을 도입해 수학·코드·일반 대화 영역에서 4배 가속된 RL 학습을 달성한다.

Instruct 시리즈는 응답 길이와 효율성을 중시한다. Dolci Instruct SFT는 함수 호출에 특화된 데이터를 추가해 실용적인 인터페이스를 강화하고, Dolci Instruct DPO는 다중 턴 선호 데이터를 활용해 간결하고 정확한 응답을 유도한다. RL‑VR을 통해 최종적으로도 짧은 지연시간과 높은 정확도를 유지한다.

RL‑Zero 변형은 베이스 모델에서 직접 RL을 수행함으로써 베이스 데이터가 RL 성능에 미치는 영향을 연구할 수 있게 한다. 이는 기존 공개 RL 모델이 베이스 가중치를 비공개로 유지하던 문제를 해소한다.

전체 평가에서는 OlmoBaseEval이라는 자체 벤치마크 스위트를 사용해 작은 규모 모델에서 신호‑노이즈 비율을 높이는 전략을 적용했으며, 결과적으로 Olmo 3 Base 32 B는 Qwen 2.5 32 B 등 경쟁 모델을 앞선 성능을 보였다. Think 32 B는 Qwen 3 32 B와 근접한 추론 점수를 기록하면서도 토큰 사용량이 6배 적다. Instruct 32 B 역시 Gemini 3 27 B, Granite 3.3 등과 비교해 전반적인 성능 격차를 크게 줄였다.

기술적 혁신은 데이터 커리큘럼(트랜스포머‑스케일링에 맞춘 토큰‑제한 믹싱·품질‑가중 업샘플링), 대규모 중복제거 파이프라인, 그리고 OlmoRL이라는 효율적인 RL 프레임워크에 있다. 특히 검증 가능한 보상 설계와 Delta Learning 기반 대비 데이터 생성은 기존 SFT‑만 기반 모델이 도달하기 어려운 고차원 추론 능력을 확보하게 한다.

전반적으로 Olmo 3는 “모델 흐름 전체 공개”라는 새로운 표준을 제시하며, 연구자들이 중간 체크포인트와 데이터 풀을 자유롭게 활용해 맞춤형 모델을 만들 수 있게 한다. 이는 오픈소스 LLM 생태계의 투명성·재현성을 크게 향상시킬 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기