리뷰가 사라져도 괜찮을까 대형 언어 모델 시대의 추천 시스템

초록

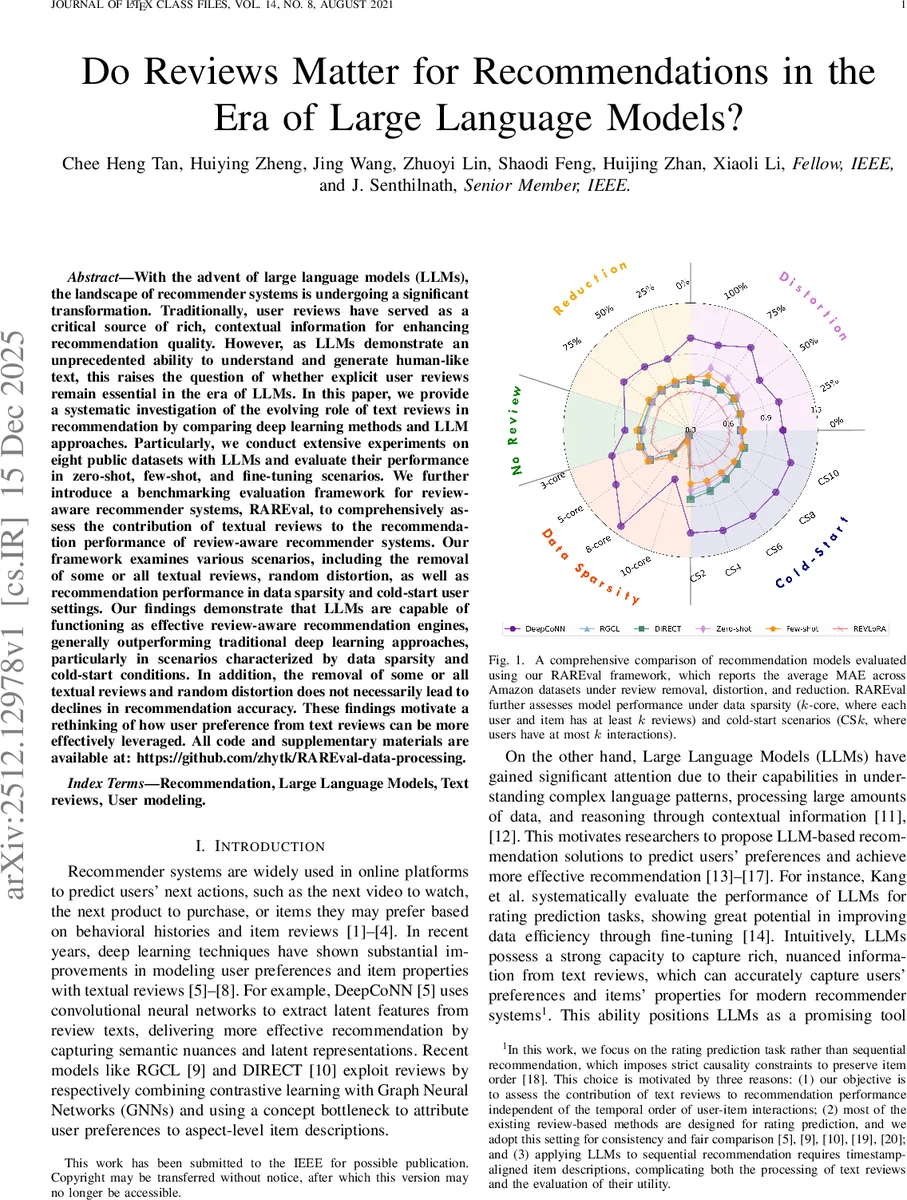

본 논문은 대형 언어 모델(LLM)이 리뷰 정보를 활용한 추천 성능에 미치는 영향을 체계적으로 조사한다. 8개의 공개 데이터셋을 대상으로 LLM을 제로‑샷, few‑shot, 그리고 제안된 REVLoRA 파인튜닝 방식으로 실험하고, 리뷰 제거·왜곡·희소성·콜드스타트 등 다양한 상황을 포함하는 RAREval 평가 프레임워크를 구축하였다. 결과는 LLM이 전통적인 딥러닝 기반 리뷰‑aware 모델을 전반적으로 능가하며, 특히 데이터가 부족하거나 신규 사용자일 때 리뷰의 존재 여부가 성능에 큰 영향을 주지 않음을 보여준다.

상세 분석

본 연구는 세 가지 주요 축으로 분석된다. 첫째, 리뷰‑aware 추천 모델에 대한 기존 딥러닝 접근법(DeepCoNN, NARRE, RGCL 등)과 최신 LLM 기반 접근법을 동일 조건에서 비교하였다. LLM은 사전 학습된 방대한 언어 지식을 활용해 텍스트 리뷰를 직접 이해하고 요약·추출하는 프롬프트 설계가 핵심이며, 제로‑샷에서는 별도 학습 없이 사용자·아이템 리뷰를 입력해 바로 평점을 예측한다. 둘째, 제안된 REVLoRA는 LoRA(Low‑Rank Adaptation) 기법을 LLM에 적용해 리뷰와 평점 데이터를 효율적으로 파인튜닝한다. 이는 기존 전체 파라미터 업데이트에 비해 학습 시간과 메모리 비용을 크게 절감하면서도 성능 향상을 달성한다. 셋째, RAREval 프레임워크는 리뷰 전체 삭제, 부분 삭제, 무작위 왜곡, k‑core 희소성, CS_k 콜드스타트 등 5가지 시나리오를 정의하고, MAE와 RMSE를 포함한 다중 지표로 모델을 평가한다. 실험 결과, LLM은 리뷰를 완전히 제거하거나 일부만 남겨도 성능 저하가 미미했으며, 특히 데이터가 5‑core 이하로 희소해질수록 LLM의 상대적 우위가 확대되었다. 이는 LLM이 텍스트 외에도 사용자‑아이템 메타데이터와 내재된 언어 패턴을 활용해 일반화 능력을 갖추었기 때문이다. 또한, few‑shot 설정에서 몇 개의 데모만 제공해도 LLM은 안정적인 예측을 수행했으며, REVLoRA 파인튜닝은 콜드스타트 사용자에 대한 MAE를 10 % 이상 개선하였다. 이러한 결과는 리뷰 텍스트가 반드시 모델 성능의 핵심 요소가 아니라는 기존 가설에 도전하고, LLM 기반 시스템이 텍스트 외의 다양한 신호를 통합해 강건한 추천을 구현할 수 있음을 시사한다.

댓글 및 학술 토론

Loading comments...

의견 남기기