LegalRikai 벤치마크: 일본 기업 법률 업무를 위한 AI 평가의 새로운 기준

초록

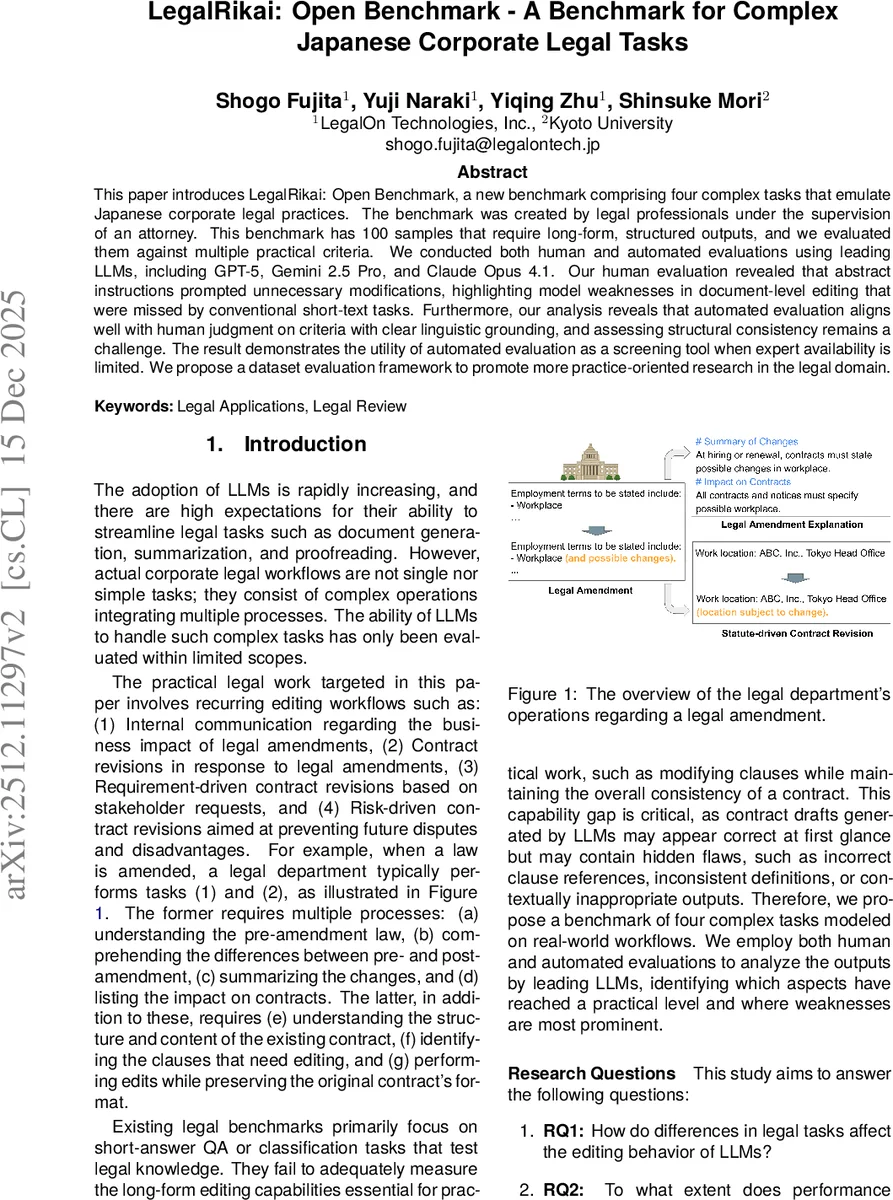

본 논문은 일본 기업 법률 실무를 모방한 4가지 복잡한 작업으로 구성된 새로운 벤치마크 ‘LegalRikai: Open Benchmark’을 소개합니다. 변호사 감독 하에 법률 전문가가 제작한 100개의 샘플을 GPT-5, Gemini 2.5 Pro, Claude Opus 4.1 등 최신 LLM으로 평가한 결과, 추상적 지시는 불필요한 수정을 유발하며 문서 수준 편집 능력이 부족함을 확인했습니다. 또한 명확한 언어적 기준이 있는 항목에서는 자동 평가가 인간 평가와 잘 일치하나, 구조적 일관성 평가는 여전히 과제로 남았습니다.

상세 분석

본 논문이 제시하는 LegalRikai 벤치마크는 기존의 단답형 QA나 분류 작업 위주의 법률 벤치마크와 차별화됩니다. 실제 법률 실무에서 핵심인 장문의 구조화된 출력 생성 및 문서 수준 편집 능력을 평가하는 데 초점을 맞췄습니다. 네 가지 작업(AmendExp, StatRev, ReqRev, RiskRev)은 각각 법률 개정의 영향 분석, 법령 기반 계약 수정, 명시적 요구사항 반영, 위험 완화형 수정이라는 서로 다른 인지 부하와 전문성을 요구하며, LLM의 실무 적용 가능성을 다각도로 검증합니다.

기술적 통찰로는 첫째, ‘추상적 지시’가 모델의 약점을 부각시킨 점입니다. RiskRev 작업처럼 “계약자에 유리하게 수정하라"는 고수준 지시는 모델로 하여금 불필요하거나 과도한 수정을 유발했으며, 이는 기존 단문 작업으로는 포착하기 어려운 문서 전반의 맥락 이해와 균형 잡힌 판단 능력의 부재를 드러냅니다. 둘째, 평가 방식에 관한 발견입니다. ‘정확성(Accuracy)‘이나 ‘용어 적절성(Terminology Accuracy)‘처럼 명확한 언어적 근거가 있는 평가 기준에서는 GPT-4o 등의 평가자 모델을 이용한 자동 평가가 인간 평가와 높은 상관관계를 보였습니다. 이는 전문가 리소스가 부족한 상황에서 자동 평가가 1차 스크리닝 도구로 유용함을 시사합니다. 반면, ‘구조적 일관성(Structural Consistency)‘이나 ‘문장 적절성(Wording Appropriateness)‘과 같이 다소 주관적이거나 문서 전체의 논리적 흐름을 판단해야 하는 항목에서는 자동 평가의 신뢰도가 낮았습니다. 이는 향후 법률 AI 평가 체계 개선의 주요 과제입니다.

실험 결과, Gemini 2.5 Pro가 전반적으로 강력한 성능을 보였으며, 특히 법률 개정 설명(AmendExp)의 정확성과 법령 기반 수정(StatRev)의 지시 따르기에서 두각을 나타냈습니다. GPT-5는 정보의 포괄성(Coverage)에서 강점을 보였으나 관련성(Relevance) 판단에서 약점을 노출시켰습니다. 이러한 결과는 법률 업무에 LLM을 적용할 때, 작업의 유형과 요구되는 세부 능력에 따라 모델 선정이 달라져야 함을 시사합니다.

댓글 및 학술 토론

Loading comments...

의견 남기기