평탄한 최소값 탐색으로 LoRA의 일반화 능력 높이기

초록

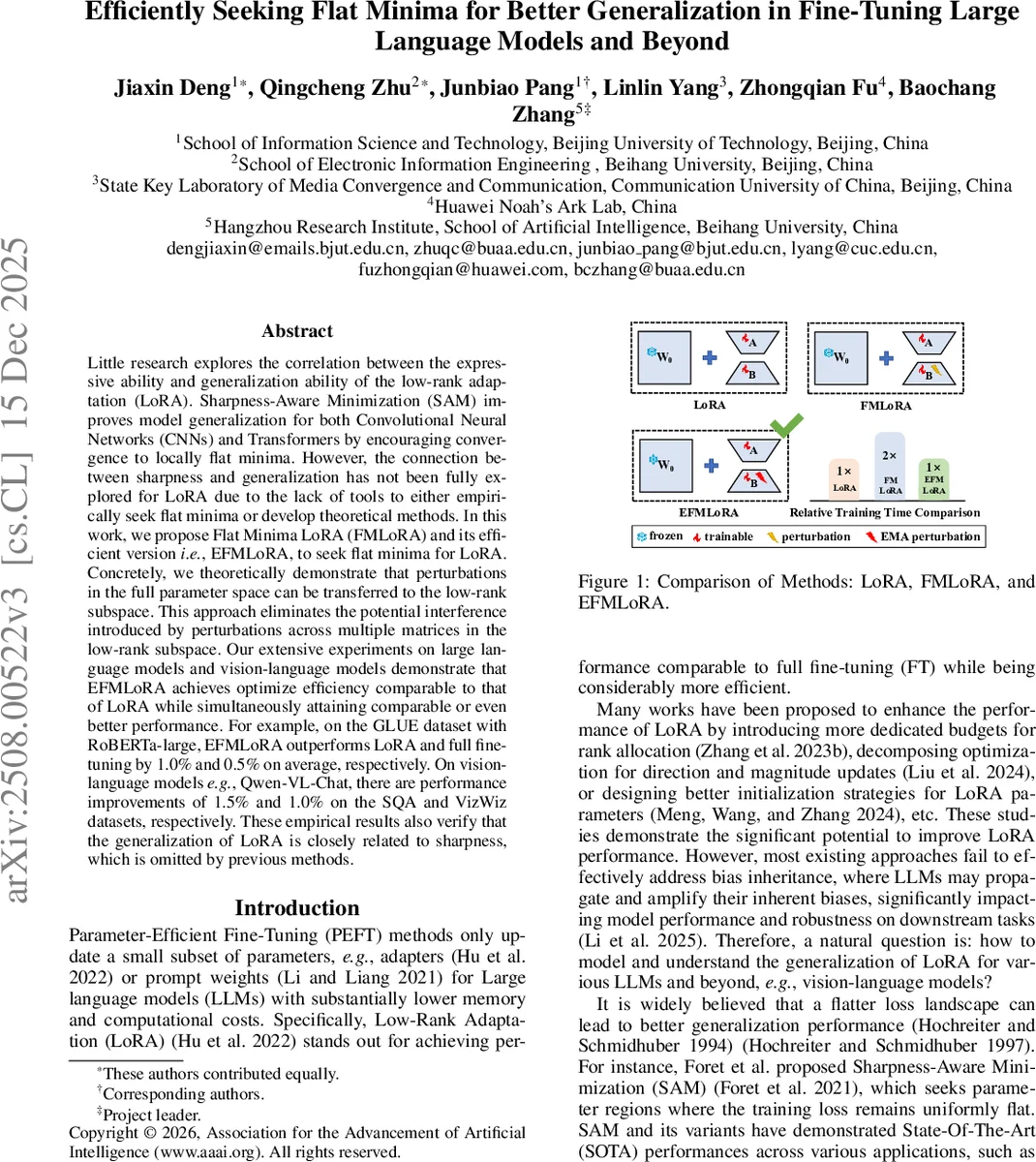

LoRA 미세 조정의 일반화 성능과 손실 함수의 평탄도(sharpness) 간 관계를 탐구한 연구입니다. 전체 매개변수 공간의 변화를 저랭크 부분 공간으로 변환하는 이론적 기법을 바탕으로, 평탄한 최소값을 찾는 FMLoRA와 그 효율적 버전인 EFMLoRA를 제안합니다. 다양한 언어 및 비전-언어 모델 실험에서 기존 LoRA나 전체 미세 조정과 유사하거나 더 나은 성능을 유지하면서 동등한 최적화 효율을 달성함을 보여주었습니다.

상세 분석

본 논문은 파라미터 효율적 미세 조정(PEFT) 기법인 LoRA의 일반화 성능을 개선하기 위한 근본적인 접근법을 제시합니다. 기존 연구가 LoRA의 구조나 초기화 전략을 개선하는 데 집중했다면, 이 연구는 최적화 과정 자체, 즉 ‘손실 함수의 평탄도(sharpness)‘에 주목합니다. 널리 알려진 Sharpness-Aware Minimization(SAM)은 평탄한 최소값으로의 수렴을 유도해 일반화를 향상시키지만, 이를 LoRA에 직접 적용할 경우 두 가지 근본적 문제가 발생합니다. 첫째, LoRA의 두 저랭크 행렬(A, B)에 각각 독립적인 perturbation을 가하면, 전체 파라미터 공간에서의 최대 손실 변화와 정렬되지 않아 SAM의 본래 목적과 일치하지 않을 수 있습니다. 둘째, SAM은 한 번의 업데이트에 두 번의 그래디언트 계산을 필요로 하여 계산 비용이 약 두 배로 증가합니다.

이에 저자들은 ‘FMLoRA’를 제안합니다. 핵심 아이디어는 전체 가중치 행렬(W) 공간에서 정의된 SAM의 perturbation을, LoRA가 업데이트하는 단일 저랭크 부분 공간(논문에서는 B 행렬)으로 ‘정확히 변환(transfer)‘하는 것입니다. 이를 위해 전체 가중치에 대한 그래디언트(∇L_W)를 LoRA의 A, B에 대한 그래디언트(∇L_A, ∇L_B)와 의사역행렬(pseudo-inverse)을 이용해 근사하는 수학적 프레임워크를 제시합니다(Eq. 10-12). 이를 통해 전체 공간에서 계산된 최적 perturbation(E_W)을 B 행렬의 perturbation(E_B)으로 변환할 수 있습니다(Eq. 15). 이 변환은 두 저랭크 행렬에 대한 perturbation의 간섭 문제를 해결하고, SAM의 이론적 목표와 일관된 최적화를 가능하게 합니다.

더 나아가, 계산 효율성을 위해 ‘EFMLoRA’를 제안합니다. FMLoRA도 SAM과 마찬가지로 두 번의 그래디언트 계산이 필요합니다. EFMLoRA는 지수 이동 평균(EMA)을 활용해 이전 단계의 perturbation 정보를 재사용함으로써, 실질적으로 한 번의 그래디언트 계산만으로도 유사한 효과를 얻습니다(Figure 2). 이는 LoRA의 경량성과 효율성을 거의 그대로 유지하면서 평탄도 최적화를 가능하게 하는 핵심 기여점입니다.

실험 결과는 이론적 주장을 뒷받침합니다. RoBERTa-large를 이용한 GLUE 벤치마크에서 EFMLoRA는 평균적으로 LoRA보다 1.0%, 전체 미세 조정보다 0.5% 높은 성능을 보였습니다. 특히 비전-언어 모델인 Qwen-VL-Chat에서도 SQA, VizWiz 데이터셋에서 각각 1.5%, 1.0%의 성능 향상을 확인하였습니다. 이는 단순한 성능 개선을 넘어, LoRA의 일반화 능력이 최적화된 매개변수의 평탄도와 밀접한 관련이 있음을 경험적으로 증명한 의미 있는 결과입니다. 요약하면, 이 연구는 PEFT 분야에 ‘최적화 품질(평탄도)‘이라는 새로운 분석 차원을 열었으며, 효율성과 성능을 동시에 잡은 실용적인 방법론을 제시했다는 점에서 높은 가치를 가집니다.

댓글 및 학술 토론

Loading comments...

의견 남기기