그래프 메타네트워크를 통한 메타 프루닝: 네트워크 가중치 가지치기를 위한 범용 메타 학습 프레임워크

초록

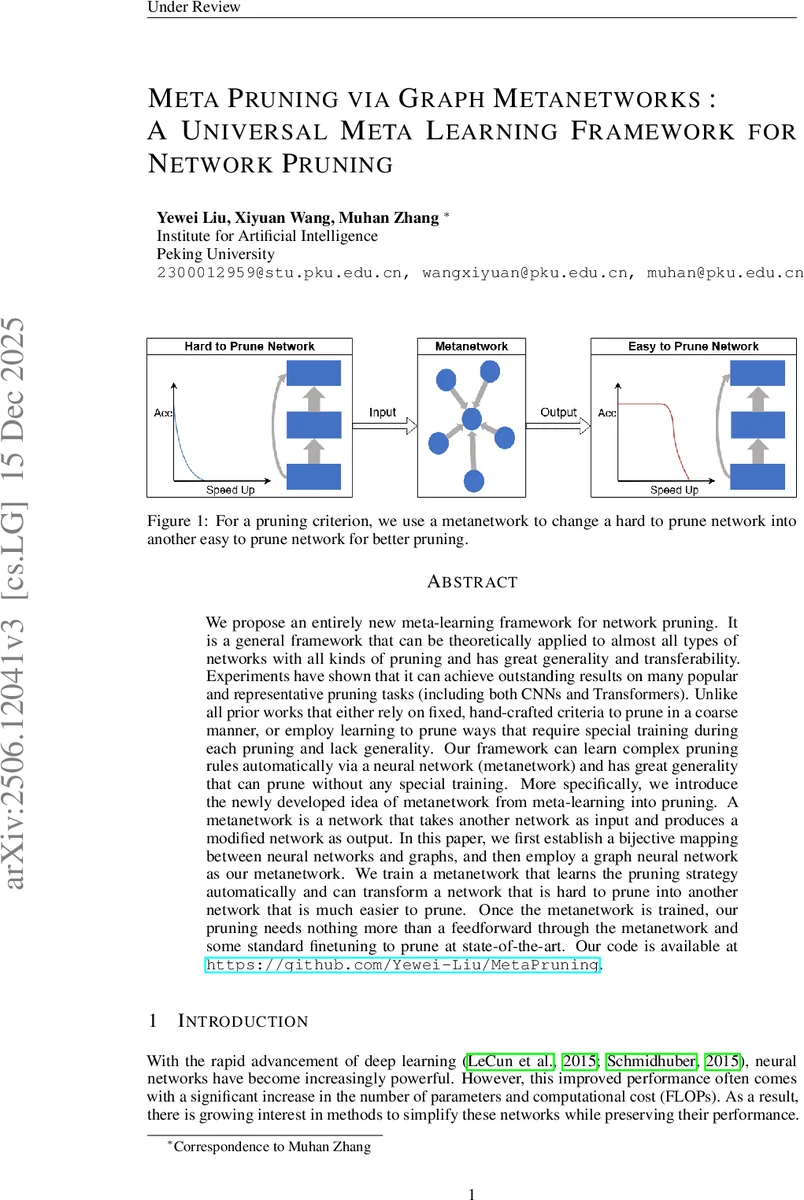

본 연구는 네트워크 가지치기를 위한 완전히 새로운 메타 학습 프레임워크를 제안합니다. 그래프 뉴럴 네트워크(GNN)를 ‘메타네트워크’로 활용하여, 기존 네트워크를 입력받아 가지치기하기 쉬운 형태로 변환하는 규칙을 자동 학습합니다. 이 방법은 CNN과 Transformer를 포함한 다양한 네트워크 아키텍처와 가지치기 방식에 적용 가능하며, 일단 학습된 메타네트워크는 추가 특별 학습 없이도 효율적인 가지치기를 수행할 수 있습니다.

상세 분석

본 논문이 제안하는 ‘메타 프루닝’ 프레임워크의 기술적 핵심은 두 가지로 요약됩니다: 네트워크의 그래프 표현과 이를 처리하는 메타네트워크입니다.

첫째, 네트워크를 그래프로의 정확한 변환(Bijective Mapping)이 이루어집니다. 네트워크의 각 뉴런(또는 채널)은 그래프의 노드로, 뉴런 간의 연결(완전 연결, 합성곱, 잔차 연결 등)은 엣지로 매핑됩니다. 노드 피처는 해당 뉴런과 연관된 가중치, 바이어스, 배치 정규화 통계 등을 포함하며, 엣지 피처는 연결 가중치(예: 합성곱 커널)를 포함합니다. 이 변환은 네트워크의 구조적, 수치적 정보를 보존하면서 GNN이 처리할 수 있는 표준화된 형식을 제공합니다.

둘째, 이 그래프를 처리하는 메타네트워크로 GNN(Message Passing Neural Network, PNA 아키텍처)을 채택합니다. 메타네트워크는 입력 그래프의 노드/엣지 피처를 인코딩한 후, 여러 메시지 패싱 레이어를 거쳐 네트워크의 ‘변환 규칙’을 학습합니다. 최종 출력은 원본 피처에 예측된 델타(변화량)를 소규모 계수(예: 0.01)로 더하는 잔차 연결 방식으로 생성됩니다. 이는 메타네트워크가 네트워크를 완전히 재구성하는 것이 아니라, 가지치기에 유리한 방향으로 미세 조정하도록 유도합니다.

학습(메타-트레이닝) 목표는 정확도 손실과 ‘稀疏性(Sparsity) 손실’의 균형입니다. 정확도 손실은 변환된 네트워크의 성능을 유지하도록 하고, 稀疏性 손실은 네트워크를 가지치기하기 쉬운 형태(예: 그룹 L2 노름 기준으로 중요도 점수가 낮은 구성 요소가 많아지도록)로 만듭니다. 이 손실은 선택한 가지치기 기준(정규화 기반)과 직접적으로 연관되어 있습니다.

본 방법론의 가장 큰 강점은 ‘일반성’입니다. 특정 가지치기 기준(예: L1 Norm, Group Norm)에 대해 메타네트워크를 한 번 학습시키면, 해당 기준으로 다양한 네트워크를 추가 재학습 없이 변환 및 가지치기할 수 있습니다. 이는 기존의 학습 기반 가지치기 방법들이 각 네트워크마다 비용이 큰 학습을 요구했던 점과 대비됩니다. 또한 그래프 표현을 통해 이론적으로 모든 네트워크 아키텍처(CNN, Transformer, RNN 등)와 가지치기 유형(구조적, 비구조적, N:M 스파시티)에 적용 가능한 범용 프레임워크를 제시했습니다.

댓글 및 학술 토론

Loading comments...

의견 남기기