진화하는 데이터 스트림을 위한 인컨텍스트 학습과 탭형 파운데이션 모델

초록

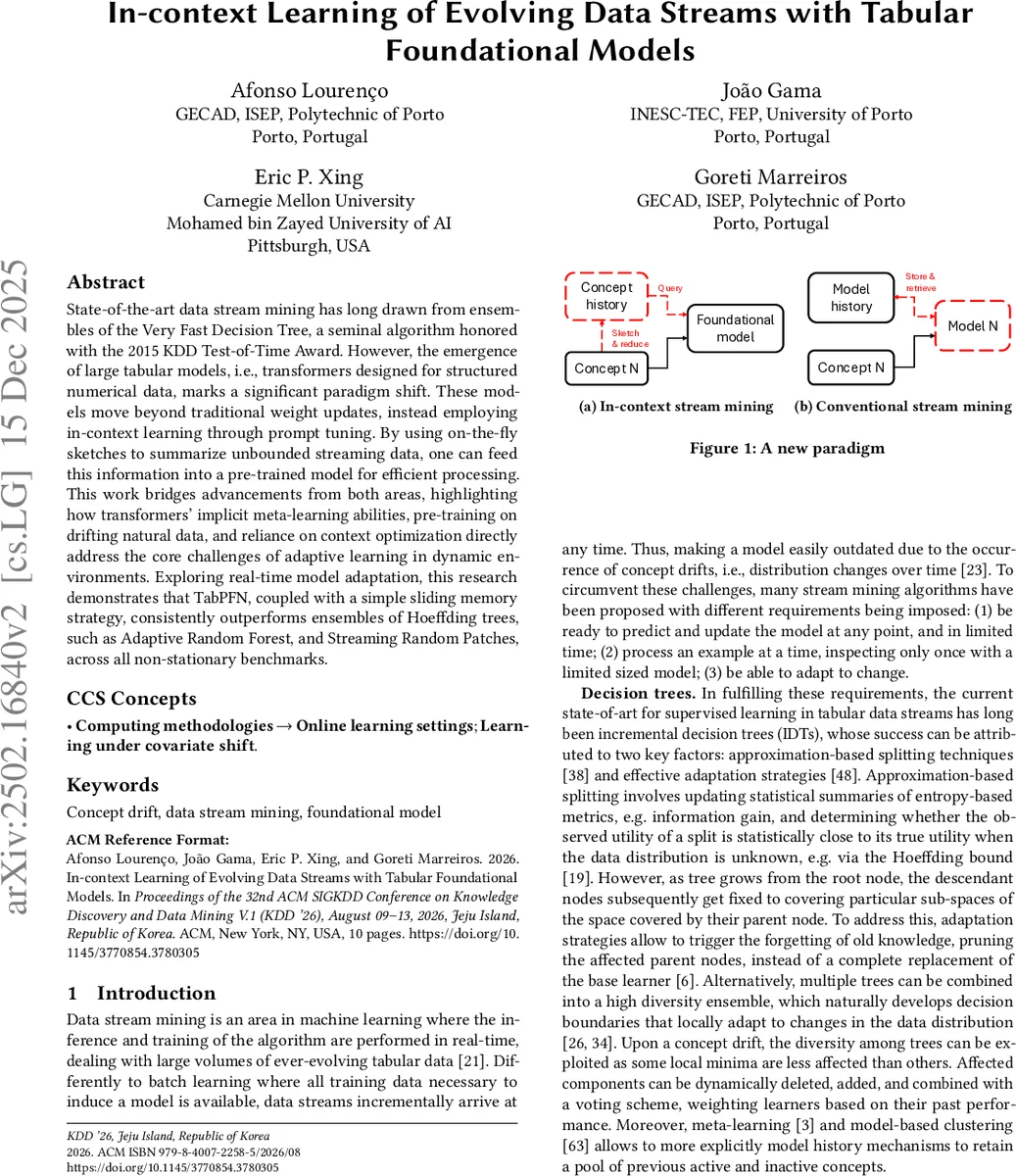

본 논문은 대규모 탭형 트랜스포머인 TabPFN을 스트림 환경에 적용하기 위해 슬라이딩 메모리 기반의 온‑더‑플라이 스케치 기법을 도입한다. 프리트레인된 파운데이션 모델의 인컨텍스트 학습 능력을 활용해 파라미터 업데이트 없이 개념 드리프트에 적응하며, 기존의 Hoeffding 트리 기반 앙상블(Adaptive Random Forest, Streaming Random Patches)보다 일관되게 높은 정확도를 달성한다.

상세 분석

이 연구는 데이터 스트림 마이닝 분야에서 오랫동안 지배적인 Very Fast Decision Tree(VFDT)와 그 앙상블 기법을 근본적으로 재구성한다. 핵심 아이디어는 사전 학습된 대규모 탭형 파운데이션 모델(LTM), 특히 12‑layer Transformer 기반 TabPFN을 파라미터를 고정한 채 인컨텍스트 학습(in‑context learning, ICL)으로 활용하는 것이다. 이를 위해 저자들은 두 단계의 설계를 제안한다. 첫 번째는 무한히 들어오는 스트림 데이터를 요약하는 ‘스케치’ 메커니즘이다. 여기서는 FIFO 기반의 이중 메모리(짧은‑길이 버퍼와 긴‑길이 버퍼)를 사용해 클래스 간 균형을 유지하고, 각 버퍼는 샘플의 통계적 대표성을 보존하도록 설계된다. 두 번째는 이러한 스케치를 TabPFN의 입력 토큰 시퀀스로 변환해 모델에 전달하는 과정이다. 모델 자체는 사전 학습 단계에서 다양한 합성 데이터셋(18000개의 512‑샘플 배치)으로 메타‑피처와 인과 관계를 학습했으며, 이는 자연 데이터 스트림에서 나타나는 ‘버스트성’, ‘컨텍스트 의존적 개념 변화’, ‘불균형 클래스 분포’와 유사한 분포적 특성을 내포한다.

논문은 또한 메자‑옵티마이제이션(mesa‑optimization) 가설을 통해 ICL이 단순히 메모리 검색이 아니라 내부적으로 새로운 알고리즘을 즉석에서 구성한다는 점을 이론적으로 뒷받침한다. 즉, Transformer의 self‑attention 구조가 입력 컨텍스트를 기반으로 잠재적 학습자를 생성하고, 이를 통해 선형 함수, 희소 선형 함수, 2‑layer 신경망, 심지어 의사결정 트리와 같은 복합 함수들을 암묵적으로 구현한다는 것이다. 이러한 메커니즘은 기존 스트림 학습이 요구하는 ‘모델 파라미터 업데이트’와는 전혀 다른 차원의 적응성을 제공한다.

실험에서는 7개의 대표적인 개념 드리프트 벤치마크(SEA, Rotating Hyperplane, LED, Hyperplane, Random RBF 등)와 다양한 드리프트 유형(점진적, 급격, 반복)에서 TabPFN+스케치가 Adaptive Random Forest와 Streaming Random Patches를 모두 앞선다. 특히 메모리 크기를 64~256 샘플 수준으로 제한했음에도 불구하고 정확도 손실이 미미했으며, 처리 지연(latency) 역시 실시간 요구사항을 만족한다. 이는 스케치가 충분히 풍부한 메타‑정보를 제공하면서도 계산 복잡도는 O(·) 수준으로 유지된 결과이다.

결과적으로 이 논문은 (1) 파라미터‑프리 인컨텍스트 학습이 스트림 환경에서 실용적임을, (2) 사전 학습된 탭형 파운데이션 모델이 자연스러운 데이터 드리프트에 내재된 메타‑특성을 활용해 빠른 적응을 가능케 함을, (3) 온‑디맨드 스케치와 이중 메모리 전략이 정보 손실을 최소화하면서도 메모리·연산 비용을 제어한다는 세 가지 핵심 기여를 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기