비디오 확산 모델을 활용한 시공간 데이터 증강

초록

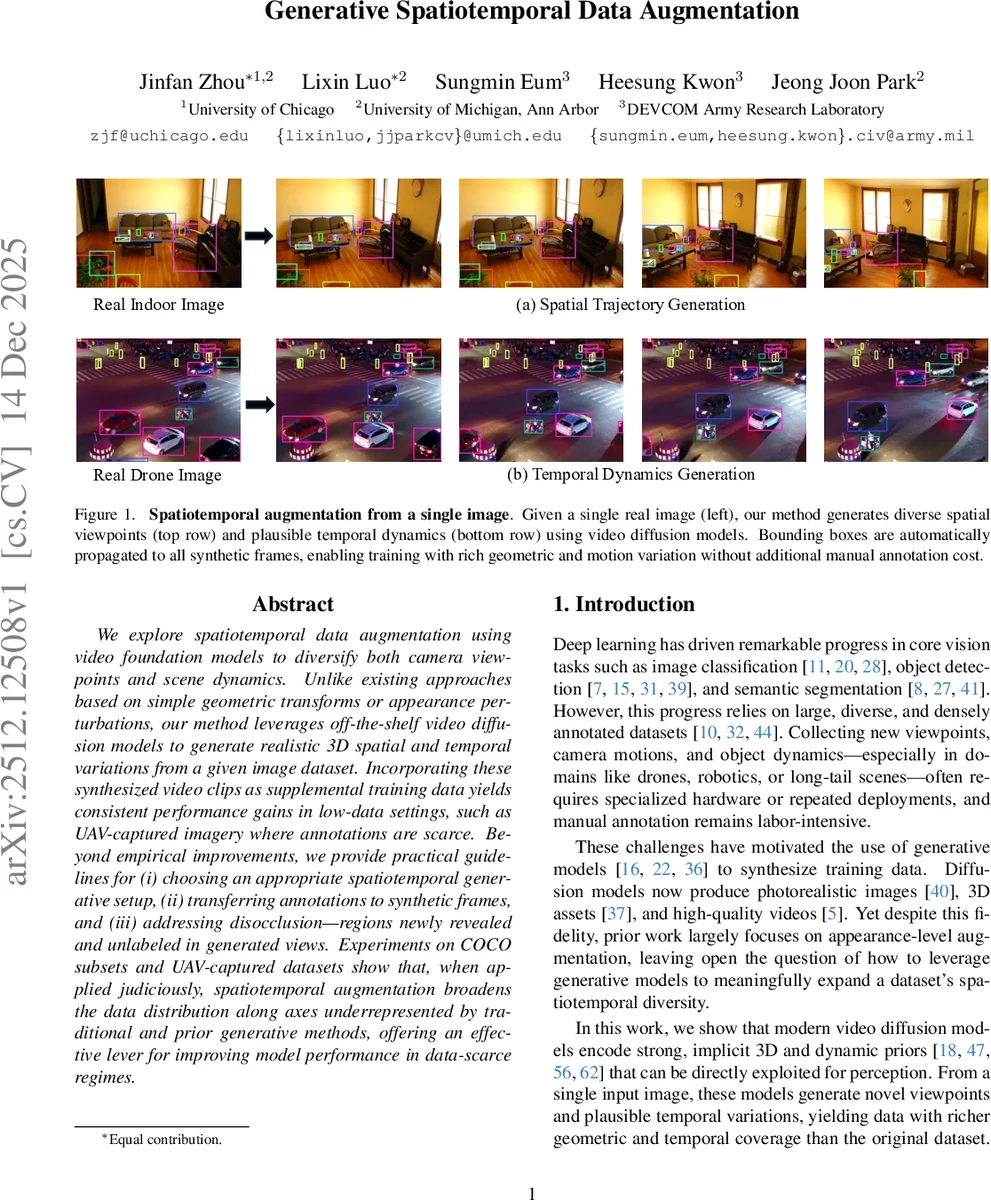

본 논문은 기존 이미지 기반 증강이 다루지 못한 카메라 시점 변화와 동적 장면 변화를 비디오 확산 모델을 이용해 자동 생성하고, SAM 2와 같은 영상 분할 모델로 바운딩 박스를 전이시켜 객체 검출 성능을 향상시키는 방법을 제시한다. 저데이터 환경, 특히 UAV 영상에서 +3.8~+5.9 mAP 향상을 입증한다.

상세 분석

이 연구는 최신 비디오 확산 모델이 내재한 3D 구조와 시간적 일관성이라는 두 가지 강력한 사전 지식을 활용한다는 점에서 의미가 크다. 기존의 기하학적 변환이나 색상 교란 기반 증강은 이미지 수준에서만 변화를 주어, 실제 현장에서 발생하는 카메라 위치·각도 변화나 물체 움직임을 충분히 모사하지 못한다. 반면, 논문에서는 이미지‑투‑비디오 확산 모델 G에 초기 이미지 I₀와 카메라 궤적 C(또는 시간 제어 신호 τ)를 입력해 다중 시점·다중 프레임 비디오를 생성한다. 이렇게 생성된 프레임은 시간적으로 연속적이므로, SAM 2와 같은 비디오 세그멘테이션 모델을 이용해 초기 바운딩 박스 B₀를 추적·분할함으로써 모든 합성 프레임에 정확한 박스를 자동 전이한다.

핵심 기술적 기여는 세 가지로 요약된다. 첫째, “오프‑더‑쉘프” 비디오 확산 모델을 그대로 활용해 시공간 증강 파이프라인을 구축함으로써 별도의 3D 재구성이나 물리 기반 시뮬레이션 없이도 현실적인 시점 변화를 얻는다. 둘째, 자동 주석 전이 파이프라인을 설계해, 추적 기반 마스크에서 바운딩 박스로 변환하고, 필요 시 디스오클루전 영역을 마스크하거나 의사 라벨링하는 과정을 자동화한다. 셋째, 정량적 커버리지‑품질 트레이드오프를 정밀·재현율(Recall)과 KID(Kernel Inception Distance)로 측정하고, 1:1 실·합성 비율이 현실감과 다양성 사이의 최적점을 제공한다는 실험적 근거를 제시한다.

실험에서는 COCO 서브셋, VisDrone, Semantic Drone 등 세 가지 데이터셋에 대해 기존 이미지‑기반 증강(Instagen, ControlAug)과 비교했을 때, 시공간 증강만으로도 이미지 재현율을 98.9 %까지 끌어올리고, 객체 재현율도 88.5 %에 근접한다. 특히 저데이터 설정에서 COCO‑sub에서 +3.8 mAP, VisDrone에서 +2.8 mAP, Semantic Drone에서 +5.9 mAP 향상을 기록했다. 또한, 기존 증강과 결합했을 때 시공간 증강이 보완적인 효과를 내어 전체 성능을 더욱 끌어올린다.

디스오클루전 처리에 관한 분석은 흥미롭다. 트래킹 기반 마스크와 의사 라벨링을 적용했을 때 평균 mAP 상승폭이 0.5~1.0 포인트에 불과함을 확인하고, 실제 적용에서는 복잡성을 감수하지 않아도 된다는 실용적 권고를 제공한다. 이는 시공간 증강이 “대부분의 경우 충분히 유용”하다는 결론을 뒷받침한다.

전반적으로 이 논문은 비디오 확산 모델을 데이터 증강에 적용하는 새로운 패러다임을 제시하고, 자동 주석 전이와 디스오클루전 처리에 대한 실용적인 가이드라인을 제공함으로써 UAV와 같은 데이터가 제한된 도메인에서 바로 활용 가능한 솔루션을 제시한다는 점에서 학술적·산업적 가치가 높다.

댓글 및 학술 토론

Loading comments...

의견 남기기