V Warper: 값 변형을 통한 외관 일관성 비디오 확산 모델 개인화

초록

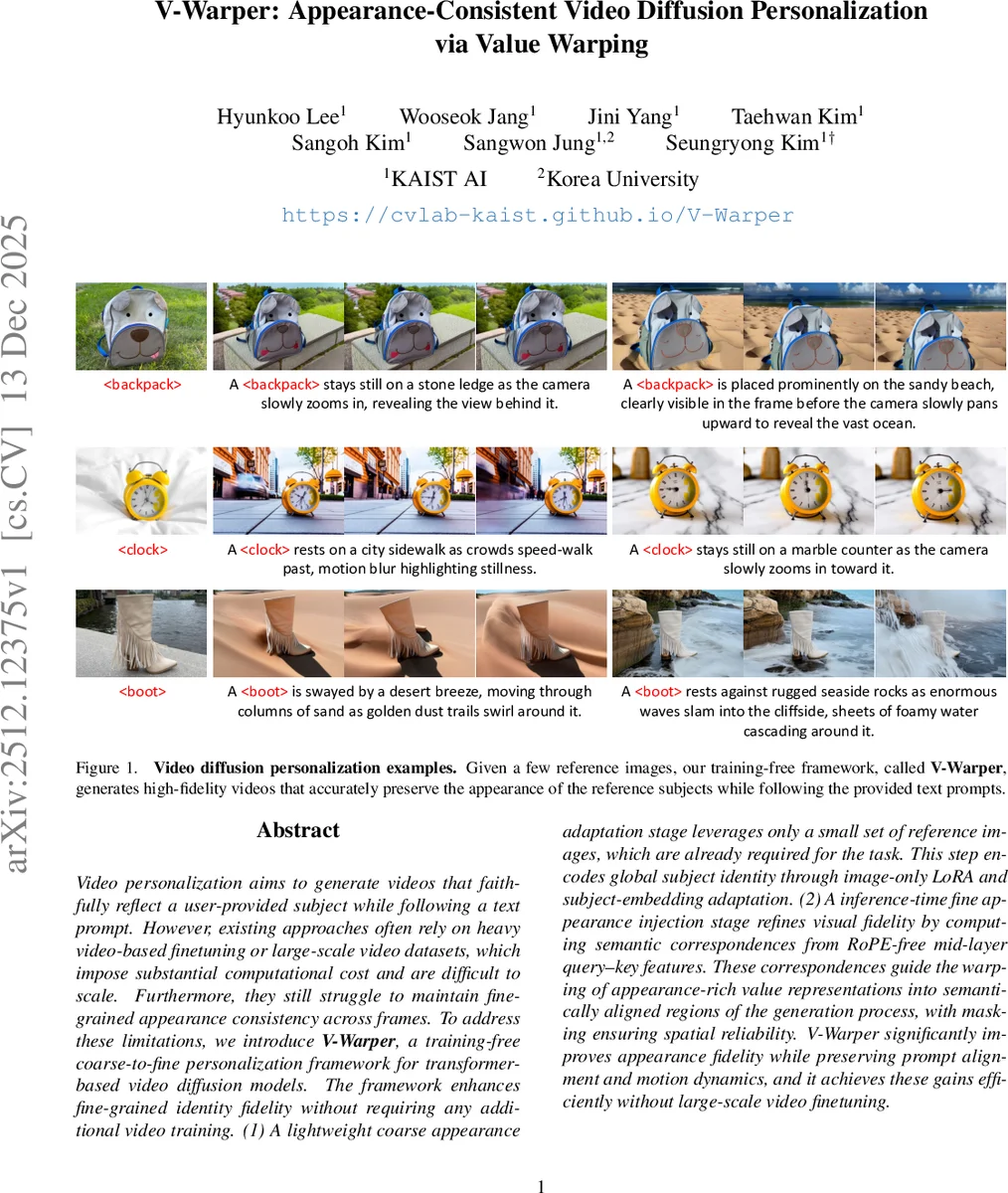

V-Warper는 추가적인 비디오 학습 없이도 사용자가 제공한 대상의 세밀한 외관을 비디오 생성에 일관되게 반영하는 새로운 프레임워크입니다. 소량의 참조 이미지로 전역적 특징을 학습하는 ‘Coarse Appearance Adaptation’과 생성 과정에서 의미론적 대응 관계를 계산해 세부 외관을 주입하는 ‘Fine Appearance Injection’의 2단계 접근법을 통해, 높은 정체성 충실도와 자연스러운 모션을 동시에 달성합니다.

상세 분석

V-Warper의 기술적 혁신은 크게 두 가지 축에서 분석됩니다. 첫째, ‘Coarse Appearance Adaptation’ 단계에서의 효율적 설계입니다. 기존 비디오 개인화 방법이 대규모 비디오 데이터와 비용이 많이 드는 파인튜닝에 의존하는 반면, V-Warper는 단지 몇 장의 참조 이미지만을 사용하여 LoRA 모듈과 학습 가능한 주체 토큰을 학습합니다. 특히, 모델의 사전 학습된 시간적 동작을 방해하지 않기 위해 Query(Q) 프로젝션을 업데이트하지 않고 Key(K), Value(V), Output(O) 프로젝션에만 LoRA를 적용하는 전략을 채택했습니다. 이는 Query가 시간적 구조를 많이 인코딩한다는 관찰에 기반하며, 이를 통해 텍스트 프롬프트에 맞는 자연스러운 움직임을 보존하면서도 전역적인 주체 정체성을 효과적으로 학습할 수 있습니다.

둘째, ‘Fine Appearance Injection’ 단계의 핵심인 의미론적 대응 관계(Semantic Correspondence) 계산과 값 변형(Value Warping) 기법입니다. 이 단계의 성공은 비디오 DiT(확산 변환기) 내부 표현에 대한 체계적인 분석에서 비롯됩니다. 저자들은 중간층 특징, Query-Key 특징, 그리고 RoPE(Rotary Position Embedding)가 제거된 Query-Key 특징 등 다양한 내부 표현을 평가하여, RoPE가 제거된 중간층(특히 12층)의 Query-Key 특징이 가장 강력한 의미론적 정렬 능력을 보인다는 것을 발견했습니다. RoPE는 위치 의존적 편향을 강하게 부여하여 동일 위치의 상호작용을 촉진하므로, 이를 제거함으로써 위치에 독립적인 의미론적 유사성을 포착할 수 있게 된 것입니다. 이 계산된 대응 관계를 바탕으로, 참조 이미지에서 추출된 풍부한 외관 정보(Value 특징)를 생성 과정의 의미론적으로 맞는 영역으로 정확하게 ‘변형(Warping)‘하여 주입합니다. 마스킹 기법을 함께 사용하여 주체와 관련된 신뢰할 수 있는 영역에만 주입이 제한되도록 함으로써, 세밀한 질감과 색상 정보를 왜곡 없이 전달할 수 있습니다. 이 전체 과정은 순전히 추론 시간에 이루어지며, 추가 학습이 필요 없는 ‘Training-Free’ 방식의 장점을 극대화합니다.

댓글 및 학술 토론

Loading comments...

의견 남기기