속성 전문가 분배로 미세한 시각 차이를 해석하는 제로샷 학습

초록

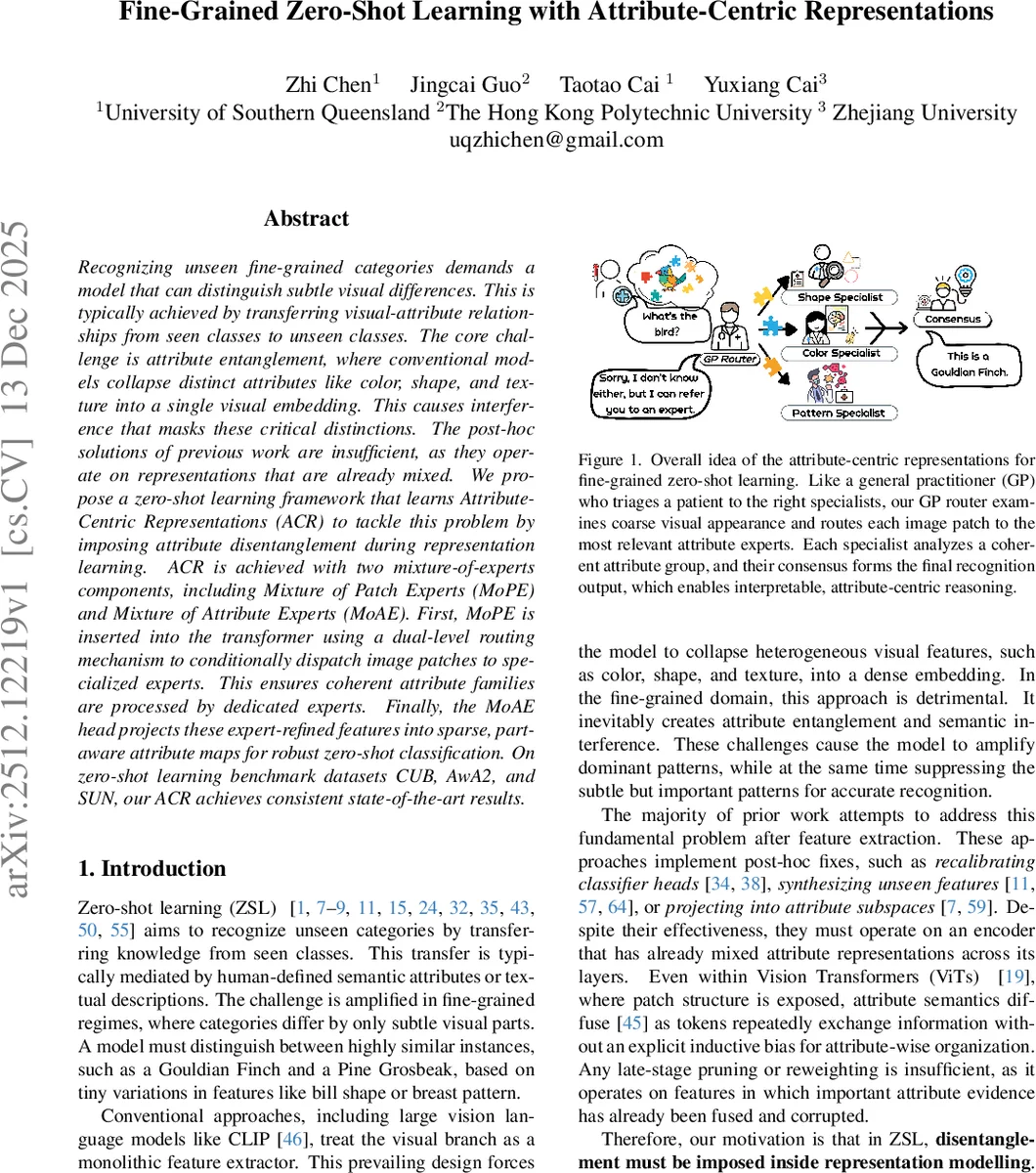

미세한 범주의 제로샷 학습에서 색상, 형태, 질감 등 다양한 속성이 하나의 표현에 뒤섞이는 ‘속성 얽힘’ 문제를 해결하기 위한 새로운 프레임워크를 제안한다. 트랜스포머 내에 패치 전문가 혼합(MoPE)과 속성 전문가 혼합(MoAE)이라는 두 가지 계층을 도입하여, 이미지 패치를 관련 속성 전문가에게 조건부로 할당하고 희소한 속성 지도로 투영함으로써 해석 가능하면서도 최고 수준의 인식 성능을 달성했다.

상세 분석

본 논문의 핵심 기여는 제로샷 학습(ZSL)의 근본적인 난제인 ‘속성 얽힘’을 표현 학습 단계에서 해결하는 새로운 패러다임을 제시한 점이다. 기존 방법론이 단일한 시각 임베딩을 생성한 후 사후 처리로 속성을 분리하려 했던 접근과 달리, ACR은 네트워크의 정보 흐름 자체를 속성 중심으로 재구성한다. 이를 실현한 기술적 핵심은 두 가지 혼합 전문가(MoE) 구성요소다. 첫 번째는 MoPE(Mixture of Patch Experts)이다. 이는 트랜스포머 블록 내에 삽입되는 경량 어댑터로, 이중 수준 라우팅 메커니즘을 갖춘다. (1) 인스턴스 수준 라우터는 CLS 토큰을 보고 전체 이미지와 관련된 몇 개의 속성 그룹(예: ‘부리 모양’, ‘가슴 패턴’)을 활성화한다. (2) 패치 수준 라우터는 각 이미지 패치 토큰을 개별적으로 분석하여, 활성화된 전문가 풀 내에서 해당 패치와 가장 관련성 높은 소수의 전문가(Top-K)에게 할당한다. 이 방식은 계산 비용을 크게 늘리지 않으면서(활성 전문가만 실행) 각 패치를 가장 적합한 속성 전문가가 처리하도록 보장한다. 전문가 구현에는 효율성을 위해 LoRA(Low-Rank Adaptation)가 사용되었다. 두 번째는 MoAE(Mixture of Attribute Experts) 헤드이다. 트랜스포머를 통과한 패치별 특징을 속성 공간으로 투영한 후, ‘속성 라우터’를 통해 각 속성 차원이 이미지 내 어떤 공간 위치(패치)에 가장 강하게 반응하는지를 희소한 마스크 형태로 추출한다. 이를 통해 최종 속성 예측은 관련성 높은 지역적 증거에 기반하게 되며, 결과는 해석 가능한 부분 인식 속성 지도로 시각화될 수 있다. 안정적인 전문가 특화 학습을 위해 세 가지 손실 함수가 도입되었다: 전문가 사용 불균형을 완화하는 부하 분산 손실, 서로 다른 네트워크 층 간의 라우팅 결정 일관성을 유도하는 교차 층 일관성 손실, 그리고 학습 초기 전문가 탐색을 촉진하는 다양성 손실. CUB, AwA2, SUN 벤치마크에서의 SOTA 성능은 이 접근법의 유효성을 입증하며, 특히 CLIP과 같은 대규모 사전 학습 모델의 단일 임베딩 한계를 속성 수준 해석 가능성과 함께 극복한 점에서 의미가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기