대화 속 감정의 미세한 차이를 읽어내는 기술 각도 최적화 특징 학습

초록

기존 멀티모달 감정 인식 기술이 공유 정보에만 치중하여 놓쳤던 각 모달리티(텍스트, 오디오, 비주얼)만의 고유한 특징을 효과적으로 보존하면서도, 공유 정보와의 유기적인 보완 관계를 유지할 수 있도록 ‘각도 최적화 특징 학습(AO-FL)’ 프레임워크를 제안합니다.

상세 분석

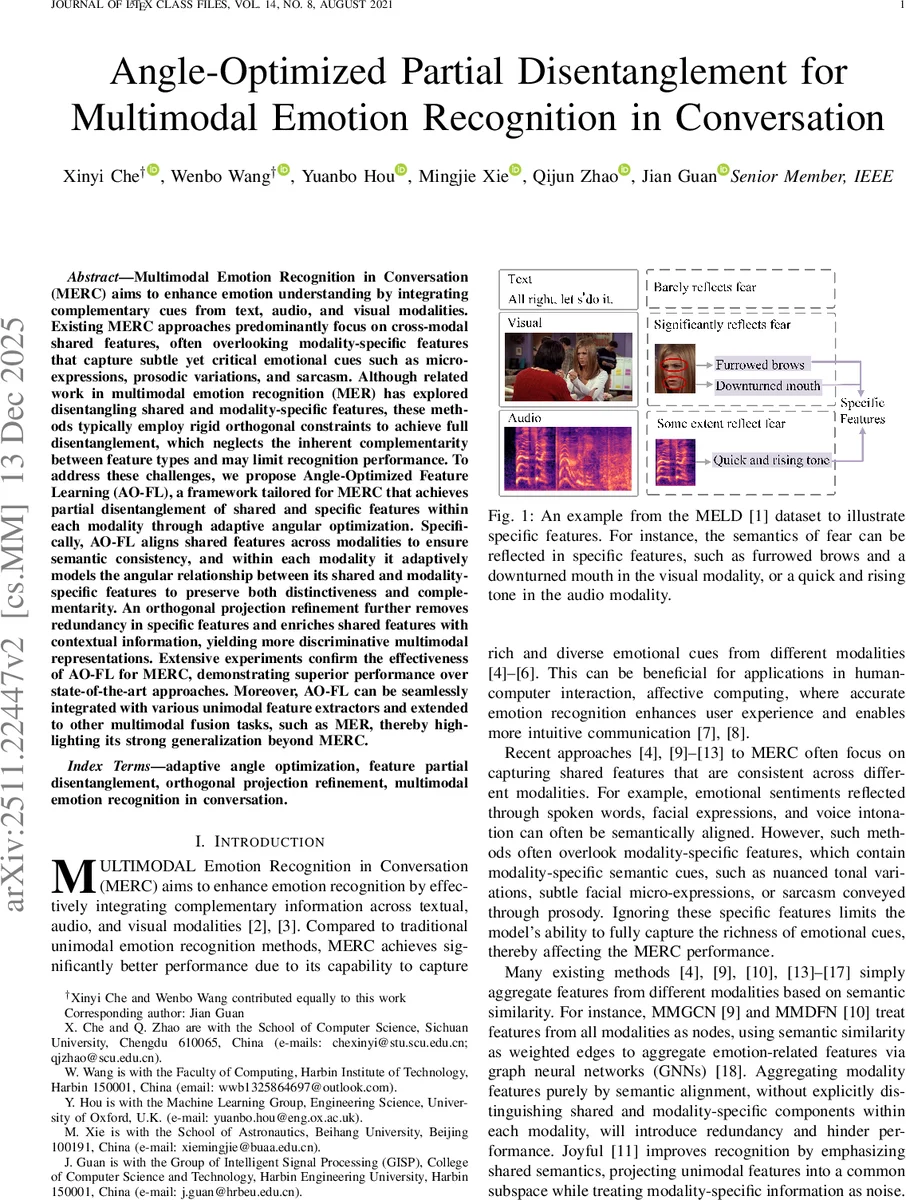

본 논문은 멀티모달 대화 감정 인식(MERC) 분야에서 기존의 특징 분리(Disentanglement) 방식이 가진 근본적인 한계를 날카롭게 지적하며 시작합니다. 기존 연구들은 텍스트, 오디오, 비주얼이라는 서로 다른 모달리티에서 공통적으로 나타나는 ‘공유 특징(Shared features)‘을 추출하는 데 집중해 왔습니다. 하지만 이 과정에서 각 모달리티만이 가진 고유한 정수, 즉 비언어적 맥락인 미세 표정(micro-模expressions), 음성의 억양 변화(prosodic variations), 혹은 텍스트의 반어법(sarcasm)과 같은 ‘모달리티 특화 특징(Modality-specific features)‘이 간과되는 문제가 발생했습니다.

특히 주목할 점은 기존의 ‘완전 분리(Full Disentanglement)’ 전략에 대한 비판입니다. 기존 모델들은 공유 특징과 특화 특징을 완전히 독립적인 것으로 간주하여 두 특징 사이의 관계를 직교(Orthogonal) 제약 조건으로 강제했습니다. 이는 수학적으로는 깔끔한 분리를 제공할지 모르나, 실제 감정 데이터에서는 공유 정보와 특화 정보가 서로 보완적인 관계(Complementarity)를 맺고 있다는 점을 무시하는 결과를 초래합니다. 즉, 너무 엄격한 분리는 오히려 정보의 손실을 야기하고 인식 성능을 저하시키는 요인이 됩니다.

이를 해결하기 위해 저자들이 제안한 AO-FL(Angle-Optimized Feature Learning)의 핵심은 ‘부분적 분리(Partial Disentanglement)‘와 ‘적응형 각도 최적화(Adaptive Angular Optimization)‘입니다. AO-FL은 두 특징을 완전히 수직으로 떼어놓는 대신, 그 사이의 각도를 학습 가능한 파라미터로 설정하여 최적의 관계를 찾아냅니다. 이를 통해 특징 간의 독립성(Distinctiveness)을 확보함과 동시에, 서로가 서로를 보완할 수 있는 유연한 연결 고리(Complementarity)를 유지합니다. 여기에 더해 ‘직교 투영 정제(Orthogonal Projection Refinement)’ 과정을 도입하여, 특화 특징에서는 중복된 노이즈를 제거하고 공유 특징에는 문맥적 정보를 풍부하게 주입함으로써 더욱 정교하고 변별력 있는 멀티모달 표현을 완성했습니다. 이는 단순한 성능 향상을 넘어, 멀티모달 데이터의 구조적 특성을 반영한 매우 통찰력 있는 접근법이라 평가할 수 있습니다.

멀티모달 대화 감정 인식(MERC)은 인간의 대화 속에 담긴 복잡한 감정을 이해하기 위해 텍스트, 오디오, 비주얼 데이터를 통합적으로 분석하는 고도의 기술입니다. 최근의 연구들은 여러 모달리티에 걸쳐 공통적으로 나타나는 특징을 추출하여 감정 인식의 정확도를 높이려 노력해 왔습니다. 그러나 본 논문은 기존 방식들이 지나치게 ‘공유 특징’에만 매몰되어, 각 모달리티가 가진 고유한 감정적 단서들을 놓치고 있다는 점을 문제로 제기합니다. 예를 들어, 텍스트에는 나타나지 않는 목소리의 떨림이나 얼굴의 미세한 근육 변화, 혹은 문맥상 숨겨진 비꼬는 말투 등은 각 모달리티의 ‘특화된 특징’에 포함되는데, 기존의 엄격한 특징 분리 방식은 이러한 정보들을 공유 정보와 분리하는 과정에서 유실시키거나 왜곡시키는 경향이 있었습니다.

이러한 한계를 극복하기 위해 본 논문은 ‘각도 최적화 특징 학습(Angle-Optimized Feature Learning, AO-FL)‘이라는 혁신적인 프레임워크를 제안합니다. AO-FL의 핵심 아이디어는 공유 특징과 특화 특징을 완전히 분리된 별개의 존재로 보는 것이 아니라, 적절한 ‘각도’를 통해 연결된 상호 보완적 관계로 재정의하는 것입니다.

AO-FL의 작동 원리는 크게 세 단계로 요약할 수 있습니다. 첫째, ‘적응형 각도 최적화(Adaptive Angular Optimization)’ 단계입니다. 연구진은 각 모달리티 내에서 공유 특징과 특화 특징 사이의 각도 관계를 모델링합니다. 이는 두 특징이 서로 다른 정보를 담고 있음을 보장(독립성)하면서도, 동시에 서로의 정보를 보완할 수 있는 적절한 상관관계(보완성)를 유지하도록 유도합니다. 둘째, ‘교차 모달리티 정렬(Cross-modal Alignment)‘입니다. 텍스트, 오디오, 비주얼의 각 모달리티에서 추출된 공유 특징들이 서로 동일한 의미적 맥락을 갖도록 정렬하여, 모달리티 간의 일관성을 확보합니다. 셋붙, ‘직교 투영 정제(Orthogonal Projection Refinement)’ 단계입니다. 이 단계에서는 특화 특징 내의 불필요한 중복 정보를 제거하여 특징의 순도를 높이는 동시에, 공유 특징에는 주변 문맥 정보를 결합하여 더욱 풍부하고 변별력 있는 특징 표현을 생성합니다.

실험 결과, AO-FL은 기존의 최첨단(SOTA) 모델들을 뛰어넘는 압도적인 성능을 보여주었습니다. 특히 이 프레임워크의 진정한 가치는 범용성에 있습니다. AO-FL은 특정 특징 추출기에 종속되지 않으며, 다양한 종류의 단일 모달리티 추출기와 결합하여 사용할 수 있습니다. 또한, 대화뿐만 아니라 일반적인 멀티모달 감정 인식(MER) 작업에도 즉시 적용 가능한 높은 확장성을 입증했습니다. 결론적으로, AO-FL은 멀티모달 데이터의 구조적 특성을 깊이 있게 이해하고, 공유 정보와 고유 정보 사이의 최적의 균형점을 찾아냄으로써 차세대 감정 인식 기술의 새로운 이정표를 제시한 연구라고 할 수 있습니다.

댓글 및 학술 토론

Loading comments...

의견 남기기