대규모 분산 최적화 문제를 위한 확률적 정규화 분할 방법

초록

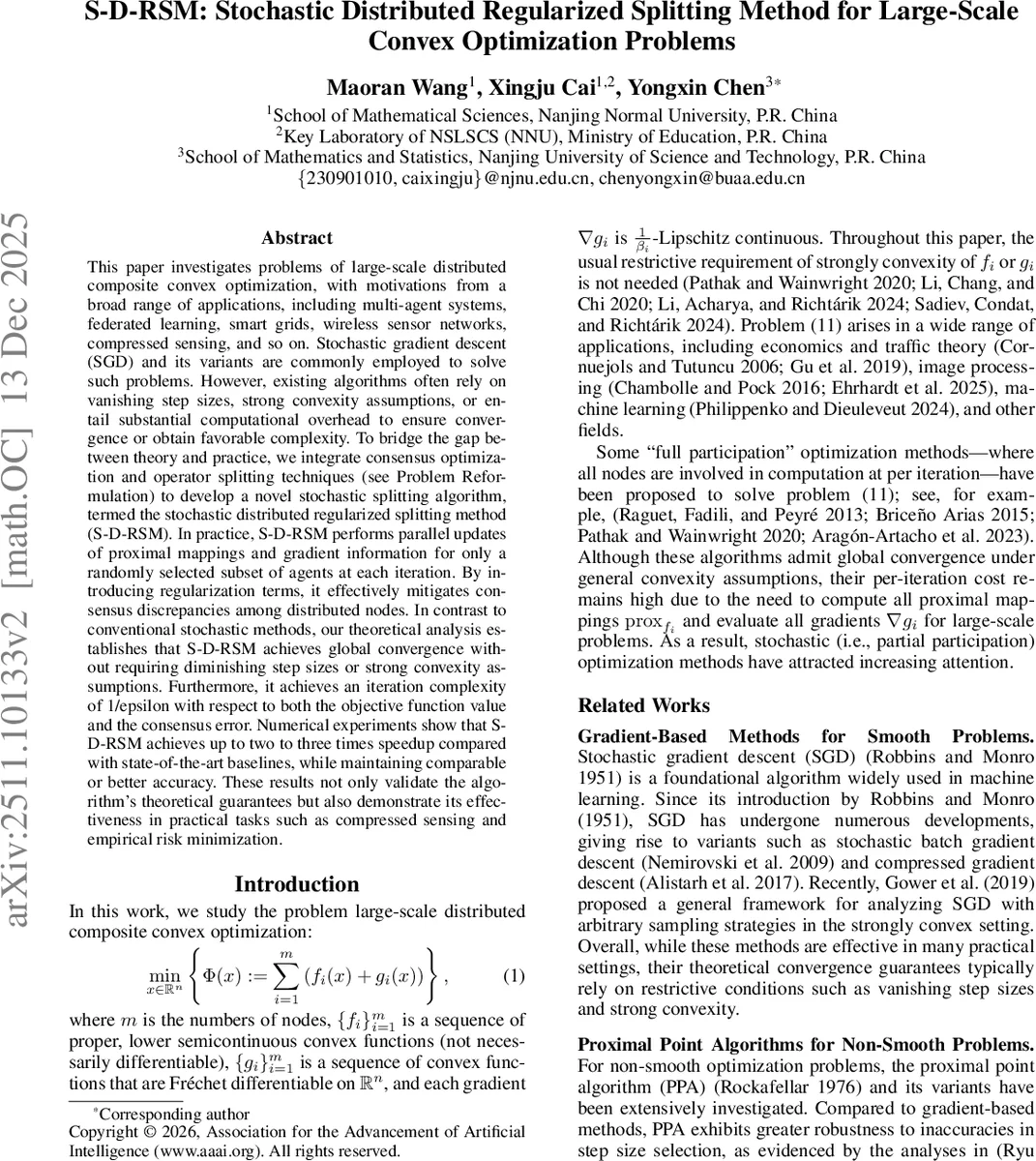

본 논문은 대규모 분산 합성 볼록 최적화 문제를 해결하기 위한 새로운 알고리즘인 S-D-RSM을 제안합니다. 기존 방법들이 사라지는 스텝 사이즈나 강한 볼록성 가정에 의존하는 한계를 극복하며, 각 반복에서 무작위로 선택된 노드만 업데이트하여 계산 효율성을 높입니다. 정규화 항을 도입해 분산 노드 간의 일치 오차를 효과적으로 줄이고, 이론적으로는 상수 스텝 사이즈 하에서도 전역 수렴 및 O(1/ε)의 반복 복잡도를 보장합니다. 압축 센싱 등 실제 문제에서 기존 방법 대비 2-3배의 속도 향상을 달성했습니다.

상세 분석

본 논문이 제안하는 S-D-RSM 알고리즘의 기술적 핵심과 주요 통찰은 다음과 같습니다.

첫째, 알고리즘 설계의 근간은 ‘문제 재구성(Reformulation)‘에 있습니다. 원래의 분산 최적화 문제를 두 가지 방식으로 재구성합니다. Reformulation I은 최적해가 만족해야 하는 연산자 방정식 시스템을 유도하여, 이론적 수렴 분석의 토대를 마련합니다. Reformulation II는 모든 노드의 변수가 동일해야 한다는 제약 조건을 명시적으로 포함시켜, ‘합의 오차(consensus error)‘를 정량화하고 알고리즘의 정확한 정지 기준을 정의하는 데 사용됩니다. 이 두 재구성은 수학적으로 동등하며, 이를 연결하는 보조정리는 알고리즘의 타당성을 보장합니다.

둘째, 알고리즘의 혁신성은 ‘부분 참여(Partial Participation)‘와 ‘정규화(Regularization)‘의 결합에 있습니다. 기존의 연산자 분할 방법(예: S-FDR, S-GFB)은 확률적 그래디언트를 사용하더라도 매 반복마다 모든 노드의 근사 매핑(proximal mapping) 또는 그래디언트 계산을 요구하는 ‘계산 병목’이 있었습니다. S-D-RSM은 매 반복 k에서 무작위로 선택된 노드의 부분집합 S_k에 대해서만 근사 매핑과 그래디언트 계산을 수행하여 계산 부하를 획기적으로 줄입니다. 동시에, 각 노드의 부문제에 α_i (y_i - x) 형태의 정규화 항을 도입합니다. 이 항은 각 노드의 지역 변수 y_i가 중앙 변수 x와 너무 멀어지는 것을 방지하여 합의 오차를 사전에 완화하는 역할을 합니다. 이는 단순한 페널티가 아니라 알고리즘의 수렴성 증명에 필수적인 구조를 제공합니다.

셋째, 이론적 분석에서의 주요 돌파구는 ‘상수 스텝 사이즈 하에서의 전역 수렴’과 ‘O(1/ε) 복잡도’ 달성입니다. 대부분의 확률적 근사 방법은 수렴을 보장하기 위해 스텝 사이즈를 0으로 감소시켜야 하며, 이는 실전에서 성능 저하를 초래합니다. 또한 O(1/ε) 복잡도를 얻기 위해서는 강한 볼록성이나 인터폴레이션 조건과 같은 제한적인 함수 가정이 필요했습니다. S-D-RSM은 이러한 두 가지 제약을 모두 제거했습니다. 저자들은 마팅게일 수렴 정리와 같은 확률론적 도구와 볼록 분석 기법을 결합하여, 상수 스텝 사이즈와 일반적인 볼록성, 리프시츠 연속성 가정만으로도 알고리즘 생성 점열의 거의 확실한 수렴을 증명했습니다. 더 나아가, 목적 함수 값의 격차와 합의 오차 모두에 대해 O(1/K)의 준선형 에르고딕 수렴 속도를 보여, O(1/ε)의 반복 복잡도를 입증했습니다. 이는 동일한 가정 하에서 기존 S-PG나 S-GFB 방법이 달성하지 못한 최선의 결과에 해당합니다.

마지막으로, 알고리즘의 실용적 강점은 ‘이질성에 대한 강건성’에 있습니다. 이론적 보장이 데이터 분포나 노드의 특성에 의존하지 않고 오직 목적 함수의 볼록성에 기반하기 때문에, 노드별 데이터가 비동일 분포를 따르는 실제 페더레이드 학습 환경에서도 수렴성과 복잡도 결과가 유지됩니다. 이는 실험에서도 다양한 비IID 설정에서 안정적인 성능으로 확인되었습니다.

댓글 및 학술 토론

Loading comments...

의견 남기기