뇌파와 fMRI를 활용한 자연스러운 영상 재구성 데이터셋 CineBrain

초록

**

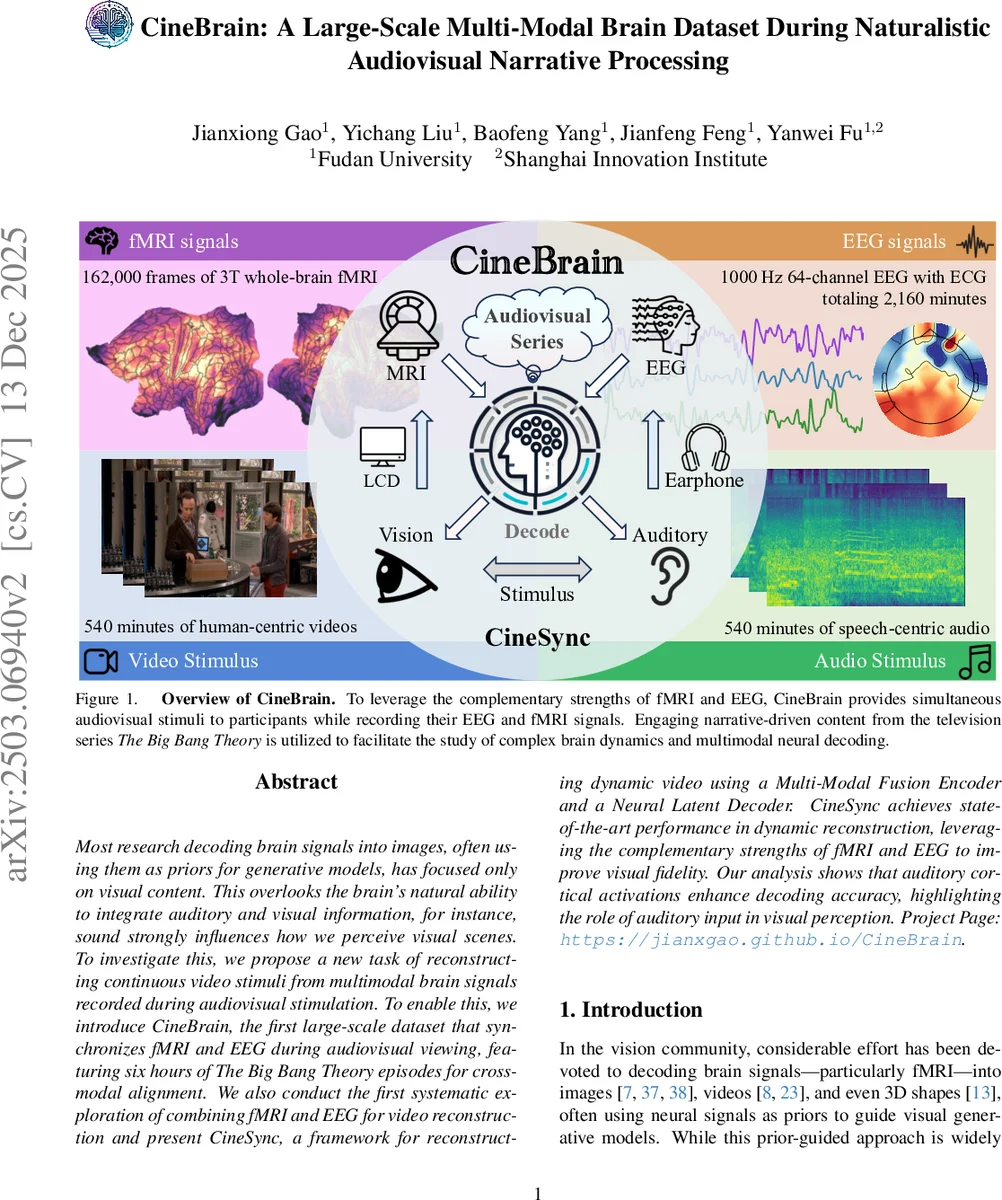

CineBrain은 6시간 분량의 TV 시리즈 “The Big Bang Theory"를 시청하면서 동시 기록한 fMRI와 1000 Hz 64채널 EEG 데이터를 제공한다. 저자들은 이 데이터를 이용해 시청각 정보를 모두 고려한 동영상 재구성 과제를 정의하고, fMRI‑EEG 융합 인코더와 확산 기반 디코더로 구성된 CineSync 프레임워크를 제안한다. 실험 결과, 청각 피질 활성화가 시각 재구성 정확도를 높이며, fMRI와 EEG를 결합했을 때 기존 단일 모달 방법보다 현저히 우수한 성능을 보였다.

**

상세 분석

**

본 논문은 뇌-컴퓨터 인터페이스 분야에서 두 가지 중요한 흐름을 동시에 확장한다. 첫째, 기존 영상 재구성 연구는 주로 시각 전용 자극에 국한돼 있었으며, fMRI 혹은 EEG 중 하나만을 사용해 정적인 이미지 혹은 짧은 동영상을 복원했다. 그러나 인간은 청각과 시각을 동시에 처리하면서 의미를 형성하므로, 청각 정보가 시각 인코딩에 미치는 영향을 무시하는 것은 근본적인 한계다. 저자들은 이러한 문제를 인식하고, 청각과 시각이 동시에 제공되는 자연스러운 스토리텔링 영상(‘The Big Bang Theory’)을 선택해 실험 설계를 진행했다. 이는 뇌의 다감각 통합 메커니즘을 연구할 수 있는 이상적인 환경을 제공한다.

둘째, fMRI와 EEG의 보완적 특성을 활용한 융합 전략을 제시한다. fMRI는 2 mm 수준의 고해상도 공간 정보를 제공하지만, 혈류 반응 지연으로 인해 시간 해상도가 수초 수준에 머문다. 반면 EEG는 1 kHz 샘플링으로 밀리초 단위의 동적 변화를 포착하지만, 전극 배치와 전도 특성 때문에 공간 해상도가 낮다. 논문에서는 두 모달리티를 각각 전용 트랜스포머 인코더로 처리한 뒤, 학습 가능한 프로젝터를 통해 다중 헤드 어텐션 기반 융합을 수행한다. 이 과정에서 시각‑청각 ROI를 별도로 정의하고, BOLD 지연을 보정하기 위해 4 초 시프트를 적용함으로써 시계열 정렬 문제를 최소화했다.

CineSync의 핵심은 ‘멀티모달 퓨전 인코더(Multi‑Modal Fusion Encoder)’와 ‘신경 잠재 디코더(Neural Latent Decoder)’이다. 인코더는 fMRI와 EEG의 특징을 동일 차원으로 매핑하고, 대조 학습(contrastive loss)을 이용해 영상·텍스트 임베딩과 정렬한다. 디코더는 DiT(Transformer 기반 확산 모델)를 변형해, 뇌 특징 벡터와 랜덤 노이즈를 결합해 연속적인 비디오 프레임을 생성한다. 이렇게 하면 단순히 정적 이미지 복원에 머무르지 않고, 시간 흐름을 유지한 동영상 생성이 가능해진다.

실험에서는 (1) fMRI 단독, (2) EEG 단독, (3) fMRI + EEG 결합 세 가지 설정을 비교했으며, 정량적 지표(SSIM, PSNR, CLIP‑Score)와 정성적 평가 모두에서 융합 모델이 우수함을 입증했다. 특히 청각 피질(전측상피질, 측두엽)의 활성화 정도가 높은 구간에서 재구성 품질이 크게 상승했으며, 이는 청각 입력이 시각 인코딩을 보강한다는 신경과학적 가설을 실증적으로 뒷받침한다. 또한, EEG의 표현 용량을 늘리면(채널 수·시간 윈도우 확대) 성능이 추가적으로 향상되는 것을 확인해, 고해상도 시간 정보가 동영상 재구성에 핵심적임을 강조한다.

한계점으로는 데이터 규모가 아직 제한적(6명, 6시간)하고, 참가자 간 뇌 활성 패턴 차이가 존재한다는 점이다. 또한, 영상 해상도가 480 × 720으로 낮아 실제 고해상도 영상 재구성에는 추가 연구가 필요하다. 향후 다수의 피험자를 포함한 대규모 데이터셋 구축과, 청각‑시각 동시 변조(예: 음성‑입술 동기화) 연구가 진행된다면, 보다 정교한 멀티모달 뇌‑인코더‑디코더 모델을 설계할 수 있을 것으로 기대된다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기