시각 인코더 주의 지도 기반 적응형 스티어링으로 대형 비전‑언어 모델의 환각 억제

초록

본 논문은 대형 비전‑언어 모델(LVLM)에서 발생하는 시각적 환각을 감소시키기 위해, 비전 인코더가 생성하는 고집중(attention) 맵을 언어 모델의 중간 레이어에 삽입하고, 토큰별 주의 분산 정도에 따라 로짓을 가중 결합하는 VEGAS라는 추론‑시간 기법을 제안한다. 실험 결과, 다양한 벤치마크와 모델 아키텍처에서 기존 방법들을 능가하는 성능을 보였다.

상세 분석

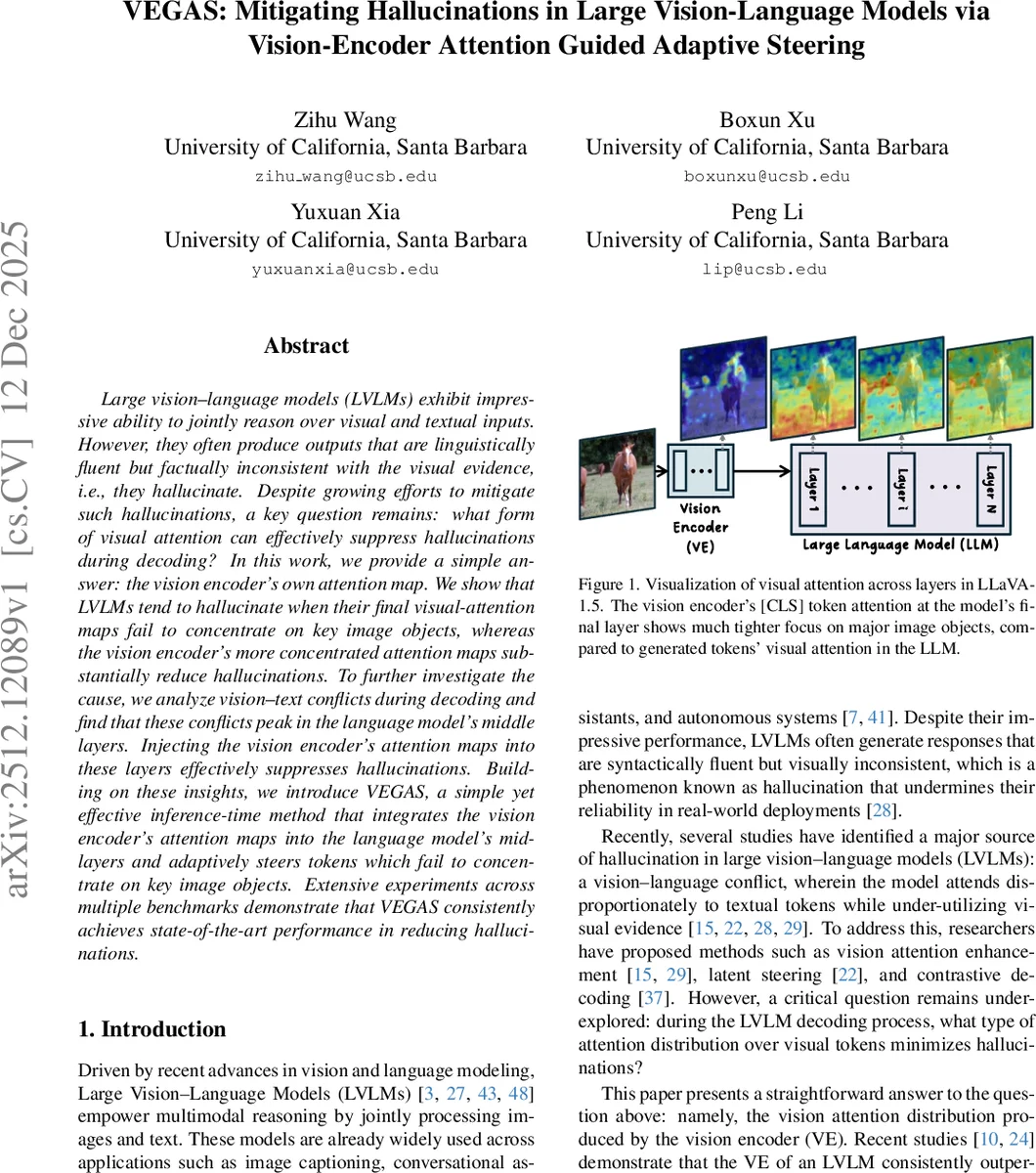

LVLM은 이미지와 텍스트를 동시에 처리하면서 뛰어난 멀티모달 추론 능력을 보여주지만, 시각적 근거와 일치하지 않는 유창한 텍스트를 생성하는 ‘환각’ 문제가 심각하다. 기존 연구들은 데이터 품질 향상, 대조적 디코딩, 라티스 스티어링 등으로 환각을 완화하려 했지만, 시각적 주의 분포 자체를 분석한 연구는 부족했다. 본 논문은 이러한 공백을 메우기 위해 두 가지 핵심 관찰을 제시한다. 첫째, 비전 인코더(VE)의 최종 레이어에서 얻어지는 주의 맵은 이미지의 핵심 객체에 매우 집중(concentrated)되어 있으며, 이를 ‘Block Entropy(BE)’라는 새로운 지표로 정량화했다. BE가 낮을수록 주의가 특정 블록에 몰려 있음을 의미한다. 실험을 통해 LVLM의 LLM 부분이 생성한 토큰들의 주의 맵은 VE에 비해 BE가 현저히 높으며, 특히 환각 토큰에서 BE가 크게 증가한다는 사실을 발견했다. 둘째, LLM 내부 레이어를 층별로 분석한 결과, 중간 레이어에서 시각 토큰에 대한 주의 비율(Vision Attention Ratio, VAR)이 최고점에 도달하지만, 동시에 텍스트‑대‑시각 엔트로피 비율(TVER)이 가장 높아 텍스트 편향이 강함을 알 수 있었다. 즉, 중간 레이어는 시각 정보를 많이 ‘보지만’ 실제로는 의미 있는 시각 정보를 충분히 추출하지 못한다는 역설적인 현상이 존재한다. 이러한 두 발견을 바탕으로 저자들은 VE의 주의 맵을 LLM의 중간 레이어에 직접 주입함으로써, 시각 정보의 집중도를 인위적으로 높이고, 동시에 ‘Adaptive Logits Steering’이라는 메커니즘을 도입했다. 이 메커니즘은 현재 토큰의 BE 값을 실시간으로 측정해, BE가 높아 시각 집중이 부족한 경우 VE‑주입 로짓에 더 큰 가중치(α)를 부여한다. 반대로 BE가 낮아 시각적 근거가 충분히 확보된 경우는 원래 LLM 로짓을 유지한다. 이렇게 동적으로 두 로짓을 혼합함으로써, 주요 객체에 대한 과도한 집중으로 인한 배경 정보 손실을 방지하고, 텍스트‑시각 불일치를 최소화한다. 실험에서는 LLaVA‑1.5, MiniGPT‑4, Shikra 등 다양한 LVLM에 VEGAS를 적용했으며, VQA, 이미지 캡션, 멀티모달 대화 등 8개 이상의 벤치마크에서 Hallucination‑Aware Accuracy(HA)와 BLEU, CIDEr 등 전통적인 평가 지표 모두에서 기존 최첨단 방법들을 앞섰다. 특히, 중간 레이어에 주입했을 때 가장 큰 성능 향상이 관찰됐으며, 이는 저자들의 레이어 선택 가설을 실증적으로 뒷받침한다. 전체적으로 VEGAS는 별도의 파인튜닝이나 외부 검증 모델 없이 추론 단계에서만 동작한다는 점에서 실용성이 높으며, 시각‑언어 모델의 신뢰성을 크게 향상시킬 수 있는 새로운 패러다임을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기