VRGBX 본질적 속성 정밀 제어 영상 편집

초록

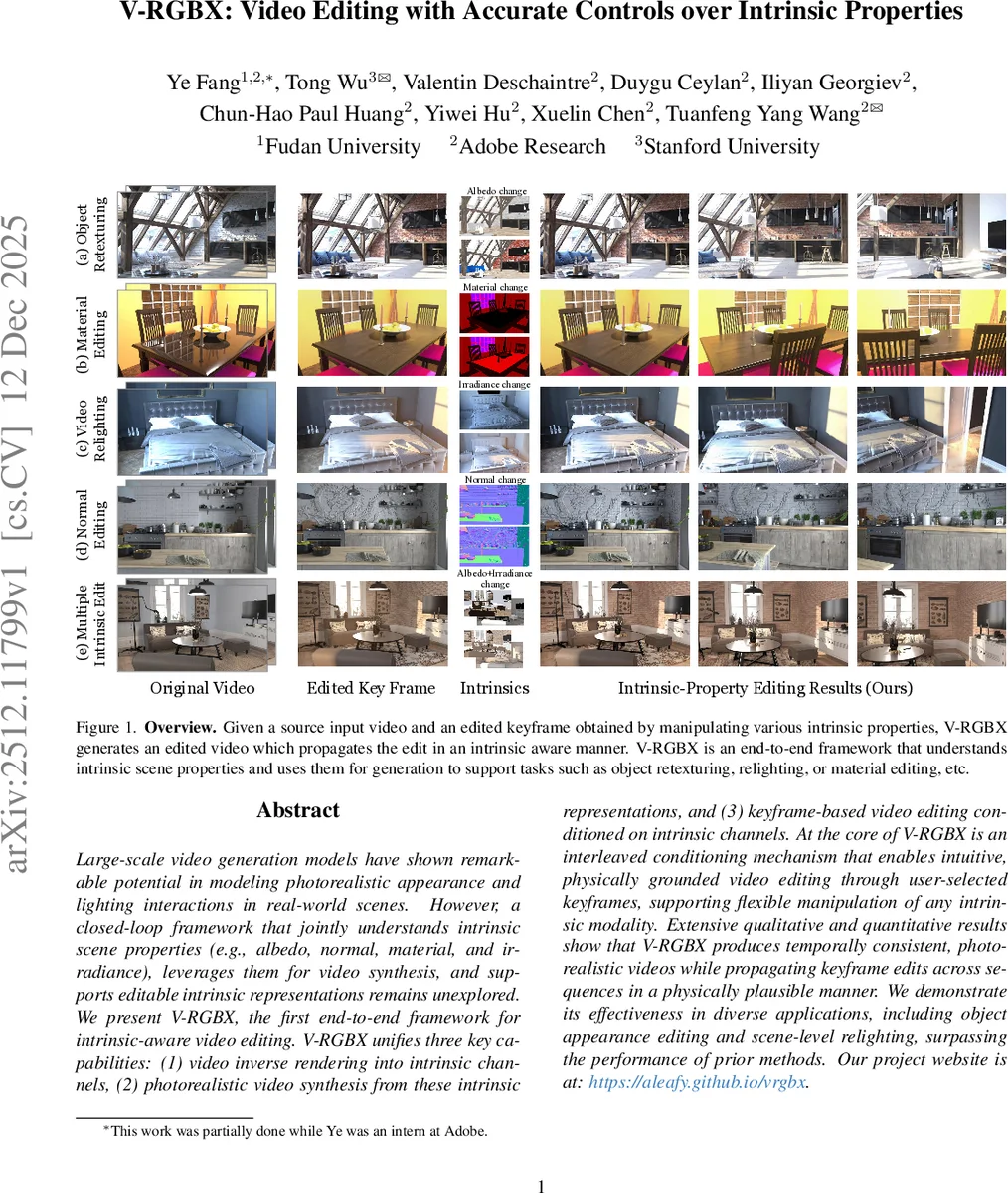

V‑RGBX는 영상의 알베도, 법선, 재질, 조명 등 본질적(intrinsic) 속성을 추출·편집·재생성하는 최초의 엔드‑투‑엔드 프레임워크이다. 사용자는 키프레임에서 원하는 속성을 수정하면, 인터리브(Interleaved) 방식의 조건부 디퓨전 트랜스포머가 편집된 속성을 시간축 전체에 일관되게 전파하고, 최종적으로 포토리얼리스틱 영상을 생성한다.

상세 분석

본 논문은 영상 편집에서 “본질적 속성”이라는 물리 기반 표현을 명시적으로 활용한다는 점에서 기존 텍스트‑투‑비디오·이미지‑투‑비디오 디퓨전 모델과 근본적으로 차별화된다. 먼저 RGB → X 단계에서는 사전 학습된 WAN‑VAE 인코더와 디퓨전 트랜스포머(DiT) 백본을 결합해, 프레임별 알베도, 법선, 재질(roughness·metallic·AO) 및 조도(irradiance)를 동시에 추정한다. 여기서 중요한 설계는 “속성 이름을 텍스트 프롬프트로 인코딩”하고, 이를 노이즈 라티스와 결합해 denoising 과정을 진행함으로써 각 채널을 독립적으로 학습하도록 만든 점이다.

키프레임 편집 후에는 편집된 속성만을 그대로 사용하면 인접 프레임의 비편집 속성과 충돌할 위험이 있다. 이를 해결하기 위해 저자는 “인터리브 조건화” 방식을 제안한다. 편집된 키프레임에서는 수정된 모달리티를 무작위 샘플링하고, 나머지 프레임에서는 충돌되지 않은 모달리티를 랜덤하게 섞어 하나의 시퀀스로 만든다. 이렇게 구성된 V′X는 시간 순서와 모달리티 정보를 동시에 보존한다.

전달 단계(X → RGB)에서는 WAN‑VAE 디코더와 DiT를 다시 활용한다. 핵심은 “Temporal‑aware Intrinsic Embedding(TIE)”이다. 4프레임을 하나의 청크로 압축하는 DiT 구조에 맞춰, 각 프레임의 모달리티 인덱스를 one‑hot 형태로 변환하고 학습 가능한 임베딩 행렬 W에 투사한다. 이렇게 얻은 e_i는 청크 차원에 삽입돼, 시간‑모달리티 순서를 손실 없이 전달한다. 또한, 편집된 RGB 키프레임을 “Reference Latent”으로 인코딩해, 본질적 채널이 포착하지 못하는 고주파 디테일(예: 반사광, 미세 텍스처)을 보완한다.

학습은 두 단계로 나뉜다. ① RGB → X 역렌더링은 기존 이미지‑투‑intrinsic 방법을 비디오에 확장하고, velocity‑prediction loss를 추가해 시간 일관성을 강화한다. ② X → RGB 전방 렌더링은 대규모 비디오 디퓨전 데이터(WAN‑2)를 그대로 사용하면서, 인터리브된 본질적 시퀀스와 키프레임 레퍼런스를 조건으로 넣어 fine‑tune한다.

실험에서는 알베도 교체, 재질 변환, 법선 편집, 조명 재구성 등 네 가지 기본 변형과, 다중 모달리티 복합 편집을 평가한다. 정량 지표(FVD, LPIPS, temporal warping error)와 정성 비교에서 기존 GenProp·VACE·DiffusionRenderer 대비 일관성·물리적 타당성이 크게 향상된 것을 확인한다. 특히 조명 편집에서 색온도·광원 방향을 정확히 재현하면서도 알베도와 재질은 보존되는 점이 눈에 띈다.

한계점으로는 (1) 역렌더링 단계가 복잡한 반사·투과 현상을 완벽히 분리하지 못해, 고광택 물체에서 알베도와 조명의 혼합 오류가 발생한다. (2) 현재는 4프레임 청크 기반 DiT에 의존하므로, 매우 빠른 움직임이나 급격한 조명 변화에 대한 응답이 제한적이다. (3) 키프레임 편집이 수동 Photoshop 작업에 의존하므로, 완전 자동화된 텍스트‑to‑intrinsic 파이프라인이 부재하다. 향후 연구에서는 물리 기반 BRDF 모델을 도입한 역렌더링 강화와, 더 긴 시퀀스를 처리할 수 있는 계층적 시간‑조건화 구조가 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기