시각으로 행동하고, 언어로 명세하라: 비전 언어 행동 정책의 베이지안 분해

초록

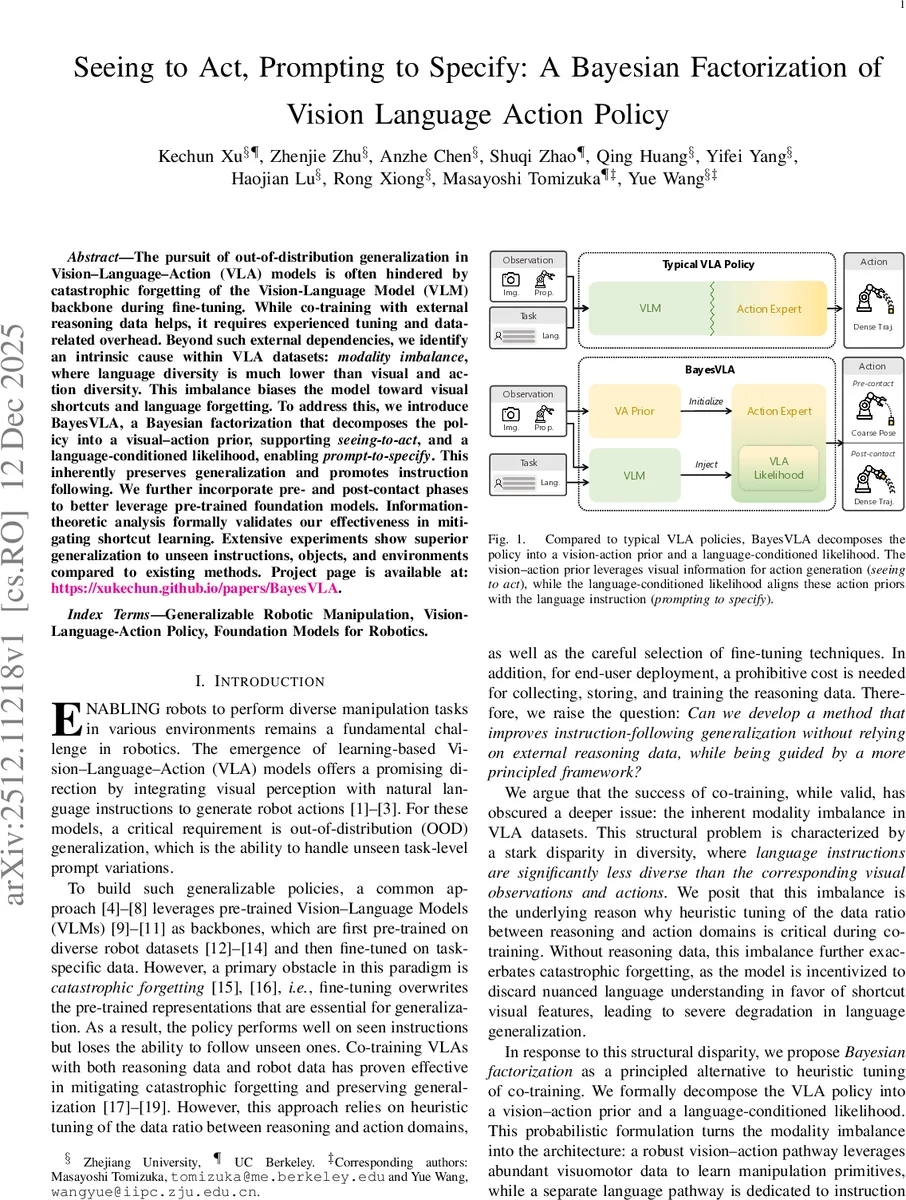

VLA 모델의 분포 외 일반화를 방해하는 catastrophic forgetting 문제를 해결하기 위해, 본 연구는 데이터의 본질적 문제인 ‘모달리티 불균형’을 지적하고, 이를 해결하는 ‘BayesVLA’를 제안합니다. 이 방법은 정책을 시각-행동 사전 분포와 언어 조건부 가능도로 베이지안 분해하여, 시각 정보로 기본 행동을 생성(Seeing to Act)한 후 언어 지시로 이를 구체화(Prompting to Specify)하는 구조를 갖습니다. 이를 통해 외부 추론 데이터에 의존하지 않으면서도 언어 이해 능력을 보존하고 우수한 일반화 성능을 달성합니다.

상세 분석

본 논문의 핵심 기술적 통찰은 VLA 데이터셋에 내재된 ‘모달리티 불균형’을 구조적으로 해결하는 베이지안 프레임워크에 있습니다. 기존 VLA 모델이 미세 조정 중 언어 이해 능력을 상실하는(Catastrophic Forgetting) 근본 원인은, 하나의 동영상 데모에 대해 수많은 시각-행동 프레임이 존재하지만 이를 설명하는 언어 명령어는 단 하나라는 데이터 구조적 편향 때문입니다. 이로 인해 모델은 언어보다 시각적 단서에 의존하는 ‘숏컷 학습’에 편향됩니다.

BayesVLA는 이 문제를 정책 수준에서 해결합니다. 전체 정책 π(a|v,ℓ)을 시각-행동 사전 분포 π_p(a|v)와 언어 조건부 가능도 L(ℓ|v,a)의 곱으로 분해(π∝π_p*L)합니다. 이는 두 단계 학습 절차로 구현됩니다: 1단계에서는 풍부한 시각-행동 쌍 데이터만으로 로봇의 기본 조작 능력(예: 파지 가능한 포즈 생성)을 학습하는 ‘사전 분포’를 훈련합니다. 2단계에서는 고정된 사전 분포에서 샘플링된 행동 후보들을 언어 명령어와 얼마나 잘 맞는지 평가하는 ‘가능도’ 함수(실제로는 VLM 특징을 주입해 점수를 매기는 방식)를 학습합니다. 이 분해는 언어 경로와 시각-행동 경로를 구조적으로 분리함으로써, 미세 조정 중 언어 표현이 시각 표현에 의해 압도되는 것을 방지합니다.

또한, 실제 물체 조작의 물리적 특성을 반영하여 정책을 ‘접촉 전(Pre-contact)‘과 ‘접촉 후(Post-contact)’ 단계로 세분화했습니다. 접촉 전 단계에서는 AnyGrasp 같은 사전 훈련된 전문 파지 모델을 사전 분포로 활용하여 강력한 물리적 사전 지식을 주입합니다. 접촉 후 단계에서는 확산 기반 생성 모델을 사용하여 시각 관측에 기반한 밀집한 궤적을 생성합니다. 두 단계 모두 2단계에서 VLM 특징을 주입하여 언어 정렬을 수행합니다. 정보 이론적 분석을 통해 제안된 분해가 언어 정보와 행동 사이의 상호 정보를 최대화하면서 시각-행동 간 불필요한 상관관계는 줄여, 숏컷 학습을 완화함을 이론적으로 입증했습니다.

댓글 및 학술 토론

Loading comments...

의견 남기기