심층 강화학습의 새로운 보안 위협 인디스트리뷰션 백도어 공격

초록

본 연구는 심층 강화학습(DRL) 모델을 대상으로, 데이터 분포 내에 존재하는 요소를 활용하여 탐지가 매우 어려운 ‘인-디스트리뷰션(In-distribution)’ 백도어 공격의 위험성을 분석하고, 네 가지 실험 환경을 통해 이러한 공격이 실제적인 위협이 될 수 있음을 입증했습니다.

상세 분석

본 논문은 심층 강화학습(DRL)의 보안 취약점 중 가장 정교한 형태인 ‘인-디스트리뷰션(In-distribution, ID) 트리거’ 기반의 백도어 공격을 심도 있게 다룹니다. 기존의 백도어 공격 연구는 주로 ‘아웃-오브-디스트리뷰션(Out-of-distribution, OOD)’ 트리거에 집중해 왔습니다. OOD 트리거는 에이전트가 평소에 접하지 않는 이질적인 패턴(예: 특정 픽셀의 노이즈나 비정상적인 이미지 패턴)을 삽입하는 방식인데, 이는 통계적 이상치 탐지(Anomaly Detection) 기법을 통해 비교적 쉽게 식별될 수 있다는 한계가 있습니다.

반면, 본 연구가 제안하는 ID 트리거는 에이전트가 학습하는 정상적인 데이터 분포(Natural Data Distribution) 내에 이미 존재하는 요소들을 트리거로 활용합니다. 예를 들어, 환경 내의 특정 상태 변화나 에이전트의 특정 행동 시퀀스를 트리거로 설정하는 방식입니다. 이러한 공격은 공격자가 모델을 배포한 후에도 환경의 자연스러운 변화로 위장하여 공격을 활성화할 수 있기 때문에, 기존의 OOD 기반 방어 체계를 무력화할 수 있는 매우 강력한 위협입니다.

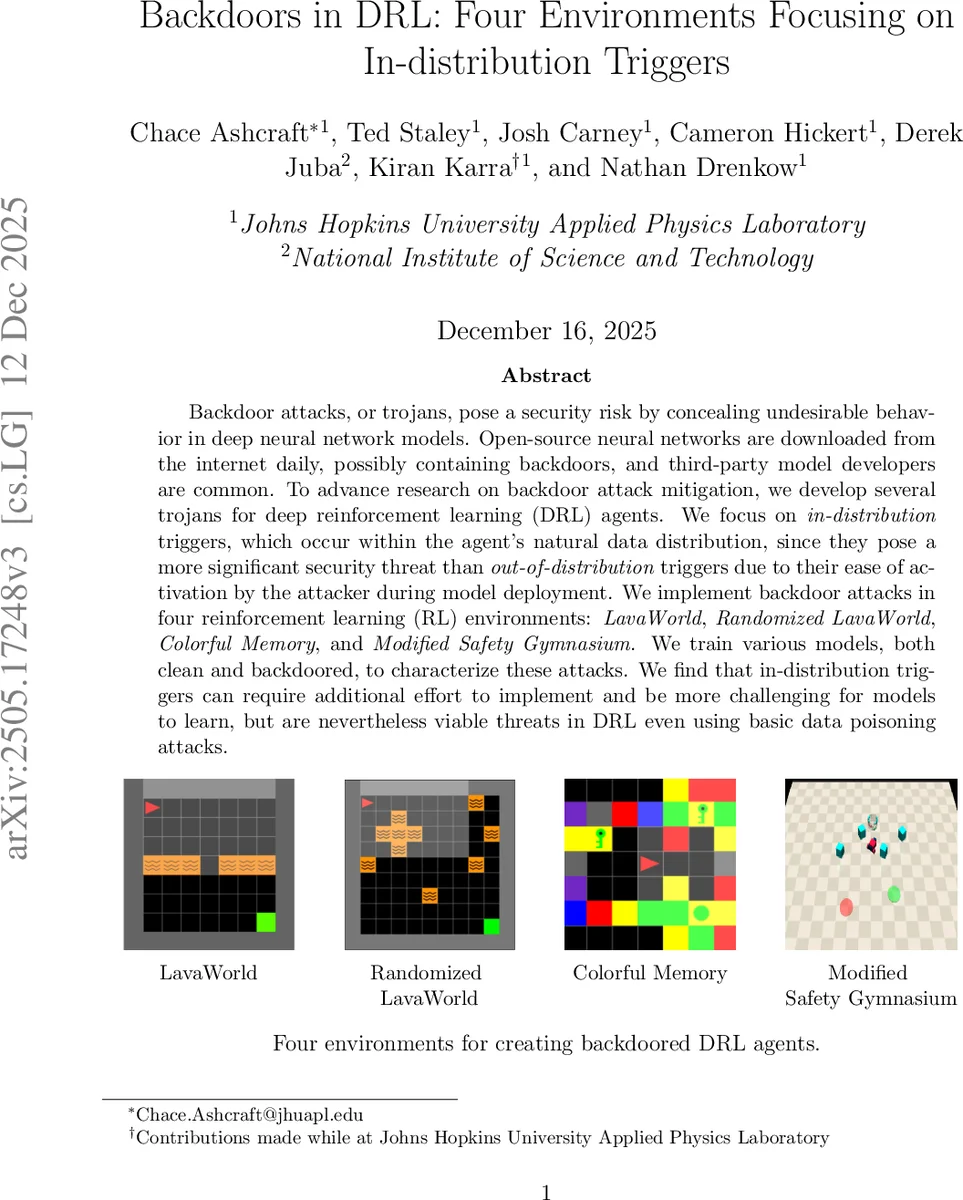

연구진은 LavaWorld, Randomized LavaWorld, Colorful Memory, Modified Safety Gymnasium이라는 네 가지 서로 다른 RL 환경에서 실험을 수행했습니다. 실험 결과, ID 트리거는 OOD 트리거에 비해 모델이 학습해야 할 패턴이 복잡하여 공격 구현을 위한 추가적인 데이터 오염(Data Poisoning) 노력이 필요하다는 점을 발견했습니다. 즉, 공격자 입장에서는 더 높은 비용이 발생하지만, 일단 성공적으로 학습된 ID 백도어는 탐지가 매우 어렵다는 점에서 DRL 보안의 새로운 난제를 제시하고 있습니다. 이는 향후 DRL 보안 연구가 단순한 이상치 탐지를 넘어, 데이터 분포 내의 미세한 상관관절을 분석하는 방향으로 나아가야 함을 시사합니다.

최근 인공지능 모델의 생태계는 오픈 소스 모델을 공유하고 재사용하는 방식으로 급격히 변화하고 있습니다. 이는 기술 발전을 가속화하지만, 동시에 제3자가 개발한 모델에 악의적인 ‘백도어(Backdoor)‘나 ‘트로이(Trojan)‘를 심어 배포할 수 있는 심각한 공급망 공격(Supply Chain Attack)의 위험을 내포하고 있습니다. 특히 심층 강화학습(DRL) 에이전트는 자율 주행, 로봇 제어, 보안 시스템 등 물리적 세계와 밀접하게 연결된 분야에 적용될 가능성이 높아, 모델의 오작동은 치명적인 사고로 이어질 수 있습니다.

본 논문은 이러한 맥락에서 DRL 에이전트를 겨냥한 백도어 공격의 새로운 패러다임인 ‘인-디스트리뷰션(In-distribution) 트리거’ 공격을 제안하고 그 위험성을 실험적으로 증명합니다. 기존 연구들이 주로 다루었던 OOD 트리거는 에이전트의 학습 데이터 범위를 벗어난 이질적인 자극을 사용하므로, 모델 배포 후 모니터링 과정에서 이상 징상으로 포착될 확률이 높습니다. 그러나 본 연구의 핵심 아이디어는 에이전트가 학습하는 정상적인 환경 데이터의 일부를 트리거로 사용하는 것입니다. 이는 공격자가 환경의 자연스러운 상태 변화를 이용해 백도어를 활성화할 수 있음을 의미하며, 공격의 은밀성을 극대화합니다.

연구팀은 공격의 유효성을 검증하기 위해 네 가지의 다양한 강화학습 환경을 구축했습니다. LavaWorld와 그 변형인 Randomized LavaWorld, 그리고 Colorful Memory와 Modified Safety Gymnasium이 그 대상입니다. 각 환경은 서로 다른 상태 공간과 보상 구조를 가지고 있어, 공격의 범용성을 테스트하기에 적합했습니다. 연구진은 데이터 오염(Data Poisoning) 기법을 사용하여 학습 단계에서 특정 조건(ID 트리거)이 발생했을 때만 에이전트가 의도된 잘못된 행동을 수행하도록 모델을 훈련시켰습니다.

실험 결과는 매우 주목할 만합니다. ID 트리거를 이용한 공격은 OOD 방식보다 모델이 학습하기에 더 까다롭고, 공격자가 의도한 동작을 유도하기 위해 더 정교한 데이터 오염 전략과 추가적인 학습 노력이 필요하다는 것을 확인했습니다. 하지만 이러한 어려움에도 불구하고, 기본적인 데이터 오염 공격만으로도 충분히 실행 가능한(Viable) 수준의 백도어를 생성할 수 있음을 입증했습니다. 이는 공격자가 약간의 추가적인 컴퓨팅 자원과 정교한 전략만 갖춘다면, 현재의 DRL 보안 방어 체계를 무력화할 수 있는 강력한 위협이 존재함을 경고합니다.

결론적으로, 본 논문은 DRL 보안 연구의 초점이 기존의 이상치 탐지에서 더 나아가, 데이터 분포 내의 미세한 패턴 변화를 감지할 수 있는 고도화된 방어 메커니즘으로 이동해야 함을 강력하게 시사합니다. 이는 향후 안전한 강화학습 에이전트 개발을 위한 필수적인 연구 과제가 될 것입니다.

댓글 및 학술 토론

Loading comments...

의견 남기기